O que é IA explicável ou XAI?

O que é IA explicável ou XAI?

Inteligência artificial explicável é um conjunto de processos e métodos que permitem aos usuários entender e confiar nos resultados e saídas criados pelos algoritmos de aprendizado de máquina (ML) da IA. As explicações que acompanham a saída de IA/ML podem ser destinadas a usuários, operadores ou desenvolvedores e têm como objetivo atender preocupações e desafios que vão desde a adoção do usuário até a governança e o desenvolvimento de sistemas. Esta “explicabilidade” é fundamental para que a IA possa conquistar a confiança e a segurança necessárias no mercado para estimular a ampla adoção da IA e dos seus benefícios. Outras iniciativas relacionadas que estão surgindo são a IA confiável e a IA responsável.

Como a IA explicável é implementada?

O Instituto Nacional de Padrões e Tecnologia (NIST) dos EUA afirma que há quatro princípios que dirigem a XAI:

- Explicação: os sistemas fornecem evidências ou razões que acompanham todas as saídas.

- Significância: os sistemas fornecem explicações que podem ser compreendidas pelos usuários.

- Exatidão da explicação: a explicação reflete corretamente o processo do sistema responsável pela geração da saída.

- Limites de conhecimento: o sistema somente opera sob as condições para as quais foi projetado ou quando sua saída tiver alcançado níveis suficientes de confiança.

A NIST observa que as explicações podem variar de simples a complexas e que são dependentes do consumidor em questão. Esta agência ilustra alguns tipos de explicação relacionando em uma lista não exaustiva as seguintes cinco categorias de explicabilidade abaixo:

- Benefício do usuário

- Aceitação da sociedade

- Questões regulatórias e conformidade

- Desenvolvimento do sistema

- Benefício do proprietário

Por que a IA explicável é importante?

A IA explicável é um componente crucial para conseguirmos ampliar, conquistar e manter a confiança nos sistemas automatizados. Sem a confiança, a IA — e especificamente a IA para operações de TI (AIOps) — não será totalmente adotada, deixando a escala e a complexidade dos sistemas modernos ultrapassarem as capacidades das operações manuais e da automação tradicional.

Quando a confiança é estabelecida, fica aparente a prática da “maquiagem de IA” — a implicação de que um produto ou serviço seria orientado por IA mesmo quando o papel da IA é muito tênue ou inexistente — ajudando os praticantes e clientes com sua devida diligência da IA. Estabelecer confiança na IA e segurança em seu uso afeta o escopo e a velocidade de adoção, que por usa vez determina a rapidez para a obtenção dos seus benefícios e a extensão destes.

Ao incumbir qualquer sistema de encontrar respostas ou tomar decisões, especialmente aquelas que têm impactos do mundo real, é imperativo que possamos explicar como este sistema chega a uma decisão, como ele influencia um resultado ou por que considerou necessário tomar alguma ação.

Benefícios da IA explicável

Os benefícios da IA explicável são multidimensionais. Estes benefícios estão relacionados a uma tomada de decisão informada, redução de risco, maior confiança e adoção dos usuários, melhor governança e maior rapidez na melhoria do sistema, além da evolução e utilidade global da IA no mundo.

Quais problemas são resolvidos pela IA explicável?

Muitos modelos de IA e AM não são transparentes e seus resultados são inexplicáveis. A capacidade de expor e explicar os motivos pelos quais certos caminhos foram seguidos ou como suas saídas foram geradas é fundamental para a confiança, evolução e adoção das tecnologias de IA.

Lançar luz nos dados, modelos e processos permite que operadores e usuários tenham ideias e observações sobre estes sistemas para otimização, usando raciocínios transparentes e válidos. O mais importante é que a explicabilidade permite que quaisquer falhas, vieses e riscos sejam comunicados e subsequentemente mitigados ou removidos com maior facilidade.

Como a IA explicável cria transparência e constrói confiança

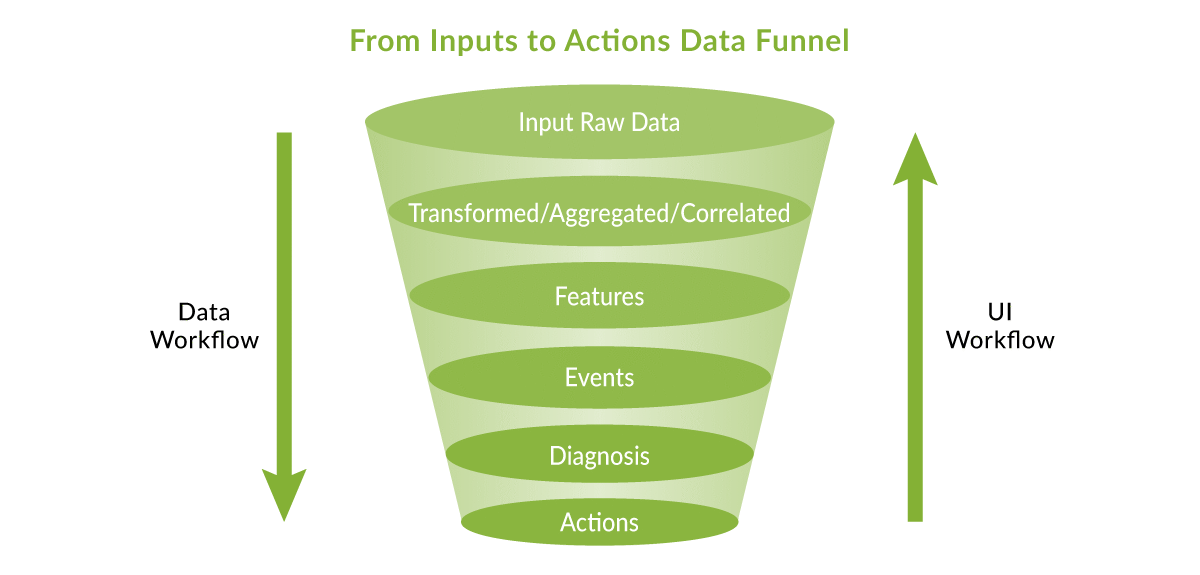

Para serem úteis, os dados brutos iniciais devem ao final resultar em uma ação sugerida ou executada. Pedir ao usuário que confie em um fluxo de trabalho totalmente autônomo desde o início é às vezes um salto muito grande, sendo assim aconselhável possibilitar a ele subir desde baixo cada degrau que baseia o processo. Analisando os eventos um nível por vez, o fluxo de trabalho da interface de usuário (UI) permite que você verifique cada camada separadamente até as entradas brutas. Isso facilita a transparência e a confiança.

Uma estrutura que permita aos especialistas do domínio satisfazer seu ceticismo em análises mais profundas e aos novatos procurar até onde for a sua curiosidade permite que iniciantes e veteranos experientes estabeleçam confiança à medida que aumentam sua produtividade e aprendizado. Esse engajamento forma também um ciclo virtuoso que pode treinar e aprimorar os algoritmos de IA/ML para a obtenção de melhorias contínuas do sistema.

O fluxo de dados em uma interface de usuário orientada por IA

Como usar a IA explicável para avaliar e reduzir o risco

As redes de dados, com seus protocolos e estruturas de dados bem definidos, permitem à IA fazer progressos incríveis, sem medo de discriminações ou vieses humanos. Quando encarregados de aspectos de problemas neutros como resolução de problemas e a garantia do serviço, os aplicativos de IA podem ter um escopo bem definido e serem adotados de forma responsável.

É vital ter algumas questões técnicas e operacionais básicas respondidas pelo seu fornecedor para desmascarar e evitar a maquiagem de IA. Assim como com qualquer esforço de devida diligência e aquisição, o nível de detalhe das respostas pode fornecer informações importantes. As respostas podem exigir alguma interpretação técnica, mas ainda são recomendadas para ajudar a garantir que as alegações dos fornecedores são viáveis.

Assim como com qualquer tecnologia, as equipes de engenharia definem critérios para a avaliação das compras propostas, tendo as decisões relacionadas baseadas em evidências. Para reduzir o risco e ajudar com a devida diligência, indicamos abaixo alguns exemplos de perguntas que podem ser feitas pelos proprietários e usuários de IA/ML:

- Quais algoritmos compõem e contribuem para a solução?

- Quais dados são ingeridos e como eles são limpos?

- Onde os dados são fornecidos (e seriam eles personalizados por locação, conta ou usuário)?

- Como os parâmetros e recursos são projetados no espaço da rede?

- Como os modelos são treinados, retreinados e mantidos renovados e relevantes?

- O sistema pode por si mesmo explicar seus raciocínios, recomendações ou ações?

- Como os vieses são eliminados ou reduzidos?

- Como a solução ou plataforma se aprimora e evolui automaticamente?

Além disso, é sempre recomendável realizar pilotos ou ensaios para validar as promessas ou alegações feitas sobre os serviços ou sistemas de IA.

IA explicável em ação com a Juniper

O uso responsável e ético da IA é um tópico complexo, mas que deve ser tratado pelas organizações.Os princípios de inovação em IA da Juniper Mist orientam o uso que fazemos da IA em nossos serviços e produtos. Já escrevemos extensivamente também sobre a IA/AM e nossa abordagem para AIOps, incluindo dados e primitivas de IA, resoluções de problemas orientada por IA, interfaces e chatbots inteligentes, que ajudam a detectar e corrigir anomalias na rede além de melhorar as operações, usando um conjunto melhor de ferramentas.

A XAI pode vir de várias formas. Por exemplo, os recursos de AIOps da Juniper incluem a execução do gerenciamento de recursos de rádio (RRM) automático em redes de Wi-Fi e a detecção de problemas como um cabo de rede defeituoso. Algumas ferramentas de XAI da Juniper estão disponíveis na interface de produto da Mist, que você pode testar por você mesmo em nossa demonstração autoguiada. Inscreva-se aqui para ter acesso hoje mesmo.

Da perspectiva de usuário e operador, veja por si mesmo os diversos recursos novos incluídos em produtos baseados na Mist AI™ e no Marvis Virtual Network Assistant que apresentarão uma maior explicabilidade sobre os métodos, modelos, decisões e níveis de confiança destinados a aumentar a confiança e a transparência.

Perguntas frequentes sobre a IA explicável

O que se entende por IA explicável?

Inteligência artificial explicável é um conjunto de processos e métodos que permitem aos usuários entender e confiar nos resultados e saídas criados pelos algoritmos de IA/ML. As explicações que acompanham a saída de IA/ML podem ser destinadas a usuários, operadores ou desenvolvedores e têm como objetivo atender preocupações e desafios que vão desde a adoção do usuário até a governança e o desenvolvimento de sistemas.

O que é um modelo de IA explicável?

Um modelo de IA explicável é aquele que possui características ou propriedades que facilitam a transparência, facilidade de compreensão e a capacidade de questionar ou analisar as saídas da IA.

Por que a IA explicável é importante?

Como a IA explicável detalha o racional que está por trás das saídas de IA do sistema, ela proporciona a compreensão, governança e confiança que as pessoas devem ter para implantar sistemas de IA e terem segurança em suas saídas e resultados. Sem a XAI para ajudar a construir confiança e segurança, seria pouco provável que as pessoas implantassem amplamente esta tecnologia e se beneficiassem dela.

Quais são os benefícios da IA explicável?

Há muitos benefícios decorrentes da IA explicável. Estes benefícios estão relacionados a uma tomada de decisão informada, redução de risco, maior confiança e adoção da IA, melhor governança e maior rapidez na melhoria do sistema, além da evolução e utilidade global da IA no mundo.

Existe IA explicável?

Sim, embora em sua forma nascente, pois suas definições ainda estão em evolução. Embora seja mais difícil implementar a XAI em modelos de IA/ML complexos ou mistos, com grandes quantidades de recursos ou fases, a XAI está encontrando rapidamente seu caminho nos produtos e serviços para construir a confiança dos usuários e ajudar a acelerar o desenvolvimento.

O que é a explicabilidade na aprendizagem profunda?

A aprendizagem profunda é às vezes considerada uma “caixa preta”, o que significa que pode ser difícil entender o comportamento do modelo de aprendizagem profunda e como ele chega às suas decisões. A explicabilidade procura facilitar as explicações da aprendizagem profunda. Uma técnica usada para explicar os modelos de aprendizagem profunda é a Shapley. Os valores de SHAP podem explicar previsões específicas destacando os recursos envolvidos na previsão. Há pesquisas em curso sobre a avaliação dos diferentes métodos de explicação.

Quais são os recursos de IA explicável oferecidos pela Juniper?

A XAI pode vir de várias formas. Por exemplo, a Juniper oferece blogs e vídeos que descrevem os algoritmos de ML usados em várias funções da AIOps, como a execução do gerenciamento de recursos de rádio (RRM) automático em redes de Wi-Fi ou a detecção de um cabo de rede defeituoso (veja os recursos de vídeo a seguir). O painel Marvis Application Experience Insights usa os valores de SHAP para identificar as condições de rede (recursos) que estão causando experiências de aplicação ruins, como um vídeo do Zoom instável. Algumas dessas ferramentas da XAI estão disponíveis na interface do produto Mist, que você pode testar por si mesmo em nossa demonstração autoguiada. Inscreva-se aqui para ter acesso hoje mesmo.