このページの内容

LDP の設定

最小 LDP 設定

最小設定でLDPを有効にするには:

ファミリー MPLS で関連するすべてのインターフェイスを有効にします。ディレクテッドLDPの場合、ループバックインターフェイスをファミリーMPLSで有効にする必要があります。

(オプション)

[edit protocol mpls]階層レベルで関連するインターフェイスを設定します。単一のインターフェイスでLDPを有効にし、

ldpステートメントを含め、interfaceステートメントを使用してインターフェイスを指定します。

これがLDPの最小設定です。他のすべての LDP 設定ステートメントはオプションです。

ldp { interface interface-name; }

すべてのインターフェイスでLDPを有効にするには、interface-nameにallを指定します。

これらのステートメントを含めることができる階層レベルの一覧については、ステートメント概要セクションを参照してください。

LDPの有効化および無効化

LDPはルーティングインスタンスを認識しています。特定のインターフェイスでLDPを有効にするには、以下のステートメントを含めます。

ldp { interface interface-name; }

これらのステートメントを含めることができる階層レベルの一覧については、ステートメント概要セクションを参照してください。

すべてのインターフェイスでLDPを有効にするには、interface-nameにallを指定します。

インターフェイスのグループでインターフェイスのプロパティを設定し、そのうちの1つのインターフェイスでLDPを無効にする場合は、disableオプションにinterfaceステートメントを使用します。

interface interface-name { disable; }

このステートメントを含めることができる階層レベルの一覧については、ステートメント概要セクションを参照してください。

Hello メッセージ用の LDP タイマーの設定

LDP Helloメッセージにより、LDPノードはお互いを発見し、ネイバーの障害やネイバーへのリンクを検出できます。Helloメッセージは、LDPが有効になっているすべてのインターフェイスで定期的に送信されます。

LDP Hello メッセージには 2 種類あります。

リンク Hello メッセージ - LDP インターフェィスを介して、LDP ディスカバリー ポートに宛てた UDP パケットとして送信されます。インターフェイスでLDPリンクhelloメッセージを受信すると、LDPピアルーターとの隣接関係が識別されます。

ターゲット Hello メッセージ - 特定のアドレスの LDP ディスカバリー ポートに宛てた UDP パケットとして送信されます。ターゲット Hello メッセージは、直接接続されていないルーター間の LDP セッションをサポートするために使用されます。ターゲット ルーターは、ターゲット Hello メッセージに応答するか無視するかを決定します。応答を選択したターゲットルーターは、ターゲットhelloメッセージを定期的に送信することによって応答しますルーター。

デフォルトでは、LDP は、リンク Hello メッセージは 5 秒ごとに、ターゲット Hello メッセージは 15 秒ごとに送信します。LDP タイマーを設定して、両方のタイプの Hello メッセージを送信する頻度を変更できます。ただし、LDP 保留時間よりも長く LDP タイマーの設定はできません。詳細については、 『Configuring the Delay Before LDP Neighbors Are Considered Down』を参照してください。

リンク Hello メッセージ用の LDP タイマーの設定

LDP がリンク Hello メッセージを送信する頻度を変更するには、 hello-interval ステートメントを使用して LDP タイマーに新しいリンク Hello メッセージの間隔を指定します。

hello-interval seconds;

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

ターゲット Hello メッセージ用の LDP タイマーの設定

LDP がターゲット Hello メッセージを送信する頻度を変更するには、targeted-hello ステートメントのオプションとして hello-interval ステートメントを設定し、LDP タイマーに新しいターゲット Hello メッセージの間隔を指定します。

targeted-hello { hello-interval seconds; }

これらのステートメントを含めることができる階層レベルの一覧については、これらのステートメントのステートメント概要セクションを参照してください。

LDP ネイバーがダウンしたと判断される前に遅延を設定する

保留時間は、ネイバーがダウンしたと宣言する前に、LDP ノードが Hello メッセージを待つ時間を決定します。この値は、各 LDP ノードがネイバーに待ち時間を伝えるために、hello メッセージの一部として送信されます。各ネイバーから送信される値は一致しなくても構いません。

保留時間は、通常、hello 間隔の少なくとも 3 倍にする必要があります。デフォルトでは、リンク Hello メッセージは 15 秒、ターゲット Hello メッセージは 45 秒です。ただし、hello 間隔の値に近い LDP 保留時間を設定することは可能です。

LDP の保留時間を hello 間隔に近い値(hello 間隔の 3 倍以下)に設定することで、LDP ネイバーの障害をより早く検出できる可能性があります。しかし、この方法では、まだ正常に機能しているLDPネイバーを、ルーターがダウンと宣言する可能性も高くなります。詳細については、Hello メッセージ用の LDP タイマーの設定を参照してください。

また、LDP の保留時間は、LDP ピア間で自動的にネゴシエートされます。2 つの LDP ピアが互いに異なる LDP 保留時間をアドバタイズする場合は、小さい方の値を使用します。LDP ピアルーターが設定した値よりも短い保留時間をアドバタイズした場合、ピアルーターのアドバタイズされた保留時間が使用されます。このネゴシエーションは、LDP のキープアライブ間隔にも影響します。

LDP ピアネゴシエーション中にローカル LDP の保留時間が短縮されない場合、ユーザーが設定したキープアライブ間隔は変更されません。ただし、ピアネゴシエーション中にローカル保留時間が短縮されると、キープアライブ間隔が再計算されます。ピアネゴシエーション中にLDPの保留時間が短縮された場合、キープアライブ間隔は新しい保留時間の値の3分の1に短縮されます。例えば、新しい保留時間の値が 45 秒の場合、キープアライブ間隔は 15 秒に設定されます。

このキープアライブ間隔の自動計算により、各ピアルーターで異なるキープアライブ間隔を設定できます。これにより、LDP ピアネゴシエーションにより、LDP の保留時間よりも頻繁にキープアライブメッセージが送信されるため、ルーターはキープアライブメッセージの送信頻度を柔軟に変更することができます。

ホールドタイムの間隔を再設定しても、セッションがリセットされるまで変更は反映されません。保留時間は、LDP ピアリングセッションの開始時にネゴシエートされ、セッションが稼働している間は再ネゴシエートできません(RFC 5036、 LDP仕様で要求されています)。LDP セッションを手動で強制的にリセットするには、 clear ldp session コマンドを発行します。

リンク Hello メッセージ用の LDP 保留時間を設定する

ネイバーダウンを宣言する前に、LDP ノードがリンク Hello メッセージを待つ時間を変更するには、 hold-time ステートメントを使用して、新しい時間を秒単位で指定します。

hold-time seconds;

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

ターゲット Hello メッセージ用の LDP 保留時間を設定する

ネイバーダウンを宣言する前に、LDP ノードがターゲット Hello メッセージを待つ時間を変更するには、targeted-hello ステートメントのオプションとして hold-time ステートメントを使用して、新しい時間を秒単位で指定します。

targeted-hello { hold-time seconds; }

これらのステートメントを含めることができる階層レベルの一覧については、これらのステートメントのステートメント概要セクションを参照してください。

LDPの厳密なターゲットhelloメッセージの有効化

厳密にターゲットされたHelloメッセージを使用して、特に設定されていないリモートネイバーとLDPセッションが確立されないようにします。 strict-targeted-hellos ステートメントを設定すると、LDPピアは、設定されたリモートネイバーではないソースから来るターゲットhelloメッセージに応答しません。設定されたリモートネイバーには、以下が含まれます。

LDPトンネリングが設定されているRSVPトンネルの終点

レイヤー2回線ネイバー

未構成のネイバーが Hello メッセージを送信した場合、LDP ピアはそのメッセージを無視し、送信元を示すエラー( error trace フラグ付き)を記録します。例えば、LDPピアがインターネットアドレス10.0.0.1からターゲットハローを受信し、このアドレスを持つネイバーが特に設定されていない場合、LDPログファイルに次のメッセージが出力されます。

LDP: Ignoring targeted hello from 10.0.0.1

厳密にターゲットを絞ったHelloメッセージを有効にするには、 strict-targeted-hellos ステートメントを含めます。

strict-targeted-hellos;

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

LDP キープアライブ メッセージの間隔を設定する

キープアライブ間隔は、キープアライブのタイムアウトを超えないように、セッション上でメッセージを送信する頻度を決定します。この時間内に他の LDP トラフィックがセッションを介して送信されない場合、キープアライブ メッセージが送信されます。デフォルトは 10 秒です。最小値は 1 秒です。

ピアルーターのLDPホールドタイムに設定された値がローカルに設定された値よりも低い場合、LDPセッションネゴシエーション中にキープアライブ間隔に設定された値を変更することができます。詳細については、 『Configuring the Delay Before LDP Neighbors Are Considered Down』を参照してください。

キープアライブ間隔を変更するには、 keepalive-interval ステートメントを含めます。

keepalive-interval seconds;

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

LDPキープアライブタイムアウトの設定

LDP セッションの確立後は、セッションが正常に動作していることを確認するために、定期的にメッセージ交換を行う必要があります。キープアライブタイムアウトは、ネイバーLDPノードがセッションの失敗を判断するまでに待機する時間を定義します。この値は通常、キープアライブ間隔の少なくとも3倍に設定されます。デフォルトは30秒です。

キープアライブ間隔を変更するには、 keepalive-timeout ステートメントを含めます。

keepalive-timeout seconds;

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

keepalive-timeoutステートメントに設定された値は、show ldp session detailコマンドを発行したときの保留時間として表示されます。

LDPのロンゲストマッチの設定

LDPがドメイン間のOSPFエリアまたはIS-ISレベルで集約または要約されたルートを学習できるようにするため、Junos OSでは、 RFC5283に基づいてLDPのロンゲストマッチを設定することができます。

LDPのロンゲストマッチを設定する前に、以下のことを行う必要があります。

デバイスインターフェイスを設定します。

MPLSプロトコルを設定します。

OSPFプロトコルを設定します。

LDPのロンゲストマッチを設定するには、次のようにする必要があります。

例:LDPのロンゲストマッチの設定

この例では、 RFC5283に基づいてLDPのロンゲストマッチを設定する方法を示しています。これにより、LDPは、ドメイン間のOSPFエリアまたはIS-ISレベルで集約または要約されたルートを学習できます。ロンゲストマッチポリシーは、プレフィックス単位の詳細を提供します。

要件

この例では、以下のハードウェアおよびソフトウェアコンポーネントを使用しています。

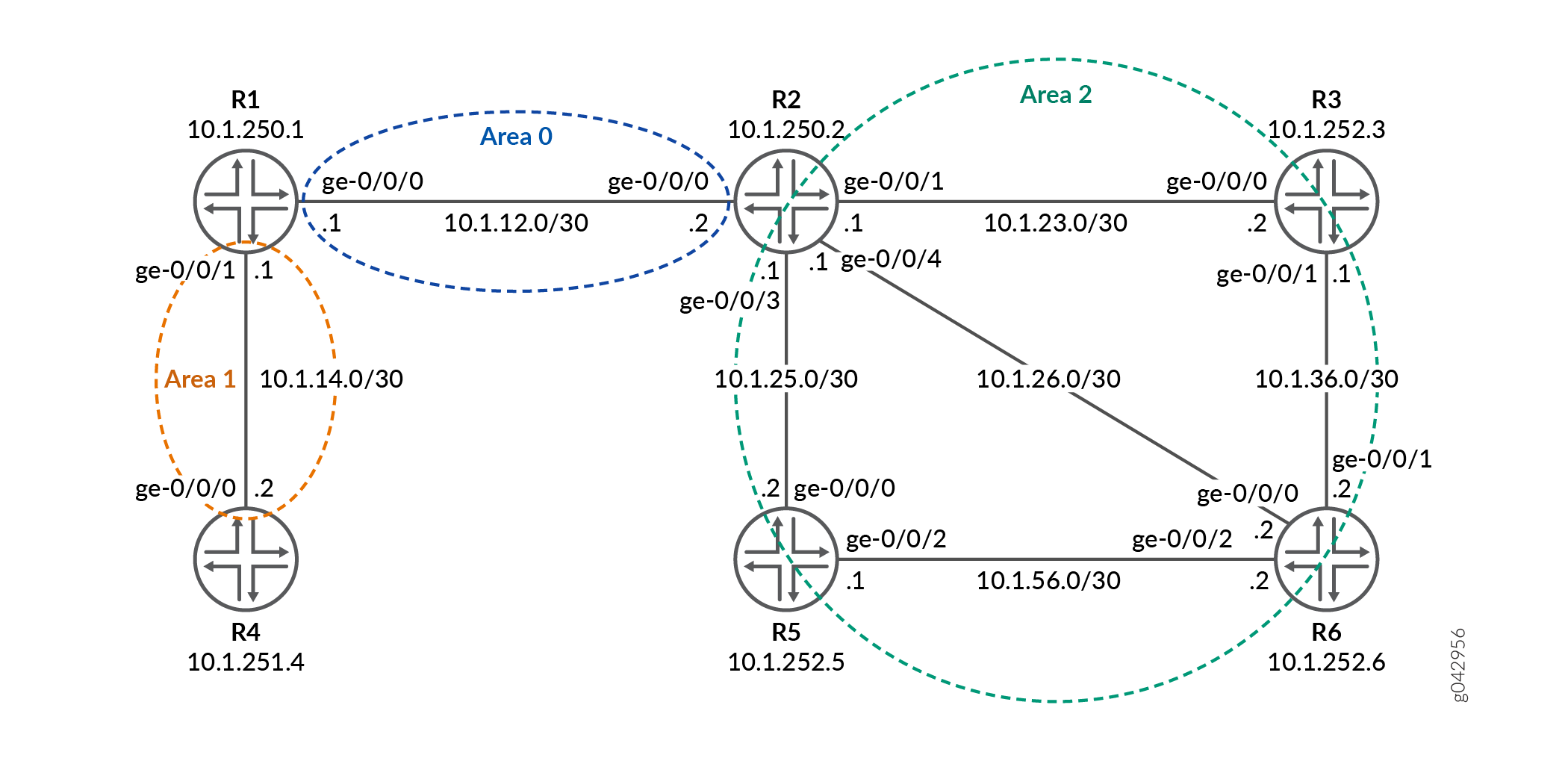

OSPFプロトコルを備えた6台のMXシリーズルーターと、接続されたインターフェイスで有効にされたLDP。

すべてのデバイスで実行されている Junos OS リリース 16.1 以降。

始める前に:

デバイスインターフェイスを設定します。

OSPFを設定します。

概要

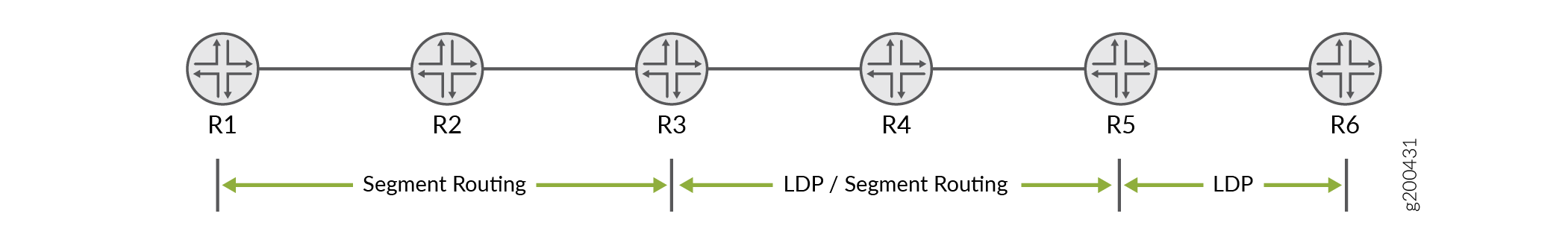

LDPは、OSPFやIS-ISなどのIGPを使用して、完全なネットワークドメイン全体でMPLSラベルスイッチパス(LSP)を確立するためによく使用されます。このようなネットワークでは、ドメイン内のすべてのリンクには、IGP隣接関係とLDP隣接関係があります。LDP は、IP 転送によって決定され、宛先までの最短パスで LSP を確立します。Junos OSでは、LDP実装は、ラベルマッピングの目的で、RIBまたはIGPルート内のFECのIPアドレス上で完全一致検索を行います。この正確なマッピングには、すべてのLERでMPLSエンドツーエンドのLDPエンドポイントIPアドレスを設定する必要があります。これにより、IP 階層設計やアクセスデバイスのデフォルトルーティングの目的が果たせなくなります。 longest-match を設定することで、完全一致の動作を抑制し、プレフィックス単位で最長一致ルートに基づいてLSPを設定することで、これを解決できます。

設定

CLIクイックコンフィグレーション

この例をすばやく設定するには、以下のコマンドをコピーしてテキスト ファイルに貼り付け、改行を削除し、ネットワーク設定に一致させる必要がある詳細情報を変更し、コマンドを [edit] 階層レベルでCLIにコピー アンド ペーストして、設定モードから commit を入力します。

R0

set interfaces ge-0/0/0 unit 0 family inet address 22.22.22.1/24 set interfaces ge-0/0/1 unit 0 family inet address 15.15.15.1/24 set interfaces ge-0/0/2 unit 0 family inet address 11.11.11.1/24 set interfaces ge-0/0/2 unit 0 family iso set interfaces ge-0/0/2 unit 0 family mpls set interfaces lo0 unit 0 family inet address 10.255.112.1/32 primary set interfaces lo0 unit 0 family inet address 10.255.112.1/32 preferred set interfaces lo0 unit 0 family iso address 49.0002.0192.0168.0001.00 set routing-options router-id 10.255.112.1 set protocols mpls interface ge-0/0/2.0 set protocols ospf area 0.0.0.1 interface ge-0/0/2.0 set protocols ospf area 0.0.0.1 interface lo0.0 passive set protocols ldp longest-match set protocols ldp interface ge-0/0/2.0 set protocols ldp interface lo0.0

R1

set interfaces ge-0/0/0 unit 0 family inet address 11.11.11.2/24 set interfaces ge-0/0/0 unit 0 family iso set interfaces ge-0/0/0 unit 0 family mpls set interfaces ge-0/0/1 unit 0 family inet address 12.12.12.1/24 set interfaces ge-0/0/1 unit 0 family iso set interfaces ge-0/0/1 unit 0 family mpls set interfaces lo0 unit 0 family inet address 10.255.112.2/32 primary set interfaces lo0 unit 0 family inet address 10.255.112.2/32 preferred set interfaces lo0 unit 0 family iso address 49.0002.0192.0168.0002.00 set routing-options router-id 10.255.112.2 set protocols mpls interface ge-0/0/0.0 set protocols mpls interface ge-0/0/1.0 set protocols ospf area 0.0.0.0 interface ge-0/0/1.0 set protocols ospf area 0.0.0.0 interface lo0.0 passive set protocols ospf area 0.0.0.1 interface ge-0/0/0.0 set protocols ldp longest-match set protocols ldp interface ge-0/0/0.0 set protocols ldp interface ge-0/0/1.0 set protocols ldp interface lo0.0

R2

set interfaces ge-0/0/0 unit 0 family inet address 24.24.24.1/24 set interfaces ge-0/0/0 unit 0 family iso set interfaces ge-0/0/0 unit 0 family mpls set interfaces ge-0/0/1 unit 0 family inet address 12.12.12.2/24 set interfaces ge-0/0/1 unit 0 family iso set interfaces ge-0/0/1 unit 0 family mpls set interfaces ge-0/0/2 unit 0 family inet address 23.23.23.1/24 set interfaces ge-0/0/2 unit 0 family iso set interfaces ge-0/0/2 unit 0 family mpls set interfaces ge-0/0/3 unit 0 family inet address 22.22.22.2/24 set interfaces ge-0/0/4 unit 0 family inet address 25.25.25.1/24 set interfaces ge-0/0/4 unit 0 family iso set interfaces ge-0/0/4 unit 0 family mpls set interfaces lo0 unit 0 family inet address 10.255.111.4/32 primary set interfaces lo0 unit 0 family inet address 10.255.111.4/32 preferred set interfaces lo0 unit 0 family iso address 49.0003.0192.0168.0003.00 set routing-options router-id 10.255.111.4 set protocols mpls interface ge-0/0/1.0 set protocols mpls interface ge-0/0/2.0 set protocols mpls interface ge-0/0/0.0 set protocols mpls interface ge-0/0/4.0 set protocols ospf area 0.0.0.0 interface ge-0/0/1.0 set protocols ospf area 0.0.0.0 interface lo0.0 passive set protocols ospf area 0.0.0.2 area-range 10.255.111.0/24 set protocols ospf area 0.0.0.2 interface ge-0/0/2.0 set protocols ospf area 0.0.0.2 interface ge-0/0/0.0 set protocols ospf area 0.0.0.2 interface ge-0/0/4.0 set protocols ldp interface ge-0/0/0.0 set protocols ldp interface ge-0/0/1.0 set protocols ldp interface ge-0/0/2.0 set protocols ldp interface ge-0/0/4.0 set protocols ldp interface lo0.0

R3

set interfaces ge-0/0/0 unit 0 family inet address 35.35.35.1/24 set interfaces ge-0/0/0 unit 0 family iso set interfaces ge-0/0/0 unit 0 family mpls set interfaces ge-0/0/1 unit 0 family inet address 23.23.23.2/24 set interfaces ge-0/0/1 unit 0 family iso set interfaces ge-0/0/1 unit 0 family mpls set interfaces ge-0/0/2 unit 0 family inet address 34.34.34.1/24 set interfaces ge-0/0/2 unit 0 family iso set interfaces ge-0/0/2 unit 0 family mpls set interfaces lo0 unit 0 family inet address 10.255.111.1/32 primary set interfaces lo0 unit 0 family inet address 10.255.111.1/32 preferred set interfaces lo0 unit 0 family iso address 49.0003.0192.0168.0004.00 set routing-options router-id 10.255.111.1 set protocols mpls interface ge-0/0/1.0 set protocols ospf area 0.0.0.2 interface ge-0/0/1.0 set protocols ospf area 0.0.0.2 interface fxp0.0 disable set protocols ospf area 0.0.0.2 interface lo0.0 passive set protocols ldp interface ge-0/0/1.0 set protocols ldp interface lo0.0

R4

set interfaces ge-0/0/0 unit 0 family inet address 45.45.45.1/24 set interfaces ge-0/0/0 unit 0 family iso set interfaces ge-0/0/0 unit 0 family mpls set interfaces ge-0/0/1 unit 0 family inet address 24.24.24.2/24 set interfaces ge-0/0/1 unit 0 family iso set interfaces ge-0/0/1 unit 0 family mpls set interfaces ge-0/0/2 unit 0 family inet address 34.34.34.2/24 set interfaces ge-0/0/2 unit 0 family iso set interfaces ge-0/0/2 unit 0 family mpls set interfaces lo0 unit 0 family inet address 10.255.111.2/32 primary set interfaces lo0 unit 0 family inet address 10.255.111.2/32 preferred set interfaces lo0 unit 0 family iso address 49.0003.0192.0168.0005.00 set routing-options router-id 10.255.111.2 set protocols mpls interface ge-0/0/1.0 set protocols ospf area 0.0.0.2 interface ge-0/0/1.0 set protocols ospf area 0.0.0.2 interface fxp0.0 disable set protocols ospf area 0.0.0.2 interface lo0.0 passive set protocols ldp interface ge-0/0/1.0 set protocols ldp interface lo0.0

R5

set interfaces ge-0/0/0 unit 0 family inet address 25.25.25.2/24 set interfaces ge-0/0/0 unit 0 family iso set interfaces ge-0/0/0 unit 0 family mpls set interfaces ge-0/0/1 unit 0 family inet address 15.15.15.2/24 set interfaces ge-0/0/2 unit 0 family inet address 35.35.35.2/24 set interfaces ge-0/0/3 unit 0 family inet address 45.45.45.2/24 set interfaces ge-0/0/3 unit 0 family iso set interfaces ge-0/0/3 unit 0 family mpls set interfaces lo0 unit 0 family inet address 10.255.111.3/32 primary set interfaces lo0 unit 0 family inet address 10.255.111.3/32 preferred set interfaces lo0 unit 0 family iso address 49.0003.0192.0168.0006.00 set routing-options router-id 10.255.111.3 set protocols mpls interface ge-0/0/0.0 set protocols ospf area 0.0.0.2 interface ge-0/0/0.0 set protocols ospf area 0.0.0.2 interface fxp0.0 disable set protocols ospf area 0.0.0.2 interface lo0.0 passive set protocols ldp interface ge-0/0/0.0 set protocols ldp interface lo0.0

デバイスR0の設定

ステップバイステップの手順

次の例では、設定階層内のさまざまなレベルに移動する必要があります。CLIのナビゲーションについては、『CLIユーザーガイド』の「設定モードでのCLIエディターの使用」を参照してください。

デバイスR0を設定するには:

インターフェイスを設定します。

[edit interfaces] set ge-0/0/0 unit 0 family inet address 22.22.22.1/24 set ge-0/0/1 unit 0 family inet address 15.15.15.1/24 set ge-0/0/2 unit 0 family inet address 11.11.11.1/24 set ge-0/0/2 unit 0 family iso set ge-0/0/2 unit 0 family mpls

デバイスにループバックアドレスを割り当てます。

[edit interfaces lo0 unit 0 family] set inet address 10.255.112.1/32 primary set inet address 10.255.112.1/32 preferred set iso address 49.0002.0192.0168.0001.00

ルーターIDを設定します。

[edit routing-options] set router-id 10.255.112.1

インターフェイスに MPLS プロトコルを設定します。

[edit protocols mpls] set interface ge-0/0/2.0

インターフェイスに OSPF プロトコルを設定します。

[edit protocols ospf] set area 0.0.0.1 interface ge-0/0/2.0 set area 0.0.0.1 interface lo0.0 passive

LDPプロトコルのロンゲストマッチを設定します。

[edit protocols ldp] set longest-match

インターフェイスにLDPプロトコルを設定します。

[edit protocols ldp] set interface ge-0/0/2.0 set interface lo0.0

結果

設定モードから、 show interfaces、 show protocols、 show routing-options コマンドを入力して設定を確認します。出力に意図した設定が表示されない場合は、この例の手順を繰り返して設定を修正します。

user@R0# show interfaces

ge-0/0/0 {

unit 0 {

family inet {

address 22.22.22.1/24;

}

}

}

ge-0/0/1 {

unit 0 {

family inet {

address 15.15.15.1/24;

}

}

}

ge-0/0/2 {

unit 0 {

family inet {

address 11.11.11.1/24;

}

family iso;

family mpls;

}

}

lo0 {

unit 0 {

family inet {

address 10.255.112.1/32 {

primary;

preferred;

}

}

family iso {

address 49.0002.0192.0168.0001.00;

}

}

}

user@R0# show protocols

mpls {

interface ge-0/0/2.0;

}

ospf {

area 0.0.0.1 {

interface ge-0/0/2.0;

interface lo0.0 {

passive;

}

}

}

ldp {

longest-match;

interface ge-0/0/2.0;

interface lo0.0;

}

user@R0# show routing-options router-id 10.255.112.1;

デバイスの設定が完了したら、設定モードから commit を入力します。

検証

設定が正常に機能していることを確認します。

ルートの検証

目的

期待ルートが学習されていることを確認します。

アクション

デバイスR0では、運用モードから show route コマンドを実行して、ルーティングテーブル内のルートを表示します。

user@R0> show route

inet.0: 62 destinations, 62 routes (62 active, 0 holddown, 0 hidden)

+ = Active Route, - = Last Active, * = Both

10.4.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.5.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.6.128.0/17 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.9.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.10.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.13.4.0/23 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.13.10.0/23 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.82.0.0/15 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.84.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.85.12.0/22 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.92.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.92.16.0/20 *[Direct/0] 10:08:01

> via fxp0.0

10.92.20.175/32 *[Local/0] 10:08:01

Local via fxp0.0

10.94.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.99.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.102.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.150.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.155.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.157.64.0/19 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.160.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.204.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.205.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.206.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.207.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.209.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.212.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.213.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.214.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.215.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.216.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.218.13.0/24 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.218.14.0/24 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.218.16.0/20 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.218.32.0/20 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.227.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

10.255.111.0/24 *[OSPF/10] 09:52:14, metric 3

> to 11.11.11.2 via ge-0/0/2.0

10.255.111.4/32 *[OSPF/10] 09:54:10, metric 2

> to 11.11.11.2 via ge-0/0/2.0

10.255.112.1/32 *[Direct/0] 09:55:05

> via lo0.0

10.255.112.2/32 *[OSPF/10] 09:54:18, metric 1

> to 11.11.11.2 via ge-0/0/2.0

11.11.11.0/24 *[Direct/0] 09:55:05

> via ge-0/0/2.0

11.11.11.1/32 *[Local/0] 09:55:05

Local via ge-0/0/2.0

12.12.12.0/24 *[OSPF/10] 09:54:18, metric 2

> to 11.11.11.2 via ge-0/0/2.0

15.15.15.0/24 *[Direct/0] 09:55:05

> via ge-0/0/1.0

15.15.15.1/32 *[Local/0] 09:55:05

Local via ge-0/0/1.0

22.22.22.0/24 *[Direct/0] 09:55:05

> via ge-0/0/0.0

22.22.22.1/32 *[Local/0] 09:55:05

Local via ge-0/0/0.0

23.23.23.0/24 *[OSPF/10] 09:54:10, metric 3

> to 11.11.11.2 via ge-0/0/2.0

24.24.24.0/24 *[OSPF/10] 09:54:10, metric 3

> to 11.11.11.2 via ge-0/0/2.0

25.25.25.0/24 *[OSPF/10] 09:54:10, metric 3

> to 11.11.11.2 via ge-0/0/2.0

128.92.17.45/32 *[OSPF/10] 09:54:05, metric 3

> to 11.11.11.2 via ge-0/0/2.0

128.92.20.175/32 *[Direct/0] 10:08:01

> via lo0.0

128.92.21.186/32 *[OSPF/10] 09:54:10, metric 3

> to 11.11.11.2 via ge-0/0/2.0

128.92.25.135/32 *[OSPF/10] 09:54:10, metric 3

> to 11.11.11.2 via ge-0/0/2.0

128.92.27.91/32 *[OSPF/10] 09:54:18, metric 1

> to 11.11.11.2 via ge-0/0/2.0

128.92.28.70/32 *[OSPF/10] 09:54:10, metric 2

> to 11.11.11.2 via ge-0/0/2.0

172.16.0.0/12 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

192.168.0.0/16 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

192.168.102.0/23 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

207.17.136.0/24 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

207.17.136.192/32 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

207.17.137.0/24 *[Static/5] 10:08:01

> to 10.92.31.254 via fxp0.0

224.0.0.5/32 *[OSPF/10] 09:55:05, metric 1

MultiRecv

inet.3: 5 destinations, 5 routes (5 active, 0 holddown, 0 hidden)

+ = Active Route, - = Last Active, * = Both

10.255.111.1/32 *[LDP/9] 09:41:03, metric 3

> to 11.11.11.2 via ge-0/0/2.0, Push 300128

10.255.111.2/32 *[LDP/9] 09:41:03, metric 3

> to 11.11.11.2 via ge-0/0/2.0, Push 300144

10.255.111.3/32 *[LDP/9] 09:41:03, metric 3

> to 11.11.11.2 via ge-0/0/2.0, Push 300160

10.255.111.4/32 *[LDP/9] 09:54:10, metric 2, tag 0

> to 11.11.11.2 via ge-0/0/2.0, Push 300000

10.255.112.2/32 *[LDP/9] 09:54:48, metric 1, tag 0

> to 11.11.11.2 via ge-0/0/2.0

iso.0: 2 destinations, 2 routes (2 active, 0 holddown, 0 hidden)

+ = Active Route, - = Last Active, * = Both

47.0005.80ff.f800.0000.0108.0001.1280.9202.0175/152

*[Direct/0] 10:08:01

> via lo0.0

49.0002.0192.0168.0001/72

*[Direct/0] 09:55:05

> via lo0.0

mpls.0: 10 destinations, 10 routes (10 active, 0 holddown, 0 hidden)

+ = Active Route, - = Last Active, * = Both

0 *[MPLS/0] 09:55:05, metric 1

Receive

1 *[MPLS/0] 09:55:05, metric 1

Receive

2 *[MPLS/0] 09:55:05, metric 1

Receive

13 *[MPLS/0] 09:55:05, metric 1

Receive

300064 *[LDP/9] 09:54:48, metric 1

> to 11.11.11.2 via ge-0/0/2.0, Pop

300064(S=0) *[LDP/9] 09:54:48, metric 1

> to 11.11.11.2 via ge-0/0/2.0, Pop

300112 *[LDP/9] 09:54:10, metric 2, tag 0

> to 11.11.11.2 via ge-0/0/2.0, Swap 300000

300192 *[LDP/9] 09:41:03, metric 3

> to 11.11.11.2 via ge-0/0/2.0, Swap 300128

300208 *[LDP/9] 09:41:03, metric 3

> to 11.11.11.2 via ge-0/0/2.0, Swap 300144

300224 *[LDP/9] 09:41:03, metric 3

> to 11.11.11.2 via ge-0/0/2.0, Swap 300160

inet6.0: 2 destinations, 2 routes (2 active, 0 holddown, 0 hidden)

+ = Active Route, - = Last Active, * = Both

abcd::128:92:20:175/128

*[Direct/0] 10:08:01

> via lo0.0

fe80::5668:a50f:fcc1:1f9c/128

*[Direct/0] 10:08:01

> via lo0.0

意味

出力は、デバイスR0のルーティングテーブル内のすべてのルートを示しています。

LDPの概要情報の検証

目的

LDPの概要情報を表示します。

アクション

デバイスR0では、運用モードから show ldp overview コマンドを実行し、LDPの概要を表示します。

user@R0> show ldp overview

Instance: master

Reference count: 2

Router ID: 10.255.112.1

Message id: 8

Configuration sequence: 6

Deaggregate: disabled

Explicit null: disabled

IPv6 tunneling: disabled

Strict targeted hellos: disabled

Loopback if added: yes

Route preference: 9

Unicast transit LSP chaining: disabled

P2MP transit LSP chaining: disabled

Transit LSP statistics based on route statistics: disabled

LDP route acknowledgement: enabled

LDP mtu discovery: disabled

Longest Match: enabled

Capabilities enabled: none

Egress FEC capabilities enabled: entropy-label-capability

Downstream unsolicited Sessions:

Operational: 1

Retention: liberal

Control: ordered

Auto targeted sessions:

Auto targeted: disabled

Timers:

Keepalive interval: 10, Keepalive timeout: 30

Link hello interval: 5, Link hello hold time: 15

Targeted hello interval: 15, Targeted hello hold time: 45

Label withdraw delay: 60, Make before break timeout: 30

Make before break switchover delay: 3

Link protection timeout: 120

Graceful restart:

Restart: disabled, Helper: enabled, Restart in process: false

Reconnect time: 60000, Max neighbor reconnect time: 120000

Recovery time: 160000, Max neighbor recovery time: 240000

Traffic Engineering:

Bgp igp: disabled

Both ribs: disabled

Mpls forwarding: disabled

IGP:

Tracking igp metric: disabled

Sync session up delay: 10

Session protection:

Session protection: disabled

Session protection timeout: 0

Interface addresses advertising:

11.11.11.1

10.255.112.1

128.92.20.175

Label allocation:

Current number of LDP labels allocated: 5

Total number of LDP labels allocated: 11

Total number of LDP labels freed: 6

Total number of LDP label allocation failure: 0

Current number of labels allocated by all protocols: 5

意味

出力で、デバイスR0のLDPの概要情報が表示されます。

内部トポロジーテーブル内のLDPエントリーの検証

目的

ラベル配布プロトコル(LDP)内部トポロジーテーブル内のルートエントリーを表示します。

アクション

デバイスR0では、運用モードから show ldp route コマンドを実行して、LDPの内部トポロジーテーブルを表示します。

user@R0> show ldp route

Destination Next-hop intf/lsp/table Next-hop address

10.4.0.0/16 fxp0.0 10.92.31.254

10.5.0.0/16 fxp0.0 10.92.31.254

10.6.128.0/17 fxp0.0 10.92.31.254

10.9.0.0/16 fxp0.0 10.92.31.254

10.10.0.0/16 fxp0.0 10.92.31.254

10.13.4.0/23 fxp0.0 10.92.31.254

10.13.10.0/23 fxp0.0 10.92.31.254

10.82.0.0/15 fxp0.0 10.92.31.254

10.84.0.0/16 fxp0.0 10.92.31.254

10.85.12.0/22 fxp0.0 10.92.31.254

10.92.0.0/16 fxp0.0 10.92.31.254

10.92.16.0/20 fxp0.0

10.92.20.175/32

10.94.0.0/16 fxp0.0 10.92.31.254

10.99.0.0/16 fxp0.0 10.92.31.254

10.102.0.0/16 fxp0.0 10.92.31.254

10.150.0.0/16 fxp0.0 10.92.31.254

10.155.0.0/16 fxp0.0 10.92.31.254

10.157.64.0/19 fxp0.0 10.92.31.254

10.160.0.0/16 fxp0.0 10.92.31.254

10.204.0.0/16 fxp0.0 10.92.31.254

10.205.0.0/16 fxp0.0 10.92.31.254

10.206.0.0/16 fxp0.0 10.92.31.254

10.207.0.0/16 fxp0.0 10.92.31.254

10.209.0.0/16 fxp0.0 10.92.31.254

10.212.0.0/16 fxp0.0 10.92.31.254

10.213.0.0/16 fxp0.0 10.92.31.254

10.214.0.0/16 fxp0.0 10.92.31.254

10.215.0.0/16 fxp0.0 10.92.31.254

10.216.0.0/16 fxp0.0 10.92.31.254

10.218.13.0/24 fxp0.0 10.92.31.254

10.218.14.0/24 fxp0.0 10.92.31.254

10.218.16.0/20 fxp0.0 10.92.31.254

10.218.32.0/20 fxp0.0 10.92.31.254

10.227.0.0/16 fxp0.0 10.92.31.254

10.255.111.0/24 ge-0/0/2.0 11.11.11.2

10.255.111.4/32 ge-0/0/2.0 11.11.11.2

10.255.112.1/32 lo0.0

10.255.112.2/32 ge-0/0/2.0 11.11.11.2

11.11.11.0/24 ge-0/0/2.0

11.11.11.1/32

12.12.12.0/24 ge-0/0/2.0 11.11.11.2

15.15.15.0/24 ge-0/0/1.0

15.15.15.1/32

22.22.22.0/24 ge-0/0/0.0

22.22.22.1/32

23.23.23.0/24 ge-0/0/2.0 11.11.11.2

24.24.24.0/24 ge-0/0/2.0 11.11.11.2

25.25.25.0/24 ge-0/0/2.0 11.11.11.2

128.92.17.45/32 ge-0/0/2.0 11.11.11.2

128.92.20.175/32 lo0.0

128.92.21.186/32 ge-0/0/2.0 11.11.11.2

128.92.25.135/32 ge-0/0/2.0 11.11.11.2

128.92.27.91/32 ge-0/0/2.0 11.11.11.2

128.92.28.70/32 ge-0/0/2.0 11.11.11.2

172.16.0.0/12 fxp0.0 10.92.31.254

192.168.0.0/16 fxp0.0 10.92.31.254

192.168.102.0/23 fxp0.0 10.92.31.254

207.17.136.0/24 fxp0.0 10.92.31.254

207.17.136.192/32 fxp0.0 10.92.31.254

207.17.137.0/24 fxp0.0 10.92.31.254

224.0.0.5/32

意味

出力で、デバイスR0のラベル配布プロトコル(LDP)内部トポロジーテーブル内のルートエントリーが表示されます。

LDPルートのFEC情報のみの検証

目的

LDPルートのFEC情報のみを表示します。

アクション

デバイスR0では、運用モードから show ldp route fec-only コマンドを実行して、ルーティングテーブル内のルートを表示します。

user@R0> show ldp route fec-only

Destination Next-hop intf/lsp/table Next-hop address

10.255.111.1/32 ge-0/0/2.0 11.11.11.2

10.255.111.2/32 ge-0/0/2.0 11.11.11.2

10.255.111.3/32 ge-0/0/2.0 11.11.11.2

10.255.111.4/32 ge-0/0/2.0 11.11.11.2

10.255.112.1/32 lo0.0

10.255.112.2/32 ge-0/0/2.0 11.11.11.2

意味

出力には、デバイスR0で利用可能なLDPプロトコルのFECルートのみが表示されます。

LDPのFECおよびシャドウルートの検証

目的

ルーティングテーブル内のFECとシャドウルートを表示します。

アクション

デバイスR0では、運用モードから show ldp route fec-and-route コマンドを実行し、ルーティングテーブル内のFECとシャドウルートを表示します。

user@R0> show ldp route fec-and-route

Destination Next-hop intf/lsp/table Next-hop address

10.4.0.0/16 fxp0.0 10.92.31.254

10.5.0.0/16 fxp0.0 10.92.31.254

10.6.128.0/17 fxp0.0 10.92.31.254

10.9.0.0/16 fxp0.0 10.92.31.254

10.10.0.0/16 fxp0.0 10.92.31.254

10.13.4.0/23 fxp0.0 10.92.31.254

10.13.10.0/23 fxp0.0 10.92.31.254

10.82.0.0/15 fxp0.0 10.92.31.254

10.84.0.0/16 fxp0.0 10.92.31.254

10.85.12.0/22 fxp0.0 10.92.31.254

10.92.0.0/16 fxp0.0 10.92.31.254

10.92.16.0/20 fxp0.0

10.92.20.175/32

10.94.0.0/16 fxp0.0 10.92.31.254

10.99.0.0/16 fxp0.0 10.92.31.254

10.102.0.0/16 fxp0.0 10.92.31.254

10.150.0.0/16 fxp0.0 10.92.31.254

10.155.0.0/16 fxp0.0 10.92.31.254

10.157.64.0/19 fxp0.0 10.92.31.254

10.160.0.0/16 fxp0.0 10.92.31.254

10.204.0.0/16 fxp0.0 10.92.31.254

10.205.0.0/16 fxp0.0 10.92.31.254

10.206.0.0/16 fxp0.0 10.92.31.254

10.207.0.0/16 fxp0.0 10.92.31.254

10.209.0.0/16 fxp0.0 10.92.31.254

10.212.0.0/16 fxp0.0 10.92.31.254

10.213.0.0/16 fxp0.0 10.92.31.254

10.214.0.0/16 fxp0.0 10.92.31.254

10.215.0.0/16 fxp0.0 10.92.31.254

10.216.0.0/16 fxp0.0 10.92.31.254

10.218.13.0/24 fxp0.0 10.92.31.254

10.218.14.0/24 fxp0.0 10.92.31.254

10.218.16.0/20 fxp0.0 10.92.31.254

10.218.32.0/20 fxp0.0 10.92.31.254

10.227.0.0/16 fxp0.0 10.92.31.254

10.255.111.0/24 ge-0/0/2.0 11.11.11.2

10.255.111.1/32 ge-0/0/2.0 11.11.11.2

10.255.111.2/32 ge-0/0/2.0 11.11.11.2

10.255.111.3/32 ge-0/0/2.0 11.11.11.2

10.255.111.4/32 ge-0/0/2.0 11.11.11.2

10.255.111.4/32 ge-0/0/2.0 11.11.11.2

10.255.112.1/32 lo0.0

10.255.112.1/32 lo0.0

10.255.112.2/32 ge-0/0/2.0 11.11.11.2

10.255.112.2/32 ge-0/0/2.0 11.11.11.2

11.11.11.0/24 ge-0/0/2.0

11.11.11.1/32

12.12.12.0/24 ge-0/0/2.0 11.11.11.2

15.15.15.0/24 ge-0/0/1.0

15.15.15.1/32

22.22.22.0/24 ge-0/0/0.0

22.22.22.1/32

23.23.23.0/24 ge-0/0/2.0 11.11.11.2

24.24.24.0/24 ge-0/0/2.0 11.11.11.2

25.25.25.0/24 ge-0/0/2.0 11.11.11.2

128.92.17.45/32 ge-0/0/2.0 11.11.11.2

128.92.20.175/32 lo0.0

128.92.21.186/32 ge-0/0/2.0 11.11.11.2

128.92.25.135/32 ge-0/0/2.0 11.11.11.2

128.92.27.91/32 ge-0/0/2.0 11.11.11.2

128.92.28.70/32 ge-0/0/2.0 11.11.11.2

172.16.0.0/12 fxp0.0 10.92.31.254

192.168.0.0/16 fxp0.0 10.92.31.254

192.168.102.0/23 fxp0.0 10.92.31.254

207.17.136.0/24 fxp0.0 10.92.31.254

207.17.136.192/32 fxp0.0 10.92.31.254

207.17.137.0/24 fxp0.0 10.92.31.254

224.0.0.5/32

意味

出力には、デバイスR0のFECとシャドウルートが表示されます。

LDPルート設定の構成

複数のプロトコルが同じ宛先へのルートを計算する場合、ルート設定を使用して、転送テーブルにインストールするルートを選択します。優先度の最も低いルートが選択されます。優先度は、0〜255の数値を指定することができます。デフォルトでは、LDPルートの優先度は9です。

ルート設定を変更するには、 preference ステートメントを含めます。

preference preference;

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

LDPグレースフルリスタート

LDPグレースフルリスタートにより、LDPコントロールプレーン再起動中のルーターは、隣接ルーターからその状態を回復しながらも、トラフィックの転送を継続できます。また、ヘルパーモードが有効になっているルーターが、LDP再起動を試みている隣接ルーターを補助することを可能にします。

セッション初期中に、ルーターは、LDPグレースフルリスタートを実行する機能、またはグレースフルリスタートTLVを送信することによって、LDPグレースフルリスタートを実行しているネイバーを利用する機能をアドバタイズします。このTLVには、LDPグレースフルリスタートに関連する2つのフィールド(再接続時間と回復時間)が含まれています。再接続および回復時間の値は、ルーターでサポートされているグレースフル リスタート機能を示しています。

隣接するルーターの再起動を検出したルーターは、回復時間の終了まで待機してから再接続を試みます。回復時間は、LDPが正常に再起動するまでルーターが待機する時間です。回復時間は、初期化メッセージが送信または受信されると開始します。また、この時間帯は、通常、隣接するルーターが再起動ルーターに関する情報を維持する時間で、これによりトラフィックの転送を継続できるようにします。

LDPグレースフルリスタートは、LDPプロトコルのマスターインスタンスと特定のルーティングインスタンスの両方で設定できます。グレースフルリスタートは、すべてのプロトコルのグローバルレベル、LDPのみのプロトコルレベル、特定のルーティングインスタンスで無効にすることができます。グローバルレベルではグレースフルリスタートがデフォルトで無効になっているため、LDPグレースフルリスタートはデフォルトで無効になっています。ただし、ヘルパーモード(グレースフルリスタートを試みる隣接ルーターを支援する機能)はデフォルトで有効になっています。

以下は、LDPグレースフルリスタートに関連する動作の一部です。

送信ラベルは再起動時に維持されません。新しい送信ラベルが割り当てられます。

ルーターが再起動すると、再起動中のルーターが安定するまでグレースフルリスタートをサポートする隣接ルーターにラベルマップメッセージは送信されません(ラベルマップメッセージは、グレースフルリスタートをサポートしない隣接ルーターには直ちに送信されます)。ただし、その他のメッセージ(キープアライブ、アドレスメッセージ、通知、リリース)は通常通りに送信されます。これらのその他のメッセージを配信することで、ルーターが不完全な情報を配信するのを防ぎます。

ヘルパーモードとグレースフルリスタートは独立したものです。グレースフルリスタートを設定で無効にしても、グレースフルリスタートを試みようとする隣接するものにルーターが協力することは可能です。

LDPグレースフルリスタートの設定

[edit routing-options graceful-restart]または[edit protocols ldp graceful-restart]階層レベルでグレースフルリスタート設定を変更すると、実行中のLDPセッションが自動的に再起動され、グレースフルリスタート設定が適用されます。この動作は、グレースフルリスタート設定を変更したときのBGPの動作を反映しています。

デフォルトでは、グレースフルリスタートヘルパーモードは有効になっていますが、グレースフルリスタートは無効になっています。したがって、ルーターのデフォルトの動作は、隣接ルーターがグレースフルリスタートを試行するのを支援することですが、グレースフルリスタート自体を試行することはありません。

LDPグレースフルリスタートを設定するには、次のセクションを参照してください。

グレースフル リスタートの有効化

LDPグレースフルリスタートを有効にするには、ルーターでもグレースフルリスタートを有効にする必要があります。グレースフル リスタートを有効にするには、 graceful-restart ステートメントを含めます。

graceful-restart;

以下の階層レベルでこのステートメントを含めることができます。

[edit routing-options][edit logical-systems logical-system-name routing-options]

ACXシリーズルーターは[edit logical-systems logical-system-name routing-options]階層レベルをサポートしていません。

graceful-restartステートメントは、ルーター上でこの機能をサポートするすべてのプロトコルのグレースフルリスタートを有効にします。グレースフル リスタートの詳細については、ルーティング デバイス用 Junos OS ルーティング プロトコル ライブラリを参照してください。

デフォルトでは、LDPプロトコルレベルとすべてのルーティングインスタンスの両方でグレースフルリスタートを有効にすると、LDPグレースフルリスタートが有効になります。ただし、LDPグレースフルリスタートとLDPグレースフルリスタートヘルパーモードの両方を無効にすることができます。

LDPグレースフルリスタートまたはヘルパーモードの無効化

LDPグレースフルリスタートと回復を無効にするには、 disable ステートメントを含めます。

ldp {

graceful-restart {

disable;

}

}

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

LDPプロトコルレベルでのみヘルパーモードを無効にできます。特定のルーティングインスタンスではヘルパーモードを無効にすることはできません。LDPヘルパーモードを無効にするには、 helper-disable ステートメントを含めます。

ldp {

graceful-restart {

helper-disable;

}

}

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

LDPグレースフルリスタートの設定は、次のものが可能です。

LDPグレースフルリスタートとヘルパーモードの両方が有効です。

LDPグレースフルリスタートは無効ですが、ヘルパーモードは有効です。このように設定されたルーターは正常に再起動できませんが、ネイバーの再起動には役立ちます。

LDPグレースフルリスタートとヘルパーモードの両方が無効です。ルーターは、LDPグレースフルリスタート、または初期化メッセージで送信されたグレースフルリスタートのタイプ、長さ、および値(TLV)を使用しません。ルーターは、LDPグレースフルリスタートをサポートできないルーターとして動作します。

グレースフルリスタートを有効にし、ヘルパーモードを無効にしようとすると、設定エラーが発行されます。

再接続時間の設定

ネイバー間のLDP接続に障害が発生した後、ネイバーは、正常に再起動しているルーターがLDPメッセージの送信を再開するまで一定時間待機します。待機時間が経過すると、LDPセッションを再確立できます。待機時間は秒単位で設定できます。この値は、LDPグレースフルリスタートが有効になっている場合にLDP初期化メッセージで送信される耐障害性セッションTLVに含まれます。

ルーターAとルーターBがLDPネイバーであると仮定します。ルーターAは、再起動ルーターです。再接続時間は、ルーターBがルーターAの再起動を検出した後、ルーターAがルーターBに待機するように指示する時間です。

再接続時間を設定するには、 reconnect-time ステートメントを含めます。

graceful-restart { reconnect-time seconds; }

再接続時間は30〜300秒の範囲で設定できます。デフォルトでは、60秒です。

これらのステートメントを設定できる階層レベルの一覧については、これらのステートメントのステートメント概要セクションを参照してください。

回復時間と最大回復時間の設定

回復時間は、LDPが正常に再起動するまでルーターが待機する時間です。回復時間は、初期化メッセージが送信または受信されると開始します。また、この期間は、通常、隣接するルーターが再起動ルーターに関する情報を維持する時間で、これによりトラフィックの転送を継続できます。

再起動しているルーターから回復時間の誤った値を受け取った場合に隣接ルーターが悪影響を受けるのを防ぐために、隣接ルーターで最大回復時間を設定できます。隣接するルーターは、2つの時間のうち短い方の時間でその状態を維持します。例えば、ルーターAはLDPグレースフルリスタートを実行しています。隣接するルーターBに900秒の回復時間を送信しました。ただし、ルーターBの最大回復時間は400秒に設定されています。ルーターBは、ルーターAからLDP情報を削除する前に400秒だけ待機します。

回復時間を設定するには、 recovery-time ステートメントと maximum-neighbor-recovery-time ステートメントを含めます。

graceful-restart { maximum-neighbor-recovery-time seconds; recovery-time seconds; }

これらのステートメントを設定できる階層レベルの一覧については、これらのステートメントのステートメント概要セクションを参照してください。

インバウンドLDPラベルバインディングのフィルタリング

受信したLDPラベルバインディングをフィルタリングし、近隣のルーターからアドバタイズされたバインディングを受け入れるか拒否するかのポリシーを適用することができます。受信ラベルフィルタリングを設定するには、 import ステートメントを含めます。

import [ policy-names ];

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

指定されたポリシー( [edit policy-options] 階層レベルで設定)は、すべてのLDPネイバーから受信したすべてのラベルバインディングに適用されます。すべてのフィルタリングは、 from ステートメントで行われます。 表1 は、LDP受信ラベルフィルタリングに適用される from 演算子のみを示しています。

from オペレーター |

説明 |

|---|---|

|

指定されたインターフェイス上で隣接するネイバーから受信したバインディングにマッチする |

|

指定されたLDPルーターIDから受信したバインディングにマッチする |

|

指定したインターフェースアドレスをアドバタイズしているネイバーから受信したバインディングにマッチする |

|

指定されたプレフィックスを持つバインディングに一致します |

バインディングがフィルタリングされた場合、LDP データベースには表示されますが、ラベル スイッチ パス(LSP)の一部としてインストールされることは考慮されません。

一般に、LDP でのポリシー適用は、LSP の確立を阻止するためにのみ使用でき、そのルーティングを制御するために使用できるわけではありません。これは、LSP がたどる経路は、LDP ではなく、ユニキャストルーティングによって決定されるためです。しかし、異なるネイバーを経由して宛先へのイコールコストパスが複数存在する場合、LDPフィルタリングを使用して、可能性のあるネクストホップの一部を考慮から除外することができます。(それ以外の場合、LDPはネクストホップの候補の中からランダムに1つを選択します)。

LDPセッションは、インターフェイスやインターフェイスアドレスにバインドされません。LDPは、ルーター単位(インターフェイス単位ではなく)のラベルのみをアドバタイズします。そのため、2つのルーター間に複数のパラレルリンクが存在する場合、1つのLDPセッションのみが確立され、単一のインターフェイスにバインドされません。ルーターが同じネイバーに複数の隣接関係を持つ場合、フィルターが期待通りの働きをするように注意してください。(一般的に、この場合、 next-hop と interface の使用は適切ではありません)。

ラベルがフィルタリングされた場合(ポリシーによって拒否され、LSPの構築に使用されないことを意味する)、データベース内でフィルタリング済みとしてマークされます。

user@host> show ldp database Input label database, 10.10.255.1:0-10.10.255.6:0 Label Prefix 3 10.10.255.6/32 (Filtered) Output label database, 10.10.255.1:0-10.10.255.6:0 Label Prefix 3 10.10.255.1/32 (Filtered)

LDPのポリシーを設定する方法についての詳細は 、ルーティングポリシー、ファイアウォールフィルター、トラフィックポリサーユーザーガイドを参照してください。

例:インバウンドLDPラベルバインディングのフィルタリング

すべてのネイバーから/32プレフィックスのみを受け入れます。

[edit]

protocols {

ldp {

import only-32;

...

}

}

policy-options {

policy-statement only-32 {

term first {

from {

route-filter 0.0.0.0/0 upto /31;

}

then reject;

}

then accept;

}

}

ルーター ID 10.10.255.2からは 131.108/16 以上を受け入れ、他のすべてのネイバーからはすべてのプレフィックスを受け入れます。

[edit]

protocols {

ldp {

import nosy-neighbor;

...

}

}

policy-options {

policy-statement nosy-neighbor {

term first {

from {

neighbor 10.10.255.2;

route-filter 131.108.0.0/16 orlonger accept;

route-filter 0.0.0.0/0 orlonger reject;

}

}

then accept;

}

}

アウトバウンドLDPラベルバインディングのフィルタリング

エクスポートポリシーを設定して、LDPアウトバウンドラベルをフィルタリングできます。ルーティングポリシーを適用することで、アウトバウンドラベルバインディングをフィルタリングし、バインディングが隣接ルーターにアドバタイズされることをブロックできます。アウトバウンドラベルフィルタリングを設定するには、 export ステートメントを含めます。

export [policy-name];

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

指名されたエクスポートポリシー( [edit policy-options] 階層レベルで設定)は、すべてのLDPネイバーに送信されるすべてのラベルバインディングに適用されます。LDPアウトバウンドラベルフィルタリングに適用される唯一の from 運用担当者は route-filterで、指定されたプレフィックスのバインディングに一致します。アウトバウンドラベルフィルタリングに適用できる唯一の to 演算子は、 表2の演算子です。

to演算子 |

説明 |

|---|---|

|

指定されたインターフェイス上に隣接するネイバーに送信されたバインディングに一致 |

|

指定されたLDPルーターIDに送信されたバインディングに一致 |

|

指定されたインターフェイスアドレスをアドバタイズするネイバーに送信されたバインディングに一致 |

バインディングがフィルター処理されると、そのバインディングは隣接するルーターにはアドバタイズされませんが、ローカルルーターのLSPの一部としてインストールすることは可能です。LDPにポリシーを適用して、LSPの確立をブロックすることはできますが、そのルーティングを制御することはできません。LSPがたどるパスは、LDPではなく、ユニキャストルーティングによって決定されます。

LDPセッションは、インターフェイスやインターフェイスアドレスにバインドされません。LDPは、ルーター単位(インターフェイス単位ではなく)のラベルのみをアドバタイズします。2つのルーター間に複数のパラレルリンクが存在する場合、1つのLDPセッションのみが確立され、単一のインターフェイスにはバインドされません。

ルーターが同じネイバーに複数の隣接関係がある場合、 next-hop 演算子と interface 演算子は使用しないでください。

フィルターされたラベルは、データベースでマークされています。

user@host> show ldp database Input label database, 10.10.255.1:0-10.10.255.3:0 Label Prefix 100007 10.10.255.2/32 3 10.10.255.3/32 Output label database, 10.10.255.1:0-10.10.255.3:0 Label Prefix 3 10.10.255.1/32 100001 10.10.255.6/32 (Filtered)

LDPのポリシーを設定する方法についての詳細は 、ルーティングポリシー、ファイアウォールフィルター、トラフィックポリサーユーザーガイドを参照してください。

例:アウトバウンドLDPラベルバインディングのフィルタリング

すべてのネイバーへの 10.10.255.6/32 のルートの送信をブロックします。

[edit protocols]

ldp {

export block-one;

}

policy-options {

policy-statement block-one {

term first {

from {

route-filter 10.10.255.6/32 exact;

}

then reject;

}

then accept;

}

}

131.108/16 以上だけを ID 10.10.255.2 に送信し、すべてのプレフィックスを他のすべてのルータールーター送信します。

[edit protocols]

ldp {

export limit-lsps;

}

policy-options {

policy-statement limit-lsps {

term allow-one {

from {

route-filter 131.108.0.0/16 orlonger;

}

to {

neighbor 10.10.255.2;

}

then accept;

}

term block-the-rest {

to {

neighbor 10.10.255.2;

}

then reject;

}

then accept;

}

}

LDPで使用するトランスポートアドレスの指定

ルーターは、まずLDPセッションを確立する前に、互いにTCPセッションを確立する必要があります。TCPセッションでは、ルーターがLDPセッションに必要なラベルアドバタイズを交換できます。TCPセッションを確立するには、各ルーターがもう一方のルーターのトランスポートアドレスを学習する必要があります。トランスポートアドレスは、LDPセッションが実行されるTCPセッションを特定するのに使用されるIPアドレスです。

LDPトランスポートアドレスを設定するには、transport-addressステートメントを含めます。

transport-address (router-id | interface);

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

router-idオプションを指定した場合、ルーター識別子のアドレスがトランスポートアドレスとして使用されます(特に設定されていない限り、ルーター識別子は通常、ループバックアドレスと同じです)。interfaceオプションを指定した場合、インターフェイスアドレスは、そのインターフェイス上で到達できるネイバーへのLDPセッションのトランスポートアドレスとして使用されます。デフォルトでは、ルーター識別子がトランスポートアドレスとして使用されることに注意してください。

正しく動作するためには、LDPトランスポートアドレスに到達できる必要があります。ルーターIDは識別子であり、ルーティング可能なIPアドレスではありません。このため、ループバックアドレスと一致するようにルーターIDを設定し、ループバックアドレスをIGPでアドバタイズすることを推奨します。

LDP仕様では、同じネイバーへのすべてのインターフェイスで同じトランスポートアドレスをアドバタイズする必要があるため、同じLDPネイバーに複数のパラレルリンクがある場合、 interface オプションを指定することができません。LDPが同じネイバーへの複数のパラレルリンクを検出した場合、インターフェイス上のネイバーを切断するか、 router-id オプションを指定することにより条件がクリアされるまで、そのネイバーへのインターフェイスを1つずつ無効にします。

ターゲット LDP セッションに使用されるトランスポートアドレスを制御する

2 つのデバイス間に TCP セッションを確立するには、各デバイスがもう一方のデバイスのトランスポートアドレスを学習する必要があります。トランスポートアドレスは、LDPセッションが動作するTCPセッションを特定するのに使用されるIPアドレスです。以前は、このトランスポートアドレスはルーター ID またはインターフェイスアドレスに限定されていました。LDP トランスポートアドレス機能を使用すると、レイヤー 2 回線、MPLS、VPLS 隣接関係のターゲット LDP ネイバーのトランスポートアドレスとして IP アドレスを明示的に設定できます。これにより、トランスポートアドレス設定を使用してターゲット LDP セッションを制御できます。

- ターゲット LDP セッションに使用されるトランスポートアドレスを制御するメリット

- ターゲット LDP トランスポートアドレスの概要

- トランスポートアドレスの優先度

- トランスポートアドレス設定のトラブルシューティング

ターゲット LDP セッションに使用されるトランスポートアドレスを制御するメリット

ターゲット LDP セッションを確立するためにトランスポートアドレスを設定することには、次のような利点があります。

Flexible interface configurations—ターゲットLDPネイバー間のLDPセッションの作成を中断することなく、1つのループバックインターフェイスに複数のIPアドレスを設定できる柔軟性を提供します。

Ease of operation—インターフェイスレベルで設定されたトランスポートアドレスにより、LDPのIGPバックボーンで複数のプロトコルを使用できます。これにより、スムーズで簡単な操作が可能になります。

ターゲット LDP トランスポートアドレスの概要

Junos OSリリース19.1R1以前は、LDPはすべてのLDPインターフェイスのトランスポートアドレスとしてのルーターIDまたはインターフェイスアドレスのみをサポートしていました。そのインターフェイスで形成された隣接関係は、インターフェイスまたはルーター ID に割り当てられた IP アドレスの 1 つを使用しました。ターゲットの隣接関係がある場合、インターフェイスはループバックインターフェイスです。デバイスに複数のループバックアドレスが設定されていた場合、インターフェイスのトランスポートアドレスを派生させることができず、その結果、LDPセッションを確立できません。

Junos OS リリース 19.1R1 以降、ターゲット LDP セッションのトランスポートアドレスに使用されるデフォルト IP アドレスに加えて、 session、 session-group、 interface 設定ステートメントの下で他の IP アドレスをトランスポートアドレスとして設定できるようになりました。トランスポートアドレス設定は、レイヤー2回線、MPLS、VPLS隣接関係を含む設定されたネイバーにのみ適用されます。この設定は、検出された隣接関係(ターゲットかどうかは関係ない)には適用されません。

トランスポートアドレスの優先度

セッション、セッショングループ、およびインターフェイスレベルで、ターゲット LDP セッションのトランスポートアドレスを設定できます。

トランスポートアドレスが設定された後、LDP のトランスポートアドレス設定に基づいてターゲット LDP セッションが確立されます。

ターゲットネイバー(レイヤー 2 回線、MPLS、VPLS、LDP 設定で設定)のトランスポートアドレスの優先順位は次のとおりです。

[edit protocols ldp session]階層の下。[edit protocols ldp session-group]階層の下。[edit protocols ldp interfcae lo0]階層の下。[edit protocols ldp]階層の下。デフォルトのアドレス。

検出されたネイバーのトランスポートアドレスの優先度は、次のような順序になっています。

[edit protocols ldp interfcae]階層の下。[edit protocols ldp]階層の下。デフォルトのアドレス。

LDPがhelloパケットを受け入れるように設定されている自動ターゲットネイバーのトランスポートアドレスの優先順位は、以下のとおりです。

[edit protocols ldp interfcae lo0]階層の下。[edit protocols ldp]階層の下。デフォルトのアドレス。

トランスポートアドレス設定のトラブルシューティング

次の表示コマンド出力を使用して、ターゲット LDP セッションのトラブルシューティングを行うことができます。

show ldp sessionshow ldp neighborshow ldp neighborコマンドの出力のdetailレベルには、helloメッセージでターゲットネイバーに送信されたトランスポートアドレスが表示されます。このアドレスがネイバーから到達できない場合、LDP セッションは立ち上がりません。show configuration protocols ldp

また、LDP トレースオプションを有効にして、さらなるトラブルシューティングを行うこともできます。

無効なトランスポートアドレス(到達不可能)の使用から、有効なトランスポートアドレスの使用に設定が変更された場合、次の形跡が観察されます:

May 29 10:47:11.569722 Incoming connect from 10.55.1.4 May 29 10:47:11.570064 Connection 10.55.1.4 state Closed -> Open May 29 10:47:11.570727 Session 10.55.1.4 state Nonexistent -> Initialized May 29 10:47:11.570768 Session 10.55.1.4 state Initialized -> OpenRec May 29 10:47:11.570799 LDP: Session param Max PDU length 4096 from 10.55.1.4, negotiated 4096 May 29 10:47:11.570823 Session 10.55.1.4 GR state Nonexistent -> Operational May 29 10:47:11.669295 Session 10.55.1.4 state OpenRec -> Operational May 29 10:47:11.669387 RPD_LDP_SESSIONUP: LDP session 10.55.1.4 is up

有効なトランスポートアドレスの使用から、無効なトランスポートアドレス(到達不可能)使用に設定が変更された場合、次の形跡が観察されます。

May 29 10:42:36.317942 Session 10.55.1.4 GR state Operational -> Nonexistent May 29 10:42:36.318171 Session 10.55.1.4 state Operational -> Closing May 29 10:42:36.318208 LDP session 10.55.1.4 is down, reason: received notification from peer May 29 10:42:36.318236 RPD_LDP_SESSIONDOWN: LDP session 10.55.1.4 is down, reason: received notification from peer May 29 10:42:36.320081 Connection 10.55.1.4 state Open -> Closed May 29 10:42:36.322411 Session 10.55.1.4 state Closing -> Nonexistent

設定がうまくいかない場合は、次のトラブルシューティングタスクを実行してください。

address familyを確認してください。sessionステートメントの下で設定されたトランスポートアドレスは、ネイバーまたはセッションと同じアドレスファミリーに属している必要があります。neighborまたはsessionステートメントの下のトランスポートアドレスとして設定されたアドレスは、ターゲットのhelloメッセージが起動するルーターに対してローカルである必要があります。アドレスが設定されているかどうかを確認できます。どのインターフェイスの下でもアドレスが設定されていない場合、設定は拒否されます。

ルーティングテーブルからLDPにアドバタイズされるプレフィックスの設定

LDP にアドバタイズされる一連のプレフィックスを制御し、ルーターをそれらのプレフィックスのegressルーターにすることができます。デフォルトでは、ループバックアドレスのみがLDPにアドバタイズされます。LDP にアドバタイズするルーティングテーブルのプレフィックスのセットを設定するには、 egress-policy ステートメントを含めます。

egress-policy policy-name;

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

ループバックアドレスを含まない LDP 用のエグレスポリシーを設定した場合、LDP でアドバタイズされなくなります。ループバックアドレスのアドバタイズを継続するには、LDP のエグレスポリシーの一部として明示的に設定する必要があります。

指定されたポリシー( [edit policy-options] または [edit logical-systems logical-system-name policy-options] 階層レベルで設定)は、ルーティングテーブル内のすべてのルートに適用されます。ポリシーに一致するルートは、LDP にアドバタイズされます。 export ステートメントを使用して、これらのプレフィックスがアドバタイズされるネイバーのセットを制御できます。演算子 のみ が考慮されます。有効な 送信元 運用担当者を使用することができます。詳細については、「 ルーティングデバイス用 Junos OS ルーティングプロトコルライブラリ」を参照してください。

ACXシリーズルーターは[edit logical-systems]階層レベルをサポートしていません。

例:LDP にアドバタイズされるプレフィックスの設定

すべての接続されたルートを LDP にアドバタイズします。

[edit protocols]

ldp {

egress-policy connected-only;

}

policy-options {

policy-statement connected-only {

from {

protocol direct;

}

then accept;

}

}

FEC Deaggregationの設定

LDP のegressルーターが複数のプレフィックスをアドバタイズする場合、プレフィックスは1つのラベルにバインドされ、1つのFEC(forwarding equivalence class)に集約されます。デフォルトでは、LDP はアドバタイズがネットワークを通過する際にこのアグレゲーショ ンを維持します。

通常、LSPは複数のネクストホップに分割されず、プレフィックスが単一のLSPに束ねられるため、等コストパス間の負荷分散は発生しません。ただし、ロードバランシングポリシーを設定し、FECを縮退させれば、等コストパス間でロードバランシングを行うことができます。

FEC をデアグリゲーションすると、各プレフィックスが別々のラベルにバインドされ、別々の LSP になります。

デアグリゲーション FEC を設定するには、 deaggregate ステートメントを含めます。

deaggregate;

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

すべての LDP セッションについて、グローバルにのみデアグリゲーション FEC を設定できます。

FECを縮退することで、結果として得られる複数のLSPを複数のイコールコストパスに分散させ、イグレスセグメント上の複数のネクストホップにLSPを分散させますが、LSPごとにネクストホップを1つだけインストールすることができます。

FECを集計するには、 no-deaggregate ステートメントを含めます。

no-deaggregate;

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

すべての LDP セッションについて、グローバルにのみ集約 FEC を設定できます。

LDP FEC のポリシーの設定

LDP FEC のトラフィックを追跡して規制するように Junos OS を設定できます。LDP FECポリサーは、以下のいずれかの方法で実行できます。

LDP FEC のイングレストラフィックを追跡または規制する。

LDP FEC のトランジットトラフィックを追跡または規制する。

特定の転送クラスから発信された LDP FEC トラフィックを追跡または規制します。

特定の仮想ルーティングおよび転送(VRF)サイトから発信された LDP FEC トラフィックを追跡または規制します。

特定のLDP FECに対してバインドされた偽トラフィックを廃棄する。

LDP FEC のトラフィックを規制するには、まずフィルターを設定する必要があります。具体的には、 interface ステートメントまたは interface-set ステートメントのいずれかを [edit firewall family protocol-family filter filter-name term term-name from] 階層レベルで設定する必要があります。 interface ステートメントでは、フィルターを単一のインターフェイスに一致させることができます。 interface-set ステートメントでは、フィルターを複数のインターフェイスに一致させることができます。

LDP FEC の interface ステートメント、 interface-set ステートメント、およびポリサーの設定方法については、 ルーティング ポリシー、ファイアウォール フィルター、およびトラフィック ポリサー ユーザー ガイドを参照してください。

フィルターを設定したら、LDP の policing ステートメント設定に含める必要があります。LDP FEC のポリシーを設定するには、 policing ステートメントを含めます。

policing { fec fec-address { ingress-traffic filter-name; transit-traffic filter-name; } }

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

policingステートメントには、以下のオプションが含まれます。

fec—規制するLDP FECのFECアドレスを指定します。ingress-filter—イングレストラフィックフィルターの名前を指定します。transit-traffic—トランジットトラフィックフィルターの名前を指定します。

LDP IPv4 FECフィルタリングの設定

デフォルトでは、ターゲットLDPセッションが確立されると、Junos OSは常にIPv4転送等価クラス(FEC)とレイヤー2回線FECの両方をターゲットLDPセッション上で交換します。間接的に接続されたネイバーへのLDPセッションの場合、セッションがレイヤー2回線またはVPLSをサポートするように特別に設定されている場合にのみ、レイヤー2回線FECをネイバーにエクスポートすることができます。

すべての非BGPプレフィックスがLDPにアドバタイズされる混合ベンダーネットワークでは、LDPデータベースが大きくなる可能性があります。このタイプの環境では、レイヤー 2 回線または LDP VPLS 設定が原因で形成された LDP セッションを介した IPv4 FEC のアドバタイズを防止することが有効な場合があります。同様に、このような環境で受信したIPv4 FECをフィルタリングすることも有用です。

LDPセッションに関連するすべてのLDPネイバーがレイヤー2のみである場合、 l2-smart-policy ステートメントを設定することで、レイヤー2回線FECのみをアドバタイズするようにJunos OSを設定できます。また、この機能は、このセッションで受信したIPv4 FECを自動的にフィルタリングします。 l2-smart-policy に対して有効化される明示的なエクスポートまたはインポートポリシーを設定すると、対応する方向でこの機能が無効になります。

検出された隣接関係が原因でLDPセッションのネイバーの1つが形成された場合、または1つ以上のRSVP LSPのLDPトンネリング設定が原因で隣接関係が形成された場合、IPv4 FECはデフォルトの動作を使用してアドバタイズおよび受信されます。

LDPがレイヤー2ネイバーとのLDPセッションでのみIPv4 FECをエクスポートしないようにし、そのようなセッションで受信したIPv4 FECを除外するには、 l2-smart-policy ステートメントを含めます。

l2-smart-policy;

このステートメントを設定できる階層レベルの一覧については、このステートメントの概要を参照してください。

LDP LSPに対してBFDを設定する

LDP LSPに対して、Bidirectional Forwarding Detection(BFD)を設定できます。BFDプロトコルは、ネットワーク内の障害を検出するための単純なhelloメカニズムです。Helloパケットは、指定された、定期的な間隔で送信されます。指定した時間経過後にルーターが応答を受信しなくなった場合に、ネイバー障害が検出されます。BFDは、さまざまなネットワーク環境とトポロジーで動作します。BFDの障害検出タイマーは、静的ルートの障害検出メカニズムよりも制限時間が短く、より高速に検出できます。

パスのBFDセッションが失敗するたびにエラーがログに記録されます。以下は、LDP LSPに対するBFDのログメッセージの表示方法を示しています。

RPD_LDP_BFD_UP: LDP BFD session for FEC 10.255.16.14/32 is up RPD_LDP_BFD_DOWN: LDP BFD session for FEC 10.255.16.14/32 is down

また、RSVP信号付きLSPに対してBFDを設定するに記載されているように、RSVP LSPに対してBFDを設定することもできます。

BFDの障害検出タイマーは適応型であり、より厳格に、またはよりゆるめに調整することができます。例えば、隣接関係に障害が発生した場合にタイマーをより高い値に適応したり、ネイバーが設定された値よりも高い値のタイマーをネゴシエートしたりすることができます。BFDセッションのフラップが15秒間に3回以上発生すると、タイマーはより高い値に適応します。バックオフアルゴリズムは、ローカルBFDインスタンスがセッションフラップの原因である場合に、受信(Rx)の間隔を2つ増加させます。リモートBFDインスタンスがセッションフラップの原因である場合、送信(Tx)間隔は2つ増加します。 clear bfd adaptation コマンドを使用すると、BFD間隔タイマーを設定した値に戻すことができます。 clear bfd adaptation コマンドはヒットレスであり、コマンドがルーティングデバイスのトラフィックフローに影響を与えないことを意味します。

LDP LSPに対してBFDを有効にするには、 oam および bfd-liveness-detection ステートメントを含めます。

oam { bfd-liveness-detection { detection-time threshold milliseconds; ecmp; failure-action { remove-nexthop; remove-route; } holddown-interval seconds; ingress-policy ingress-policy-name; minimum-interval milliseconds; minimum-receive-interval milliseconds; minimum-transmit-interval milliseconds; multiplier detection-time-multiplier; no-adaptation; transmit-interval { minimum-interval milliseconds; threshold milliseconds; } version (0 | 1 | automatic); } fec fec-address { bfd-liveness-detection { detection-time threshold milliseconds; ecmp; failure-action { remove-nexthop; remove-route; } holddown-interval milliseconds; ingress-policy ingress-policy-name; minimum-interval milliseconds; minimum-receive-interval milliseconds; minimum-transmit-interval milliseconds; multiplier detection-time-multiplier; no-adaptation; transmit-interval { minimum-interval milliseconds; threshold milliseconds; } version (0 | 1 | automatic); } no-bfd-liveness-detection; periodic-traceroute { disable; exp exp-value; fanout fanout-value; frequency minutes; paths number-of-paths; retries retry-attempts; source address; ttl ttl-value; wait seconds; } } lsp-ping-interval seconds; periodic-traceroute { disable; exp exp-value; fanout fanout-value; frequency minutes; paths number-of-paths; retries retry-attempts; source address; ttl ttl-value; wait seconds; } }

特定の転送等価クラス(FEC)に関連するLDP LSPに対してBFDを有効にするには、[edit protocols ldp]階層レベルでfecオプションを使用してFECアドレスを設定します。または、Operation Administration and Management(OAM)イングレスポリシーを設定して、FECアドレスの範囲でBFDを有効にすることもできます。詳細については、LDPのOAMイングレスポリシーの設定を参照してください。

BFD LDP LSPは、同等のFECアドレスが明示的に設定されているか、OAMイングレスポリシーを使用してFECでOAMが有効になっていなければ、有効にすることはできません。FECアドレスに対してBFDが有効になっていない場合、BFDセッションは立ち上がりません。

以下の階層レベルで oam ステートメントを設定することができます。

[edit protocols ldp][edit logical-systems logical-system-name protocols ldp]

ACXシリーズルーターは[edit logical-systems]階層レベルをサポートしていません。

oamステートメントには、以下のオプションが含まれます。

fec—FECアドレスを指定します。BFDセッションを立ち上げるためには、FECアドレスを指定するかOAMイングレスポリシーを設定する必要があります。lsp-ping-interval—LSP ping 間隔の期間を秒単位で指定します。LDPシグナル化されたLSPでpingを発行するには、ping mpls ldpコマンドを使用します。詳細については、 CLIエクスプローラを参照してください。

bfd-liveness-detectionステートメントには、以下のオプションが含まれます。

ecmp—指定されたFECに設定されたすべてのECMPパスに対して、LDPがBFDセッションを確立するようにします。ecmpオプションを設定する場合、指定したFECに対してperiodic-tracerouteステートメントも設定する必要があります。設定しなかった場合、コミット操作は失敗します。periodic-tracerouteステートメントをグローバル階層レベル([edit protocols ldp oam])で設定しながら、特定のFEC([edit protocols ldp oam fec address bfd-liveness-detection])に対してのみecmpオプションを設定することができます。ホールドダウン間隔—ルートまたはネクストホップを追加する前に、BFDセッションが稼働した状態を維持しておく長さを指定します。0 秒を指定すると、BFD セッションが復旧するとすぐに、ルートまたはネクスト ホップが追加されます。

minimum-interval—最小の送受信間隔を指定します。minimum-intervalオプションを設定する場合、minimum-receive-intervalオプションやminimum-transmit-intervalオプションを設定する必要はありません。minimum-receive-interval—最小の受信間隔を指定します。範囲は1〜255,000ミリ秒です。minimum-transmit-interval—最小の送信間隔を指定します。範囲は1〜255,000ミリ秒です。multiplier—検出時間の倍率を指定します。範囲は1から255です。バージョン—BFDバージョンを指定します。オプションは、BFDバージョン0またはBFDバージョン1です。デフォルトでは、Junos OSソフトウェアが自動的にBFDのバージョンを判断しようと試みます。

LDP LSP 向け ECMP-Aware BFD の設定

FEC に BFD を設定すると、ルーターのアクティブ ローカル ネクストホップ 1 つのみに対して BFD セッションが確立されます。ただし、複数の BFD セッションを設定することができ、特定の ECMP(イコールコスト マルチパス)パスに関連する FEC ごとに 1 つずつ設定できます。これが正常に機能するためには、LDP LSP の定期的なトレースルートも設定する必要があります。( LDP LSP トレースルートの設定を参照してください)。LDP LSP トレースルートは、ECMP パスを検出するために使用されます。検出された各 ECMP パスに対して BFD セッションが開始されます。ECMP パスの 1 つに対する BFD セッションが失敗するたびに、エラーがログに記録されます。

LDP LSP トレースルートを定期的に実行し、ECMP パスの整合性を確認します。問題が発見された場合、以下のようなことが発生する可能性があります。

ある FEC の最新の LDP LSP トレースルートが前回のトレースルートと異なる場合、その FEC に関連する BFD セッション(前回の実行から変更されたアドレス範囲の BFD セッション)はダウンし、変更された範囲の宛先アドレスに対して新しい BFD セッションが開始されます。

LDP LSP トレースルートがエラー(タイムアウトなど)を返す場合、その FEC に関連するすべての BFD セッションは破棄されます。

指定されたFECに設定されたすべてのECMPパスに対してBFDセッションを確立するようにLDPを設定するには、 ecmp ステートメントを含めます。

ecmp;

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

ecmpステートメントとともに、グローバルLDP OAM設定([edit protocols ldp oam]または[edit logical-systems logical-system-name protocols ldp oam]階層レベル)または指定されたFECの設定([edit protocols ldp oam fec address]または[edit logical-systems logical-system-name protocols ldp oam fec address]階層レベル)にperiodic-tracerouteステートメントを含める必要があります。それ以外の場合、コミット操作は失敗します。

ACXシリーズルーターは[edit logical-systems]階層レベルをサポートしていません。

LDP LSP での BFD セッションの障害アクションの設定

LDP LSP で BFD セッション障害イベントが発生した場合に、ルートとネクストホップのプロパティを設定できます。障害イベントは、ダウンした既存の BFD セッションまたは起動しない BFD セッションです。LDP は、関連する BFD セッションが復帰すると、ルートまたはネクスト ホップを追加します。

LDP LSP で BFD セッション障害が発生した場合の failure-action ステートメントの障害アクション オプションの 1 つを設定できます。

remove-nexthop—BFDセッション障害イベントが検出された場合、イングレスノードでのLSPルートのネクストホップに対応するルートを削除します。remove-route—BFDセッション障害イベントが検出された場合、適切なルーティングテーブルからLSPに対応するルートを削除します。LSP が ECMP で設定されており、いずれかのパスに対応する BFD セッションがダウンした場合、ルートは削除されます。

LDP LSP で BFD セッション障害が発生した場合の障害アクションを設定するには、failure-action ステートメントに remove-nexthop オプションまたは remove-route オプションを含めます。

failure-action { remove-nexthop; remove-route; }

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

BFD セッションのホールドダウン間隔を設定する

ルートやネクストホップを追加するまでのBFDセッションの稼働時間を指定するには、[edit protocols ldp oam bfd-livenesss-detection]階層レベルまたは[edit protocols ldp oam fec address bfd-livenesss-detection]階層レベルのいずれかでholddown-intervalステートメントを設定します。0 秒を指定すると、BFD セッションが復旧するとすぐに、ルートまたはネクスト ホップが追加されます。

holddown-interval seconds;

このステートメントを含めることができる階層レベルの一覧については、このステートメントの「ステートメント概要」セクションを参照してください。

LDPリンク保護の設定

ユニキャストおよびマルチキャストLDPラベルスイッチパス(LSP)に対して、ラベル配布プロトコル(LDP)リンク保護を設定し、リンクまたはノードの障害時に耐障害性を提供できます。

始める前に:

デバイスインターフェイスを設定します。

デバイスのルーターIDと自律システム番号を設定します。

以下のプロトコルを設定します。

出欠確認

トラフィック制御機能を備えた MPLS。

トラフィック制御機能を備えた OSPF。

注:ループフリーオルタナティブ(LFA)を使用したマルチキャストLDPリンク保護の場合は、リンク保護を有効にします。

[edit protocols] user@R0# set ospf area 0 interface all link-protection

LDPリンク保護を設定するには:

例:LDPリンク保護の設定

LDPリンク保護の概要

- LDPの概要

- Junos OS LDP プロトコルの実装

- LDPへのマルチポイント拡張を理解する

- ターゲット LDP セッションでの LDP へのマルチポイント拡張の使用

- LDPリンク保護の現在の制限

- RSVP LSPをソリューションとして使用

- マルチキャストLDPリンク保護について

- LDPリンク保護を提供するためのさまざまなモード

- LDPリンク保護のためのラベル操作

- マルチキャストLDPリンク保護設定の例

- メークビフォアブレーク

- 注意事項と制限事項

LDPの概要

LDP(Label Distribution Protocol)は、トラフィックエンジニアリングを行っていないアプリケーションでラベルを配布するためのプロトコルです。LDP は、ネットワーク層の経路情報をデータリンク LSP に直接マッピングすることで、ルーターがネットワークを介した LSP(ラベルスイッチ パス)を確立することを可能にします。

これらのLSPは、直接接続されたネイバー(IPホップバイホップ転送に相当)またはネットワークの出口ノードにエンドポイントがある場合があり、すべての中間ノードを介した切り替えを可能にします。LDP で確立した LSP は、RSVP で作成したトラフィックエンジニアリング LSP も通過できます。

LDP は、作成する各 LSP に FEC(Forwarding Equivalence Class)を関連付けます。LSP に関連する FEC は、どのパケットがその LSP にマッピングされるかを指定します。各ルーターは、ネクスト ホップが FEC 用にアドバタイズするラベルを選択し、他のすべてのルーターにアドバタイズするラベルにスプライスすることで、LSP はネットワークを介して拡張されます。このプロセスは、egressルーターに収束するLSPのツリーを形成します。

Junos OS LDP プロトコルの実装

LDPのJunos OS実装は、LDPバージョン1をサポートしています。Junos OSは、内部ゲートウェイプロトコル(IGP)のルーター間でトンネリングするためのシンプルなメカニズムをサポートしており、コア内での外部ルートの必要な配布を排除しています。Junos OSでは、ネットワーク内のすべてのエグレスルーターへのMPLSトンネルネクストホップが許可され、コアで実行されているIGPのみでエグレスルーターにルートを分配できます。エッジルーターはBGPを実行しますが、外部ルートをコアに配信しません。代わりに、エッジでの再帰的なルート検索では、egressルーターに切り替えられたLSPに解決されます。トランジット LDP ルーターには外部ルートは必要ありません。

LDPへのマルチポイント拡張を理解する

LDP は、ネットワーク内にポイントツーポイント、マルチポイントツーポイント、ポイントツーマルチポイント、およびマルチポイントツーマルチポイント LSP を設定するためのメカニズムを定義します。ポイントツーマルチポイントおよびマルチポイントツーマルチポイントLSPは、総称してマルチポイントLSPと呼ばれ、トラフィックはそれぞれ単一の送信元から複数の宛先へ、および複数の送信元から複数の宛先へトラフィックが流れます。宛先ルーターまたは出口ルーターはリーフノードと呼ばれ、送信元からのトラフィックはリーフノードに到達する前に1つ以上のトランジットノードを通過します。

Junos OS は、マルチポイントツーマルチポイント LSP をサポートしていません。

マルチポイントLSPは、ネットワークのMPLSパケットレプリケーション機能を利用することで、ingressルーターでの不要なパケットレプリケーションを回避します。パケットレプリケーションは、異なるネットワークパスを必要とする2つ以上の異なる宛先にパケットが転送された場合にのみ行われます。

ターゲット LDP セッションでの LDP へのマルチポイント拡張の使用

LDPへのマルチポイント拡張の仕様では、LDPセッションの2つのエンドポイントがレイヤー2メディアで直接接続されているか、ネットワークのIGPによってネイバーと見なされていることが求められています。これは、LDPリンクセッションと呼ばれます。LDPセッションの2つのエンドポイントが直接接続されていない場合、そのセッションはターゲットLDPセッションと呼ばれます。

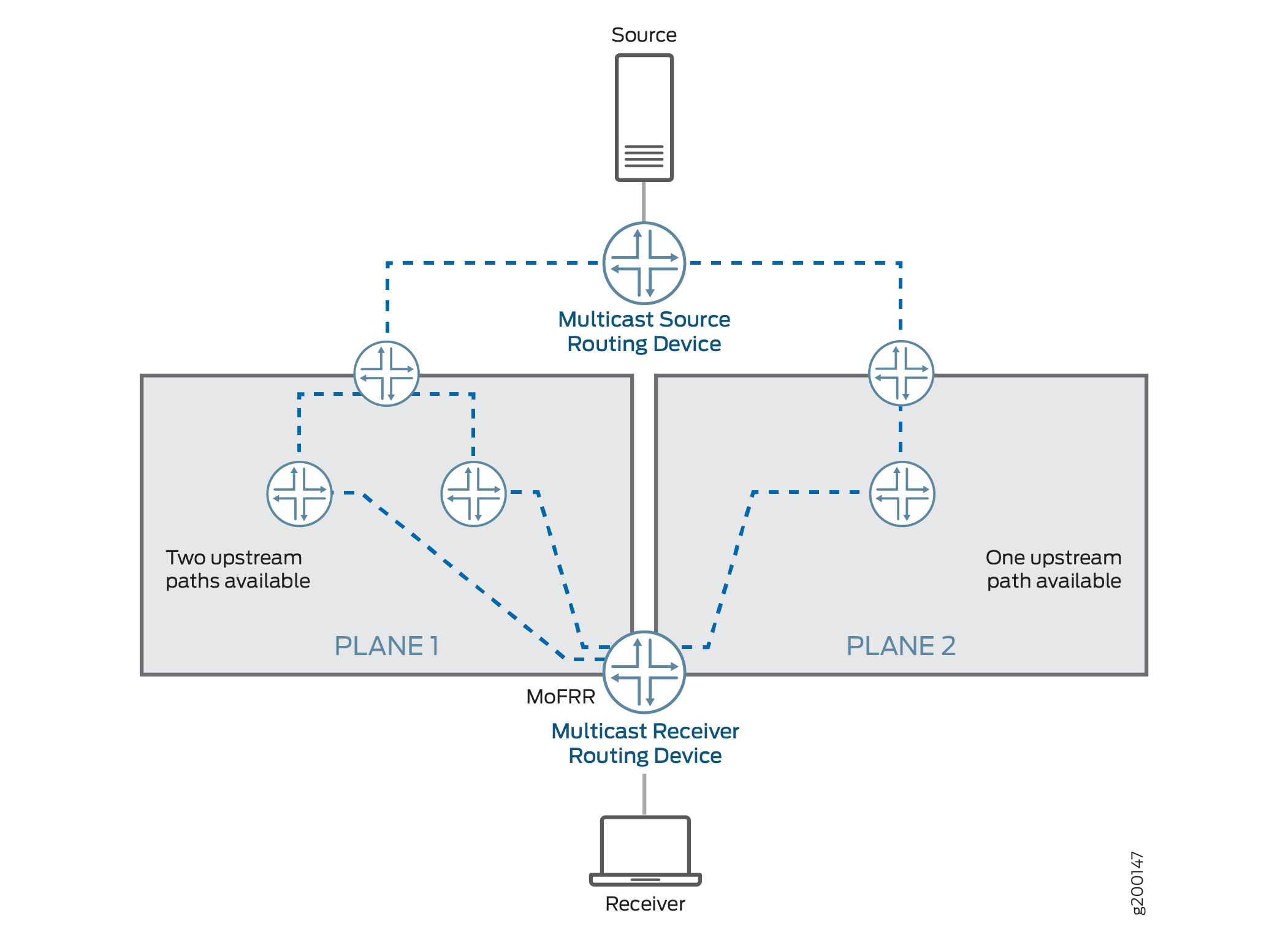

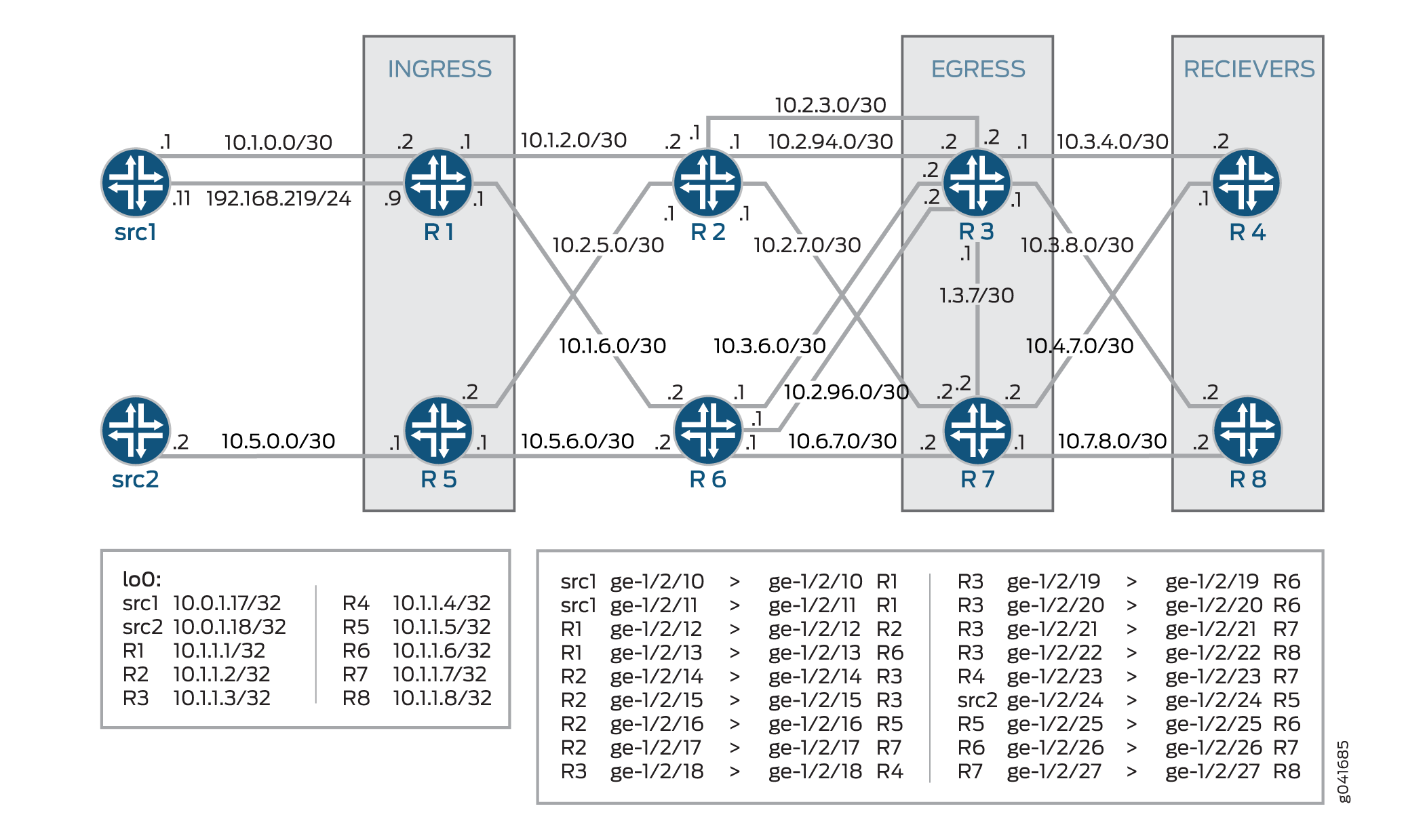

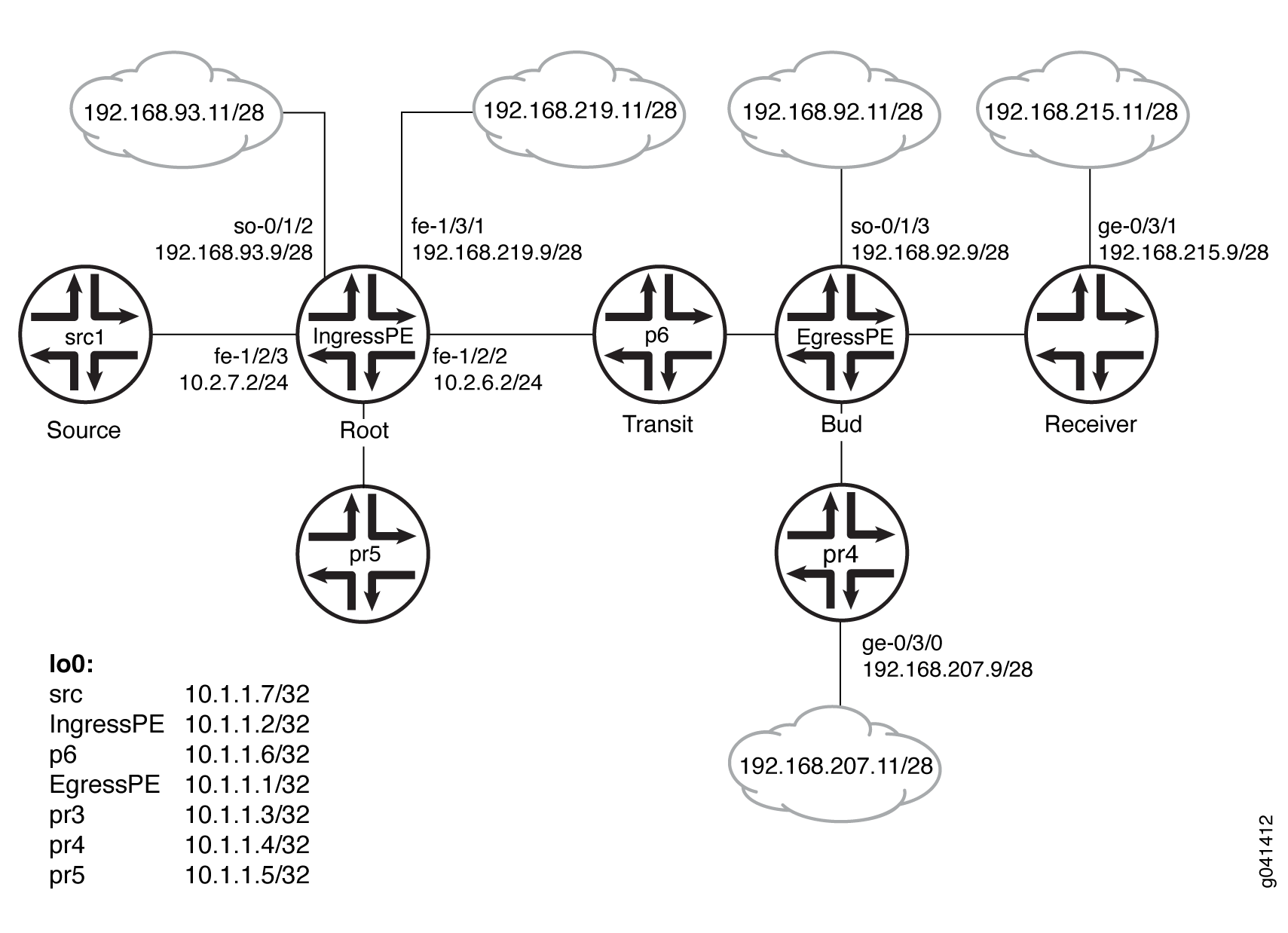

過去の Junos OS 実装では、リンク セッションに対してのみマルチキャスト LDP がサポートされています。LDPリンク保護機能の導入により、マルチキャストLDP機能がターゲットLDPセッションに拡張されます。 図2 は、サンプルのトポロジーを示しています。

に対するマルチキャストLDPサポート

に対するマルチキャストLDPサポート

ルーターR7およびR8は、それぞれアップストリーム(LSR-U)およびダウンストリーム(LSR-D)のラベルスイッチルーター(LSR)であり、マルチキャストLDPを導入します。コアルーターであるルーターR5では、RSVP-TEが有効になっています。

LSR-DがルートおよびLSP ID属性でポイントツーマルチポイントLSPを設定する場合、アップストリームのLSR-Uをルートへの最適パスのネクストホップとして決定します(現在、このネクストホップはIGPネクストホップと見なされています)。

ターゲットLDPセッションでのマルチキャストLDPサポートにより、LSR-DとLSR-Uが直接接続されたネイバーではなく、ターゲットLDPピアであるLSR-Dのルートへのパス上にあるLSR-UへのLSPネクストホップがあるかどうかを判断できます。LSR-DとLSR-U間のターゲットLDPセッションでアドバタイズされるポイントツーマルチポイントラベルは、LSR-DとLSR-Uの間にLSPがない限り使用されません。そのため、LSR-UからLSR-Dへの逆方向に対応するLSPが必要です。

データは、パケットのユニキャストレプリケーションを使用してポイントツーマルチポイントLSPで送信され、LSR-UはポイントツーマルチポイントLSPの各ダウンストリームLSRに1つのコピーを送信します。

データ転送は、以下の方法で実装されます。

ターゲットLDPセッションのポイントツーマルチポイント機能がネゴシエートされます。

アップストリームLSRを選択するアルゴリズムが変更され、IGPネクストホップが利用できない場合、つまり、LSR-DとLSR-Uの間にLDPリンクセッションがない場合、RSVP LSPがLSR-Uに到達するネクストホップとして使用されます。

ターゲットLDPセッションで受信した受信ラベルは、LDPラベルを内側ラベル、RSVPラベルを外側ラベルとして、このポイントツーマルチポイントFECルートのブランチネクストホップとしてインストールされます。

LDPリンク保護の現在の制限

LDPネットワークの導入でリンクまたはノード障害が発生した場合、ミッションクリティカルなサービスで影響を受けたトラフィックフローを復旧するために、迅速なトラフィック復旧を提供する必要があります。マルチポイントLSPの場合、ポイントツーマルチポイントツリーのリンクの1つに障害が発生すると、IGPが再収束し、ダウンストリームルーターから新しいアップストリームルーターへの最適なパスを使用してマルチポイントLSPが確立されるまで、サブツリーが切り離される可能性があります。

LDPトラフィックのローカル修復を使用した高速再ルートでは、バックアップパス(修復パス)がパケット転送エンジンに事前インストールされています。プライマリパスに障害が発生すると、トラフィックはルーティングプロトコルが収束するのを待つことなく、バックアップパスに迅速に移動します。ループフリー代替(LFA)は、コアおよびサービスプロバイダネットワークにIP高速再ルート機能を提供するために使用される方法の1つです。

LFAを使用しない場合、リンクまたはルーターに障害が発生したり、サービスに復帰したりすると、分散ルーティングアルゴリズムがネットワークの変化に基づいて新しいルートを計算します。新しいルートが計算される時間をルーティング遷移と呼びます。ルーティング遷移が完了するまで、障害に隣接するルーターが、代替パスが特定されるまで障害コンポーネントを介してデータパケットを転送し続けるため、ネットワーク接続は中断されます。

ただし、LFAはIGPメトリックのため、すべてのネットワーク展開を完全にカバーできるわけではありません。その結果、これは現在のLDPリンク保護方式の制限となります。

図3 は、トラフィックが送信元ルーター(S)からルーターR1を経由して宛先ルーター(D)に流れる、不完全なLFAカバレッジを持つサンプルネットワークを示しています。ネットワーク内の各リンクのメトリックが同じであると仮定すると、ルーターSとルーターR1の間のリンクに障害が発生すると、ルーターR4はS-R1リンクを保護するLFAではないため、トラフィックの耐障害性が失われます。したがって、プレーンLFAを使用していては、完全なカバレッジを実現できません。一般的なネットワークでは、プレーン LFA とは常にある程度の割合の LFA カバレッジ ギャップが存在します。

による不完全なカバレッジ問題

による不完全なカバレッジ問題

RSVP LSPをソリューションとして使用

LDP LSP を通過するトラフィックを保護する鍵は、リンクまたはノードに障害が発生した場合にトラフィックを再ルーティングするための明示的なトンネルを用意することです。明示的パスは、次のダウンストリーム ルーターで終了し、RPF チェックに合格する必要がある明示的パスでトラフィックを受け入れる必要があります。

RSVP LSP は、以下の方法で LFA カバレッジを拡張することで、ポイントツーポイントおよびポイントツーマルチポイントの両方の LDP LSP におけるループフリー代替(LFA)の現在の制限を克服するのに役立ちます。

手動設定されたRSVP LSP

図 3 で使用した例を考慮すると、S-R1 リンクに障害が発生し、ルーター R4 がその特定のリンクの LFA ではない場合、手動で作成した RSVP LSP がパッチとして使用され、LFA を完全にカバーします。RSVP LSP は、ルーター S のパケット転送エンジンに事前にシグナリングされ、事前にインストールされているため、ルーター S がリンクの障害を検出するとすぐに使用できます。

この場合、 図4に示すように、ルーターS、R4、R3の間でRSVP LSPが作成されます。ルーターSとルーターR3の間でターゲットLDPセッションが作成され、その結果、S-R1リンクに障害が発生すると、トラフィックはルーターR3に到達します。ルーターR3は、宛先であるルーターDに到達するまでの最短パスであるため、トラフィックをルーターR2に転送します。

動的に設定されたRSVP LSP

この方法では、RSVP LSP が自動的に作成され、システムに事前インストールされるため、リンク障害が発生した場合にすぐに使用できます。ここでは、egressは保護対象のリンクの反対側のノードであるため、LFAカバレッジが向上します。

Benefits of Enabling Dynamic RSVP LSPs

設定のしやすさ。

保護対象のリンクの遠端への代替パスがある限り、リンク障害に対して100%カバーします。

RSVP バイパス LSP の設定と破棄は自動的に行われます。

RSVP LSPはリンク保護にのみ使用され、保護対象のリンクが稼働している間はトラフィックの転送には使用されません。

システムに必要なRSVP LSPの総数を減らします。

図 3 で使用した例を考慮すると、S-R1 リンクの潜在的な障害からトラフィックを保護するために、ルーター R4 はその特定のリンクの LFA ではないため、図 5 に示すように、保護されたリンクの向こう側のノードであるルーター R1 に RSVP バイパス LSP が自動的に作成されます。ルーターR1から、トラフィックは元の宛先であるルーターDに転送されます。

RSVP LSP は、ルーター S のパケット転送エンジンに事前にシグナリングされ、事前にインストールされているため、ルーター S がリンクの障害を検出するとすぐに使用できます。

別の動作モードは、LFA をまったく使用せず、すべてのリンク障害をカバーするために常に RSVP LSP を作成することです。

動的RSVP LSPを有効にするには、適切なインターフェイスでRSVPプロトコルを有効にすることに加えて、[edit protocols ldp interface interface-name link-protection]階層レベルにdynamic-rsvp-lspステートメントを含めます。

マルチキャストLDPリンク保護について

ポイントツーマルチポイントLDPラベルスイッチパス(LSP)は、ポイントツーマルチポイントであるLDP信号LSPであり、マルチキャストLDPと呼ばれます。

マルチキャストLDP LSPを使用して、単一のルートノードまたはイングレスノードから、1つ以上のトランジットノードを通過する多数のリーフノードまたはエグレスノードにトラフィックを送信できます。マルチキャストLDPリンク保護により、リンク障害が発生した場合に、ポイントツーマルチポイントLDP LSPを介して転送されたトラフィックの高速再ルートが可能になります。ポイントツーマルチポイント ツリーのリンクの 1 つに障害が発生すると、IGP が再収束し、ダウンストリーム ルーターから新しいアップストリーム ルーターへの最適なパスを使用してマルチポイント LSP が確立されるまで、サブツリーが切り離される可能性があります。

マルチキャストLDP LSPを通過するトラフィックを保護するために、リンク障害が発生した場合にトラフィックを再ルーティングするように明示的なトンネルを設定することができます。明示的パスは、次のダウンストリームルーターで終了する必要があります。トラフィックのリバースパスフォワーディングが成功しているはずです。

マルチキャストLDPリンク保護には、以下の特徴と機能が導入されています。

バイパストンネルとしての動的RSVP LSPの使用

RSVP LSPの明示的なルートオブジェクト(ERO)は、回避するリンクとして制約付き最短パスファースト(CSPF)を使用して計算されます。LSP は、リンク保護が必要なたびに動的にシグナリングおよび破棄されます。

事前対応

事前対応機能により、マルチキャストLDP LSPの古いLSPパスを破棄する前に、新しいLSPパスをシグナリングしようとする際のパケット損失が最小限に抑えられます。

ターゲット LDP セッション

ダウンストリームのラベルスイッチングルーター(LSR)へのターゲット隣接関係は、次の 2 つの理由で作成されます。

リンク障害後もセッションを稼働させ続けるため。

セッションから受信したポイントツーマルチポイントラベルを使用して、RSVP LSPバイパストンネル上のダウンストリームLSRにトラフィックを送信するには。

ダウンストリーム LSR がルート ノードと LSP ID を持つマルチキャスト LDP LSP を設定する場合、ルートへの最適なパスにあるそのアップストリーム LSR を使用します。

ダウンストリームLSRに複数のリンク隣接関係(パラレルリンク)がある場合、マルチキャストLDPリンク保護は必要ありません。

LDPリンク保護を提供するためのさまざまなモード

ユニキャストおよびマルチキャストLDPリンク保護で使用できる3つの動作モードを以下に示します。

Case A: LFA only

この動作モードでは、既存の有効なループフリーの代替(LFA)を使用して、マルチキャスト LDP リンク保護が提供されます。有効なLFAがない場合、マルチキャストLDP LSPに対してリンク保護は提供されません。

Case B: LFA and Dynamic RSVP LSP

この動作モードでは、既存の有効なLFAを使用してマルチキャストLDPリンク保護が提供されます。有効なLFAが存在しない場合、RSVPバイパスLSPが自動的に作成され、マルチキャストLDP LSPにリンク保護を提供します。

Case C: Dynamic RSVP LSP only

この動作モードでは、LFA はリンク保護には使用されません。マルチキャストLDPリンク保護は、自動的に作成されたRSVPバイパスLSPを使用して提供されます。

図6 は、マルチキャストLDPリンク保護のさまざまな動作モードを示すトポロジーの例です。ルーターR5は、ルーターR3およびR4の2つのリーフノードに接続するルートです。ルーターR0とルーターR1は、それぞれアップストリームとダウンストリームのLSR(ラベルスイッチルーター)です。マルチキャストLDP LSPは、ルートノードとリーフノード間を走ります。

例

例

R0-R1リンクに障害が発生した場合に、ルーターR0がマルチキャストLDP LSPを保護する必要があることを考慮して、リンク保護のさまざまなモードは次のように動作します。

Case A: LFA only

ルーターR0は、R0-R1リンクを回避してルーターR1に到達できる有効なLFAパスが存在するかどうかを確認します。メトリックに基づくと、ルーターR2はR0-R1リンクの有効なLFAパスであり、ユニキャストLDPトラフィックの転送に使用されます。複数のマルチキャストLDP LSPがR0-R1リンクを使用する場合、同じLFA(ルーターR2)がマルチキャストLDPリンク保護に使用されます。

R0-R1リンクに障害が発生すると、マルチキャストLDP LSPトラフィックはルーターR0によってLFAパスに移動され、ルーターR1(L100)に到達するユニキャストLDPラベルがマルチキャストLDPラベル(L21)の上にプッシュされます。

Case B: LFA and Dynamic RSVP LSP

ルーターR0は、R0-R1リンクを回避してルーターR1に到達できる有効なLFAパスが存在するかどうかを確認します。メトリックに基づくと、ルーターR2はR0-R1リンクの有効なLFAパスであり、ユニキャストLDPトラフィックの転送に使用されます。複数のマルチキャストLDP LSPがR0-R1リンクを使用する場合、同じLFA(ルーターR2)がマルチキャストLDPリンク保護に使用されます。R0-R1リンクに障害が発生すると、マルチキャストLDP LSPトラフィックはルーターR0によってLFAパスに移動します。

ただし、R2-R1リンクのメトリックが10ではなく50であった場合、ルーター2はR0-R1リンクに対して有効なLFAではありません。この場合、ルーターR0とR1の間を移動するマルチキャストLDPトラフィックを保護するためにRSVP LSPが自動的に作成されます。

Case C: Dynamic RSVP LSP only

RSVP LSP は、インターフェイス ge-1/1/0 を避けて、ルーター R0 からルーター R2 を経由してルーター R1 に自動的にシグナリングされます。複数のマルチキャスト LDP LSP が R0-R1 リンクを使用する場合、同じ RSVP LSP がマルチキャスト LDP リンク保護に使用されます。

R0-R1 リンクに障害が発生すると、マルチキャスト LDP LSP トラフィックはルーター R0 によって RSVP LSP に移動され、ルーター R1(L100)に到達するための RSVP ラベルがマルチキャスト LDP ラベル(L21)の上にプッシュされます。

LDPリンク保護のためのラベル操作

図 5 と同じネットワーク トポロジーを使用して、 図 7 は、ユニキャストおよびマルチキャスト LDP リンク保護のラベル操作を示しています。

例

例

ルーターR5は、ルーターR3およびR4の2つのリーフノードに接続するルートです。ルーターR0とルーターR1は、それぞれアップストリームとダウンストリームのLSR(ラベルスイッチルーター)です。マルチキャストLDP LSPは、ルートノードとリーフノード間を走ります。ユニキャスト LDP パスは、ルーター R1 からルーター R5 に接続します。

ラベル操作は、以下のLDPリンク保護モードでの実行が異なります。

ケースA:LFAのみ

ルーターR0の show route detail コマンド出力を使用して、ユニキャストLDPトラフィックとマルチキャストLDPトラフィックを導き出すことができます。

user@R0> show route detail

299840 (1 entry, 1 announced)

*LDP Preference: 9

Next hop type: Router

Address: 0x93bc22c

Next-hop reference count: 1

Next hop: 11.0.0.6 via ge-0/0/1.0 weight 0x1, selected

Label operation: Swap 299824

Session Id: 0x1

Next hop: 11.0.0.10 via ge-0/0/2.0 weight 0xf000

Label operation: Swap 299808

Session Id: 0x3

State: <Active Int>

Age: 3:16 Metric: 1

Validation State: unverified

Task: LDP

Announcement bits (1): 0-KRT

AS path: I

Prefixes bound to route: 192.168.0.4/32

299856 (1 entry, 1 announced)

*LDP Preference: 9

Next hop type: Flood

Address: 0x9340e04

Next-hop reference count: 3

Next hop type: Router, Next hop index: 262143

Address: 0x93bc3dc

Next-hop reference count: 2

Next hop: 11.0.0.6 via ge-0/0/1.0 weight 0x1

Label operation: Swap 299888

Next hop: 11.0.0.10 via ge-0/0/2.0 weight 0xf000

Label operation: Swap 299888, Push 299776(top)

Label TTL action: prop-ttl, prop-ttl(top)

State: <Active Int AckRequest>

Age: 3:16 Metric: 1

Validation State: unverified

Task: LDP

Announcement bits (1): 0-KRT

AS path: I

FECs bound to route: P2MP root-addr 192.168.0.5, lsp-id 99

ラベル299840は、ルーターR0に到着するトラフィックで、ルーターR1へのユニキャストLDPトラフィックに対応します。ラベル299856は、ルートノードR5からリーフエグレスノードR3およびR4へのマルチキャストLDPトラフィックに対応する、ルーター0に到着するトラフィックです。

ユニキャストおよびマルチキャストLDP LSPのメインパスは、インターフェイスge-0/0/1(ルーターR1へのリンク)を経由し、LFAパスはインターフェイスge-0/0/2(ルーターR2へのリンク)を経由します。ge-0/0/1インターフェイスがダウンしない限り、LFAパスは使用されません。

ケースAのラベル操作では、LFAのみの動作モードがユニキャストとマルチキャストLDPトラフィックで異なります。

ユニキャストラベル操作

ユニキャストLDPトラフィックの場合、FECおよび関連するラベルは、LDPが有効になっているネットワーク内のすべてのリンクにアドバタイズされます。つまり、ルーターR4にユニキャストLDPトラフィックに対するLFAアクションを提供するために、ルーターR0は、受信ラベルをルーターR1がFEC R4に対してアドバタイズしたラベル299824に交換する代わりに、ルーターR0は、受信ラベルをルーターR2がFEC R4に対してアドバタイズしたラベル299808と交換するだけです。これは、ユニキャストLDPトラフィックに対する標準的なJunos OS LFA操作です。

図8 は、R0-R1リンクに障害が発生した場合のユニキャストトラフィックのラベル操作を示しています。灰色のボックスは、通常条件下でのユニキャストLDPトラフィックのラベル操作を示し、点線のボックスは、R0-R1リンクに障害が発生した場合のユニキャストLDPトラフィックのラベル操作を示しています。

図8:ユニキャストLDPラベル動作

マルチキャストラベル操作

マルチポイントLSPラベルは、リーフノードからイングレスノードへの最適なパスに沿ってのみアドバタイズされるため、マルチキャストLDPトラフィックのラベル操作は、ユニキャストLDPラベル操作とは異なります。その結果、ルーターR2はマルチキャストLDPを認識しません。これを克服するために、マルチキャスト LDP LSP トラフィックは、ルーター R1 で終端するルーター R2 を経由するユニキャスト LDP LSP パス内に単純にトンネリングされます。

これを実現するために、ルーターR0はまず、受信マルチキャストLDP LSPラベル299856をルーターR1によってアドバタイズされたラベル299888にスワップします。次に、ラベル 299776 が最上位にプッシュされますが、これはルーター R2 が FEC R1 に対してアドバタイズした LDP ラベルです。パケットがルーターR2に到着すると、最後から2番目のホップポッピングによりトップラベルがポップアウトされます。これは、パケットが、ルーター R1 が最初にルーター R0 にアドバタイズした マルチキャスト LDP ラベル299888を使用してルーター R1 に到着することを意味します。

図9 は、R0-R1リンクに障害が発生した場合のマルチキャストLDPトラフィックのラベル操作を示しています。青いボックスは、通常条件下のマルチキャストLDPトラフィックのラベル操作を示し、点線のボックスは、R0-R1リンクに障害が発生した場合のマルチキャストLDPトラフィックのラベル操作を示しています。

図9:マルチキャストLDPラベル動作

R2-R1リンクのメトリックが1ではなく1000に設定されている場合、ルーターR2はルーターR0に対して有効なLFAではありません。この場合、ルーターR2がIGPが収束する前にルーターR1、R3、またはR4宛のパケットを受信すると、パケットはルーターR0に送り返され、ループパケットになります。

ルーターR0には有効なLFAがないため、パケット転送エンジンにバックアップパスはインストールされません。R0-R1リンクに障害が発生すると、IGPとLDPが収束し、影響を受けるルーターに新しいエントリーがインストールされるまで、トラフィックフローが中断されます。

show route detailコマンドは、リンク保護に使用できるLFAがない場合の状態を表示します。

user@host> show route detail

299840 (1 entry, 1 announced)

*LDP Preference: 9

Next hop type: Router, Next hop index: 578

Address: 0x9340d20

Next-hop reference count: 2

Next hop: 11.0.0.6 via ge-0/0/1.0, selected

Label operation: Swap 299824

Session Id: 0x1

State: <Active Int>

Age: 5:38 Metric: 1

Validation State: unverified

Task: LDP

Announcement bits (1): 0-KRT

AS path: I

Prefixes bound to route: 192.168.0.4/32

299856 (1 entry, 1 announced)

*LDP Preference: 9

Next hop type: Flood

Address: 0x9340e04

Next-hop reference count: 3

Next hop type: Router, Next hop index: 579

Address: 0x93407c8

Next-hop reference count: 2

Next hop: 11.0.0.6 via ge-0/0/1.0

Label operation: Swap 299888

State: <Active Int AckRequest>

Age: 5:38 Metric: 1

Validation State: unverified

Task: LDP

Announcement bits (1): 0-KRT

AS path: I

FECs bound to route: P2MP root-addr 192.168.0.5, lsp-id 99

ケースB:LFAと動的RSVP LSP

この動作モードでは、有効なLFAネイバーが存在する場合、ラベル操作の動作はケースAのLFAのみモードと同様です。ただし、有効なLFAネイバーがない場合は、RSVPバイパストンネルが自動的に作成されます。

リンクR2-R1のメトリックが1ではなく1000に設定されている場合、ルーターR2はルーターR0のLFAではありません。R0-R1 リンク障害を保護する LFA パスがないことが判明すると、ルーター R1 をエグレス ノードとする RSVP バイパス トンネルが自動的に作成され、R0-R1 リンクを回避するパス(例:R0-R2-R1)をたどります。

R0-R1リンクに障害が発生した場合、ユニキャストLDPおよびマルチキャストLDPトラフィックはRSVPバイパストンネルを介してトンネリングされます。RSVP バイパス トンネルは通常の転送には使用されず、R0-R1 リンク障害が発生した場合に LDP トラフィックにリンク保護を提供する目的にのみ使用されます。

show route detailコマンドを使用すると、ユニキャストとマルチキャストLDPトラフィックを導き出すことができます。

user@host> show route detail

299840 (1 entry, 1 announced)

*LDP Preference: 9

Next hop type: Router

Address: 0x940c3dc

Next-hop reference count: 1

Next hop: 11.0.0.6 via ge-0/0/1.0 weight 0x1, selected

Label operation: Swap 299824

Session Id: 0x1

Next hop: 11.0.0.10 via ge-0/0/2.0 weight 0x8001

Label-switched-path ge-0/0/1.0:BypassLSP->192.168.0.1

Label operation: Swap 299824, Push 299872(top)

Label TTL action: prop-ttl, prop-ttl(top)

Session Id: 0x3

State: <Active Int NhAckRequest>

Age: 19 Metric: 1

Validation State: unverified

Task: LDP

Announcement bits (1): 0-KRT

AS path: I

Prefixes bound to route: 192.168.0.4/32

299856 (1 entry, 1 announced)

*LDP Preference: 9

Next hop type: Flood

Address: 0x9340e04

Next-hop reference count: 3

Next hop type: Router, Next hop index: 262143

Address: 0x940c154

Next-hop reference count: 2

Next hop: 11.0.0.6 via ge-0/0/1.0 weight 0x1

Label operation: Swap 299888

Next hop: 11.0.0.10 via ge-0/0/2.0 weight 0x8001

Label-switched-path ge-0/0/1.0:BypassLSP->192.168.0.1

Label operation: Swap 299888, Push 299872(top)

Label TTL action: prop-ttl, prop-ttl(top)

State: < Active Int AckRequest>

Age: 20 Metric: 1

Validation State: unverified

Task: LDP

Announcement bits (1): 0-KRT

AS path: I

FECs bound to route: P2MP root-addr 192.168.0.5, lsp-id 99

ユニキャストおよびマルチキャストLDP LSPのメインパスは、インターフェイスge-0/0/1(ルーターR1へのリンク)を経由し、LFAパスはインターフェイスge-0/0/2(ルーターR2へのリンク)を経由します。ge-0/0/1インターフェイスがダウンしない限り、LFAパスは使用されません。

ラベル299840は、ルーターR0に到着するトラフィックで、ルーターR4へのユニキャストLDPトラフィックに対応します。ラベル299856は、ルートノードR5からリーフエグレスノードR3およびR4へのマルチキャストLDPトラフィックに対応する、ルーター0に到着するトラフィックです。

show route detailコマンド出力に見られるように、保護パスのラベル操作は、ユニキャストLDPトラフィックとマルチキャストLDPトラフィックで同じです。ルーターR0で受信するLDPラベルは、ルーターR1からルーターR0にアドバタイズされたLDPラベルに交換されます。次に、バイパストンネル用に299872されたRSVPラベルがパケットにプッシュされます。バイパストンネルで最後から 2 番目のホップポッピングが使用され、ルーター R2 がそのラベルをポップします。したがって、パケットは、最初にルーターR0にアドバタイズされたLDPラベルとともに、ルーターR1に到着します。

図10 は、RSVPバイパストンネルで保護されたユニキャストLDPおよびマルチキャストLDPトラフィックのラベル操作を示しています。灰色と青色のボックスは、ユニキャスト LDP トラフィックとマルチキャスト LDP トラフィックにそれぞれ通常の条件下で使用されるラベル値を表しています。点線のボックスは、R0-R1 リンクに障害が発生した場合に使用されるラベル値を表しています。

ケースC:動的RSVP LSPのみ

この動作モードでは、LFAはまったく使用されません。リンク保護を提供するために、動的RSVPバイパスLSPが自動的に作成されます。 show route detail コマンドからの出力とラベル操作は、ケースB、LFAおよび動的RSVP LSPモードと似ています。

マルチキャストLDPリンク保護設定の例

マルチキャストLDPリンク保護を有効にするには、ルーターR0で以下の設定が必要です。

このサンプルでは、ルーター R1 に接続するルーター R0 の ge-1/0/0 インターフェイスでマルチキャスト LDP リンク保護が有効になっていますが、通常はすべてのインターフェイスをリンク保護用に設定する必要があります。

ルーターR0

protocols {

rsvp {

interface all;

interface ge-0/0/0.0 {

disable;

}

}

mpls {

interface all;

interface ge-0/0/0.0 {

disable;

}

}

ospf {

traffic-engineering;

area 0.0.0.0 {

interface lo0.0;

interface ge-0/0/1.0 {

link-protection;

}

interface ge-0/0/2.0;

interface ge-0/0/3.0;

}

}

ldp {

make-before-break {

timeout seconds;

switchover-delay seconds;

}

interface ge-1/1/0.0 {

link-protection {

disable;

dynamic-rsvp-lsp;

}

}

}

}

以下の設定ステートメントは、以下のように、マルチキャストLDP保護の異なるモードに適用されます。

link-protectionでのステートメント[edit protocols ospf interface ge-0/0/1.0]この設定は、マルチキャストLDPリンク保護のケースA(LFAのみ)およびケースB(LFAおよび動的RSVP LSP)モードにのみ適用されます。ケースCでは、IGPの下でのリンク保護の設定は必要ありません(動的RSVP LSPのみ)。

link-protectionでのステートメント[edit protocols ldp interface ge-0/0/1.0]この設定は、マルチキャストLDP保護のすべてのモードで必要です。ただし、LDP トラフィックが ユニキャスト のみ存在し、動的 RSVP バイパスが不要な場合は、

[edit protocols ospf interface ge-0/0/1.0]階層レベルのlink-protectionステートメントが LDP ユニキャスト トラフィックに対して LFA アクションを実行するため、この設定は不要です。dynamic-rsvp-lspでのステートメント[edit protocols ldp interface ge-0/0/1.0 link-protection]この設定は、LDPリンク保護のケースB(LFAおよび動的RSVP LSP)およびケースC(動的RSVP LSPのみ)モードにのみ適用されます。動的 RSVP LSP 設定は、ケース A には適用されません(LFA のみ)。

メークビフォアブレーク

Junos OSでは、事前対応機能がデフォルトで有効になっており、ポイントツーマルチポイントLSPにいくつかのメリットがあります。

ポイントツーマルチポイント LSP の場合、LSR(ラベルスイッチ ルーター)は、LSP のルートへのネクスト ホップである LSR をアップストリーム LSR として選択します。ルートに到達する最適なパスが変更されると、LSR は新しいアップストリーム LSR を選択します。この期間中、LSP が一時的に切断され、LSP が新しいアップストリーム LSR に再収束するまでパケット損失が発生する可能性があります。この場合のメークビフォアブレークの目的は、パケットロスを最小限に抑えることです。LSRからルートへの最適なパスが変更されたにもかかわらず、LSPが以前のネクストホップからルートへのトラフィックを転送し続ける場合、パケット損失の期間を最小限に抑えるために、古いLSPを取り消す前に新しいLSPを確立する必要があります。

例えば、リンク障害後も、ダウンストリームの LSR(例えば、LSR-D)は、ワンホップの RSVP LSP からのパケット受信を継続するため、他のダウンストリームの LSR にパケットを受信および/または転送します。ルーティングが収束すると、LSR-D はこのポイントツーマルチポイント LSP の FEC(FEC-A)用に新しいアップストリーム LSR(LSR-U)を選択します。新しい LSR は、すでに FEC-A 用のパケットを LSR-D 以外のダウンストリーム LSR に転送している可能性があります。LSR-Uは、LSR-DからFEC-Aのラベルを受信した後、LSR-A用LSPがルートから自身に確立されたことを学習すると、LSR-Dに通知します。LSR-Dはこのような通知を受信すると、LSPルートのネクストホップをLSR-Uに変更します。これは、LSR-Dでのルート削除と追加の操作です。この時点で、LSR-DはLSPスイッチオーバーを行い、RSVP LSPまたはLFAを介してトンネリングされたトラフィックはドロップされ、LSR-Uからのトラフィックは受け入れられます。LSR-Uの新しいトランジットルートが追加されました。RPF チェックが、LSR-U からのトラフィックを受け入れ、古いアップストリーム LSR からのトラフィックをドロップするように変更されるか、古いルートが削除されて新しいルートが追加されます。

LSR-Uは、FEC-AポイントツーマルチポイントLSPのアップストリームルーターからメークビフォアブレーク通知を受信し、LSPの転送状態をインストールしていることを前提としています。その時点で、FEC-A によって識別されるツリーの一部になったこと、および LSR-D が LSP への切り替えを開始することを、メークビフォアブレーク通知によって LSR-D に通知する必要があります。それ以外の場合、LSR-Uは、FEC-AのアップストリームLSRからメークビフォアブレーク通知を受信し、このLSPの転送状態をインストールするときに、LSR-Dに通知を送信する必要があることを覚えておく必要があります。LSR-Dは、新しいポイントツーマルチポイントLSPからLSR-Uに切り替えるまで、1ホップのRSVP LSPまたはLFAパスを使用して、古いネクストホップからルートノードへのトラフィックを受信し続けます。

マルチキャストLDPリンク保護によるメークビフォアブレーク機能には、以下の機能があります。

事前対応機能

LSRは、機能アドバタイズメントを使用して、事前対応LSPを処理できることをアドバタイズします。ピアが事前対応でない場合、事前対応パラメーターはこのピアに送信されません。LSRがダウンストリームのLSR(LSR-D)からメークビフォアブレークパラメータを受信したが、アップストリームのLSR(LSR-U)がメークビフォアブレークに対応していない場合、LSRは直ちにメークビフォアブレーク通知をLSR-Dに送信し、メークビフォアブレーク対応LSPは確立されません。代わりに、通常のLSPが確立されます。

事前対応ステータスコード

事前対応ステータスコードには、以下が含まれます。

1 - 事前対応要求

2 - 事前対応確認応答

ダウンストリームの LSR がポイントツーマルチポイント LSP のラベルマッピングメッセージを送信すると、1(リクエスト)として事前対応ステータスコードが含まれます。アップストリームの LSR がポイントツーマルチポイント LSP の転送状態を更新すると、ダウンストリームの LSR に、メークビフォアブレークのステータスコードを含む通知メッセージを 2(確認応答)として通知します。その時点で、ダウンストリームの LSR は LSP スイッチオーバーを行います。

注意事項と制限事項

LDPリンク保護機能のJunos OS実装には、以下の注意点と制限があります。

メークビフォアブレークは、エグレス LSR 上の以下のポイントツーマルチポイント LSP ではサポートされていません。

仮想ルーティングおよび転送(VRF)ラベルを使用した次世代マルチキャスト仮想プライベートネットワーク(MVPN)

静的LSP

以下の機能はサポートされていません。

Junos OSリリース12.3、13.1、13.2におけるポイントツーマルチポイントLSPのノンストップアクティブルーティング

グレースフル リスタート スイッチオーバー ポイントツーマルチポイント LSP

ルーティングインスタンスのリンク保護

例:LDPリンク保護の設定

この例では、ユニキャストおよびマルチキャストLDPラベルスイッチパス(LSP)の両方に対して、ラベル配布プロトコル(LDP)リンクプロテクションを設定する方法を示します。

要件

この例では、以下のハードウェアおよびソフトウェアコンポーネントを使用しています。

M Series、MXシリーズ、またはT Seriesルーターの組み合わせが可能な6台のルーターで、1つのルートノードと2つのリーフノードでポイントツーマルチポイントLDP LSPを実行します。

すべてのルーターで実行されている Junos OS リリース 12.3 以降。

始める前に:

デバイスインターフェイスを設定します。

以下のプロトコルを設定します。

出欠確認

MPLS

OSPFまたはその他のIGP

LDP

概要

LDPリンク保護により、リンク障害が発生した場合にLDP LSPを介して伝送されるトラフィックの高速再ルートが可能になります。LDPポイントツーマルチポイントLSPを使用して、単一のルートまたはイングレスノードから、1つ以上のトランジットノードを通過する多数のリーフノードまたはエグレスノードにトラフィックを送信できます。ポイントツーマルチポイント ツリーのリンクの 1 つに障害が発生すると、IGP が再収束し、マルチキャスト LDP がダウンストリーム ルーターから新しいアップストリーム ルーターへの最適なパスを使用してラベル マッピングを開始するまで、サブツリーが切り離される可能性があります。リンク障害が発生した場合にトラフィックを保護するために、明示的なトンネルを設定して、トンネルを使用してトラフィックを再ルーティングできるようにすることができます。Junos OSは、古いLSPパスを破棄する前に新しいLSPパスに信号を送ろうとする際のパケット損失を最小限に抑えるために、メークビフォアブレーク機能をサポートしています。この機能により、マルチキャストLDPリンク保護のターゲットLDPサポートも追加されます。

LDPリンク保護を設定する際は、以下の点に留意してください。

IGPでトラフィックエンジニアリングを設定し(デフォルトでサポートされていない場合)、MPLSとRSVP用に設定されたインターフェイスを含めて、制約付きベースのリンク保護動的RSVP LSPが、CSPF(制約付き最短パスファースト)を使用してRSVPによってシグナリングされるようにします。この条件が満たされない場合、RSVP LSP が立ち上がらない可能性があり、LDP はそれを保護されたネクストホップとして使用できません。

リンク障害が発生した場合に、2つのLSR(ラベルスイッチルーター)間のパスを設定し、ルーター間でIP接続を提供します。これにより、CSPF はリンク保護の代替パスを計算できます。ルーター間の接続が失われると、LDP ターゲット隣接関係が立ち上がらず、動的 RSVP LSP がシグナリングされないため、ピアがダウンストリーム LSR である LDP 転送等価クラス(FEC)の保護は失われます。

リンク保護が一方のLSRでのみアクティブである場合、もう一方のLSRに