Présentation de l’interconnexion du datacenter VXLAN avec EVPN

À partir de la version 16.1 de Junos OS, la technologie EVPN (Ethernet VPN) peut être utilisée pour interconnecter des réseaux VXLAN (Virtual Extensible Local Area Network) sur un réseau MPLS/IP afin d’assurer la connectivité du centre de données. Pour ce faire, la connectivité intra-sous-réseau de couche 2 et la séparation des plans de contrôle entre les réseaux VXLAN interconnectés sont nombreux.

Les sections suivantes présentent la technologie et la mise en œuvre de l’intégration d’EVPN à VXLAN en tant que solution d’interconnexion de datacenter (DCI).

Présentation technologique de l’intégration VXLAN-EVPN pour DCI

Les sections suivantes donnent un aperçu conceptuel des VXLAN et des EVPN, de la nécessité de leur intégration pour DCI et des avantages qui en découlent.

- Comprendre le VXLAN

- Comprendre l’EVPN

- Présentation de l’intégration VXLAN-EVPN

- Format de paquet VXLAN-EVPN

- Procédure pas à pas sur les paquets VXLAN-EVPN

Comprendre le VXLAN

VXLAN (Virtual Extensible Local Area Network) est un protocole d’encapsulation de couche 3 qui permet aux routeurs MX Series d’envoyer des paquets de couche 2 ou 3 à travers un tunnel VXLAN vers un centre de données virtualisé ou Internet. La communication est établie entre deux points de terminaison de tunnel virtuel (VTEP), qui peuvent être des hôtes finaux ou des commutateurs réseau ou des routeurs, qui encapsulent et désencapsulent le trafic de la machine virtuelle (VM) dans un en-tête VXLAN.

VXLAN est souvent décrit comme une technologie de superposition, car il permet d’étirer des connexions de couche 2 sur un réseau de couche 3 intermédiaire en encapsulant (tunnelisation) des trames Ethernet dans un paquet VXLAN comprenant des adresses IP. Cette fonctionnalité de VXLAN répond aux exigences d’un datacenter mutualisé, dans lequel la machine virtuelle de chaque locataire peut partager le serveur physique avec d’autres locataires répartis sur des serveurs physiques au sein de ou entre différents datacenters, en répondant au besoin croissant de fournir une connectivité de couche 2 transparente entre toutes les VM appartenant à un locataire, en plus d’isoler le trafic de chaque locataire pour des raisons de sécurité et les chevauchements potentiels d’adresses MAC.

Les tunnels VXLAN sont créés entre les serveurs physiques par les hyperviseurs. Étant donné qu’un serveur physique peut héberger plusieurs locataires, chaque hyperviseur crée plusieurs tunnels VXLAN.

VXLAN

VXLAN

VXLAN est une technologie qui vous permet de segmenter vos réseaux (comme le font les VLAN), mais qui résout également les limitations d’évolutivité des VLAN et offre des avantages que ces derniers ne peuvent pas offrir. Voici quelques-uns des avantages clés de l’utilisation de VXLAN :

En théorie, vous pouvez créer jusqu’à 16 millions de VXLAN dans un domaine administratif (contre 4 094 VLAN sur un équipement Juniper Networks).

Les routeurs MX Series prennent en charge jusqu’à 32 000 VXLAN. Cela signifie que les VXLAN permettent de segmenter le réseau à l’échelle requise par les gestionnaires cloud pour prendre en charge un très grand nombre de locataires.

Vous pouvez activer la migration de machines virtuelles entre des serveurs existant dans des domaines de couche 2 distincts en tunnelisant le trafic sur des réseaux de couche 3. Cette fonctionnalité vous permet d’allouer dynamiquement des ressources au sein des centres de données ou entre eux, sans être contraint par les limites de la couche 2 ni être obligé de créer des domaines de couche 2 plus grands ou géographiquement étendus.

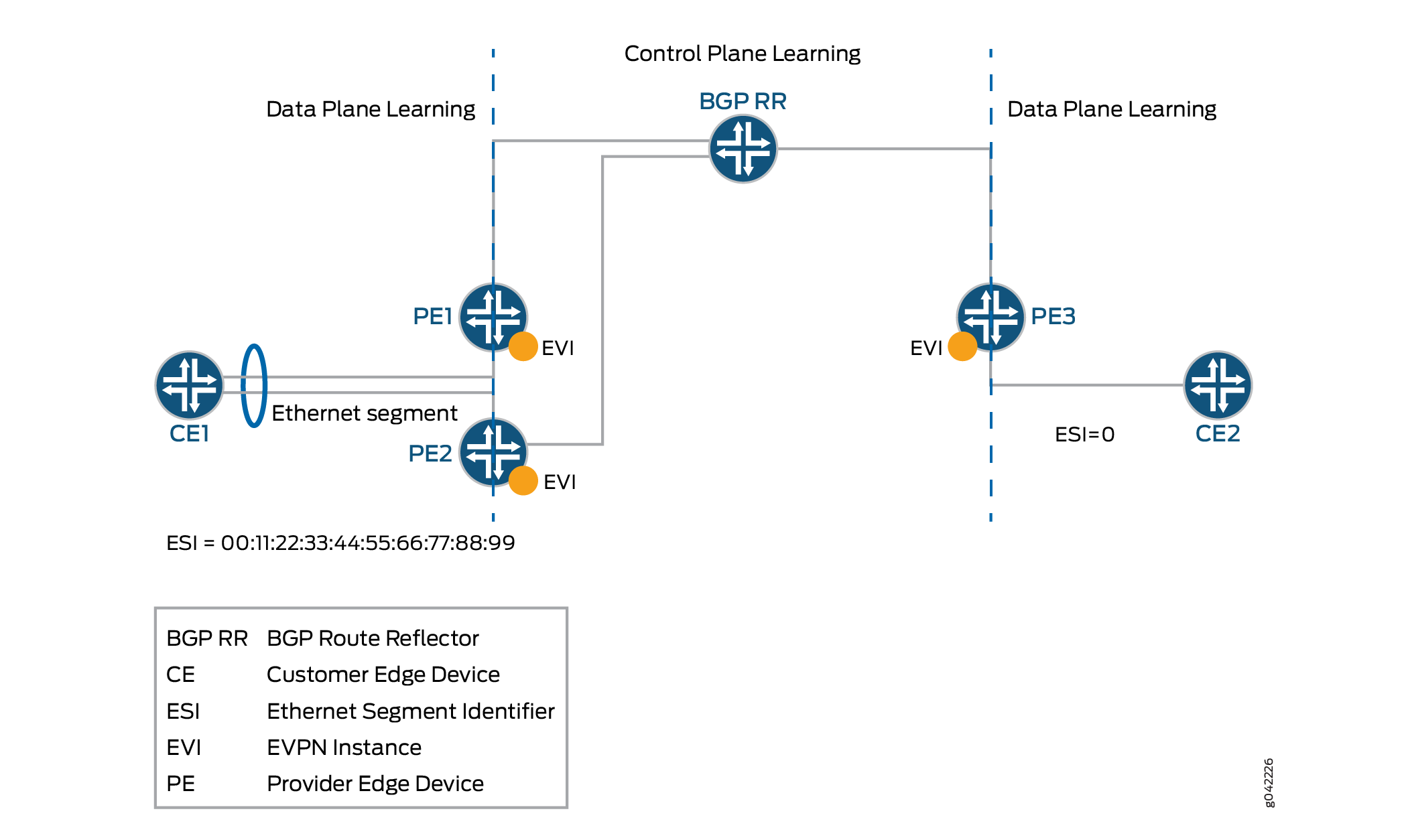

Comprendre l’EVPN

L’EVPN est une nouvelle technologie standardisée qui fournit une connectivité pontée multipoint virtuelle entre différents domaines de couche 2 sur un dorsale IP ou IP/MPLS. À l’instar d’autres technologies VPN, telles qu’IPVPN et VPLS, les instances EVPN (EVI) sont configurées sur les routeurs PE pour maintenir une séparation logique des services entre les clients. Les PE se connectent à des périphériques CE qui peuvent être un routeur, un commutateur ou un hôte. Les routeurs PE échangent ensuite des informations d’accessibilité à l’aide du protocole BGP MULTI-PROTOCOLE (MP-BGP) et le trafic encapsulé est transféré entre les PE. Étant donné que certains éléments de l’architecture sont communs avec d’autres technologies VPN, EVPN peut être introduit et intégré de manière transparente dans les environnements de services existants.

La technologie EVPN fournit des mécanismes pour l’interconnexion du datacenter (DCI) de nouvelle génération en ajoutant des procédures étendues de plan de contrôle pour échanger les informations de couche 2 (adresse MAC) et de couche 3 (adresse IP) entre les routeurs de bordure de centre de données (DCBR) participants. Ces fonctionnalités permettent de relever certains défis liés aux DCI, tels que la mobilité transparente des machines virtuelles et le routage IP optimal. La mobilité transparente des machines virtuelles fait référence au défi de l'extension de la couche 2 et du maintien de la connectivité face à la mobilité des machines virtuelles, et le routage IP optimal fait référence au défi de prendre en charge le comportement de passerelle par défaut pour le trafic sortant d'une machine virtuelle et d'éviter le routage triangulaire du trafic entrant d'une machine virtuelle.

La technologie EVPN est utilisée par l’opérateur de datacenter pour offrir des services multi-tenants, flexibles et résilients, extensibles à la demande. Cette flexibilité et cette résilience peuvent nécessiter l’utilisation de ressources de calcul entre différents datacenters physiques pour un seul service (extension de couche 2) et le mouvement des machines virtuelles.

EVPN prend en charge le multihébergement actif, qui permet à un équipement CE de se connecter à deux routeurs PE ou plus, de sorte que le trafic est transféré en utilisant toutes les liaisons entre les périphériques. Cela permet au CE d’équilibrer la charge du trafic vers les différents routeurs PE. Plus important encore, il permet à un PE distant d’équilibrer la charge du trafic vers les PE multirésidents sur le réseau central. Cet équilibrage de charge des flux de trafic entre les centres de données est connu sous le nom de crénelage. EVPN dispose également de mécanismes qui empêchent la boucle du trafic de diffusion, unicast inconnu et multicast (BUM) dans une topologie multirésidente entièrement active.

Le multihébergement fournit une redondance en cas de défaillance d’une liaison d’accès ou de l’un des routeurs PE. Dans les deux cas, les flux de trafic du CE vers le PE utilisent les liens actifs restants. Pour le trafic dans l’autre sens, le PE distant met à jour sa table de transfert pour envoyer le trafic aux PE actifs restants connectés au segment Ethernet multirésident. EVPN fournit un mécanisme de convergence rapide, de sorte que le temps nécessaire pour effectuer cet ajustement est indépendant du nombre d’adresses MAC apprises par le PE.

Le plan de contrôle MP-BGP d’EVPN permet de déplacer dynamiquement des machines virtuelles actives d’un datacenter à un autre, ce que l’on appelle également le mouvement des machines virtuelles. Une fois qu’une machine virtuelle est déplacée vers un serveur/hyperviseur de destination, elle transmet un ARP gratuit qui met à jour la table de transfert de couche 2 du PE au niveau du centre de données de destination. Le PE transmet ensuite une mise à jour de route MAC à tous les PE distants, qui à leur tour mettent à jour leurs tables de transfert. De cette manière, un EVPN suit le mouvement de la machine virtuelle, également appelé mobilité MAC. L’EVPN dispose également de mécanismes permettant de détecter et d’arrêter les battements d’électricité MAC.

La technologie EVPN, similaire au VPN MPLS de couche 3, est une technologie qui introduit le concept de routage des adresses MAC à l’aide de MP-BGP sur un cœur MPLS. Voici quelques-uns des avantages clés de l’utilisation d’EVPN :

Possibilité d’avoir un double équipement de périphérie multirésident actif.

Assure l’équilibrage de charge sur les liaisons à double activité.

Fournit la mobilité de l’adresse MAC.

Offre une architecture mutualisée.

Fournit un crénelage.

Permet une convergence rapide.

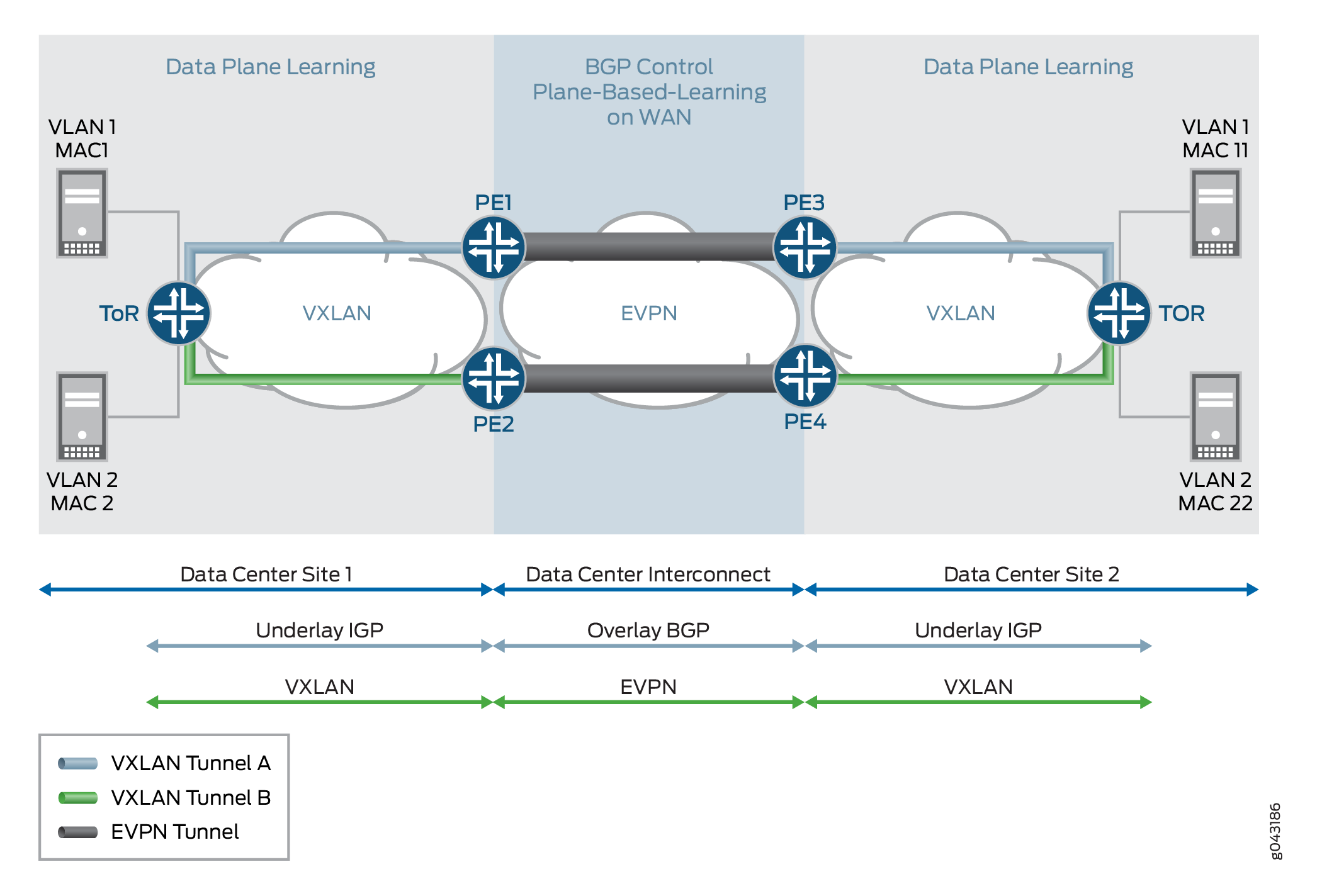

Présentation de l’intégration VXLAN-EVPN

VXLAN définit un schéma de tunnelisation pour superposer les réseaux de couche 2 aux réseaux de couche 3. Il permet un transfert optimal des trames Ethernet avec la prise en charge du multipathing du trafic unicast et multicast à l’aide de l’encapsulation UDP/IP pour le tunneling. Il est principalement utilisé pour la connectivité intra-datacenter du site.

D’autre part, une caractéristique unique de l’EVPN est que l’apprentissage de l’adresse MAC entre les périphériques PE se produit dans le plan de contrôle. Une nouvelle adresse MAC détectée à partir d’un périphérique CE est annoncée par le PE local, à l’aide de MP-BGP, à tous les périphériques PE distants. Cette méthode diffère des solutions VPN de couche 2 existantes telles que VPLS, qui apprennent en noyant une unicast inconnue dans le plan de données. Cette méthode d’apprentissage MAC basée sur le plan de contrôle est le principal catalyseur des nombreuses fonctionnalités utiles fournies par EVPN.

Étant donné que l’apprentissage MAC est géré dans le plan de contrôle, EVPN a la flexibilité nécessaire pour prendre en charge différentes technologies d’encapsulation de plan de données entre les PE. Ceci est important car tous les réseaux dorsales n’exécutent pas nécessairement MPLS, en particulier dans les réseaux d’entreprise.

L’EVPN suscite aujourd’hui un vif intérêt, car il répond à de nombreux défis auxquels sont confrontés les opérateurs réseau qui construisent des datacenters pour offrir des services de cloud et de virtualisation. L’application principale de l’EVPN est l’interconnexion du datacenter (DCI), qui permet d’étendre la connectivité de couche 2 entre différents datacenters déployés pour améliorer les performances de transmission du trafic applicatif aux utilisateurs finaux et pour la reprise après sinistre.

Bien qu’il existe différentes technologies DCI, EVPN présente un avantage supplémentaire par rapport aux autres technologies MPLS en raison de ses fonctionnalités uniques, telles que la redondance active-active, le crénelage et le retrait MAC de masse. C’est pourquoi VXLAN est intégré à EVPN afin de fournir une solution aux DCI.

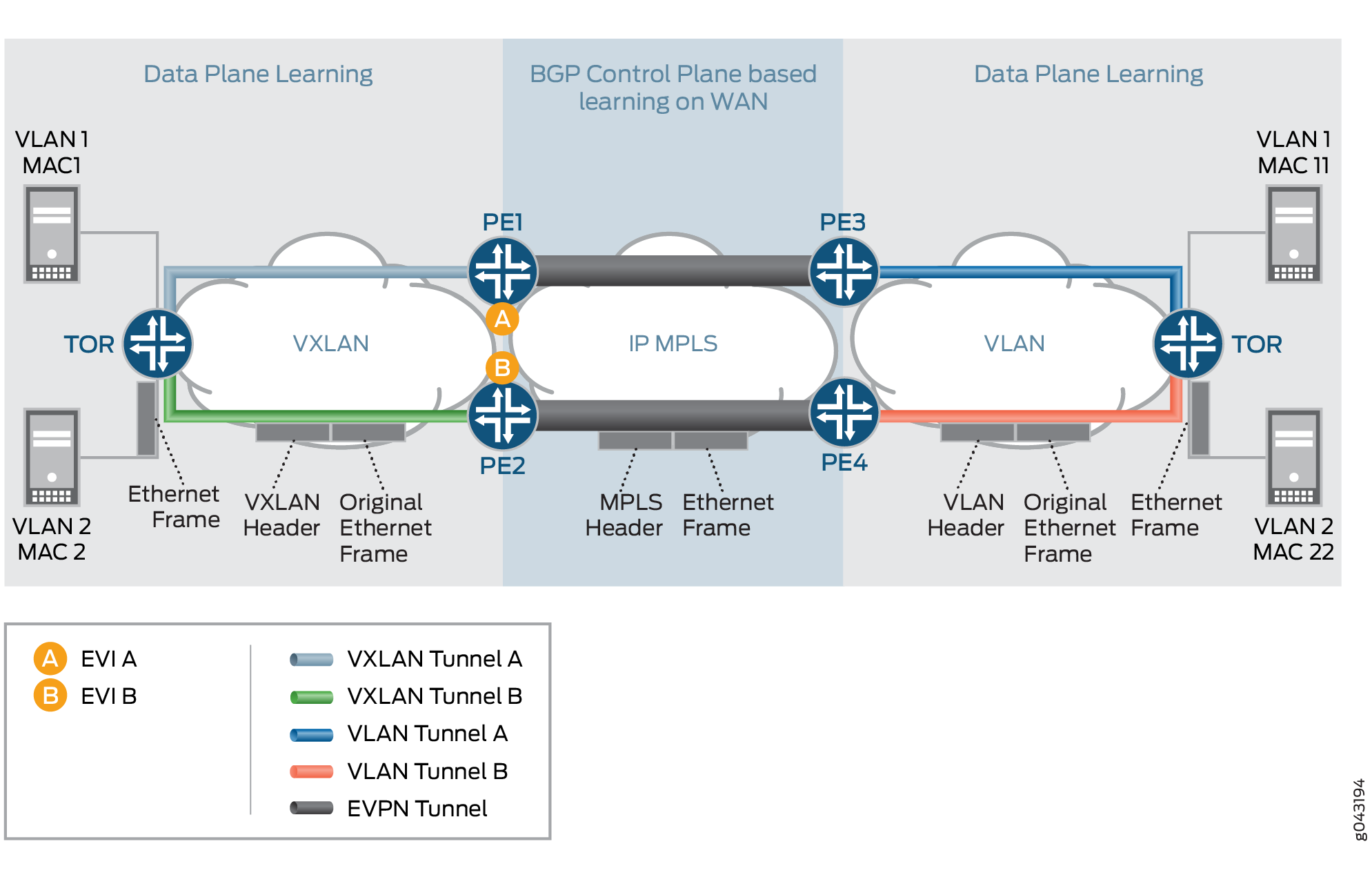

Chaque réseau VXLAN, qui est connecté au cœur MPLS ou IP, exécute une instance indépendante du plan de contrôle IGP. Chaque équipement PE participe à l’instance du plan de contrôle IGP de son réseau VXLAN. Ici, chaque client est un datacenter, il dispose donc de son propre routeur virtuel pour la sous-couche VXLAN.

Chaque nœud PE peut mettre fin à l’encapsulation du plan de données VXLAN, chaque VNI ou VSID étant mappé à un domaine de pont. Le routeur PE effectue l’apprentissage du plan de données sur le trafic reçu du réseau VXLAN.

Chaque nœud PE implémente EVPN pour distribuer les adresses MAC des clients apprises sur le tunnel VXLAN vers BGP. Chaque nœud PE encapsule les trames VXLAN ou Ethernet avec MPLS lors de l’envoi des paquets via le cœur MPLS et avec l’en-tête de tunnel VXLAN lors de l’envoi des paquets sur le réseau VXLAN

VXLAN-EVPN

VXLAN-EVPN

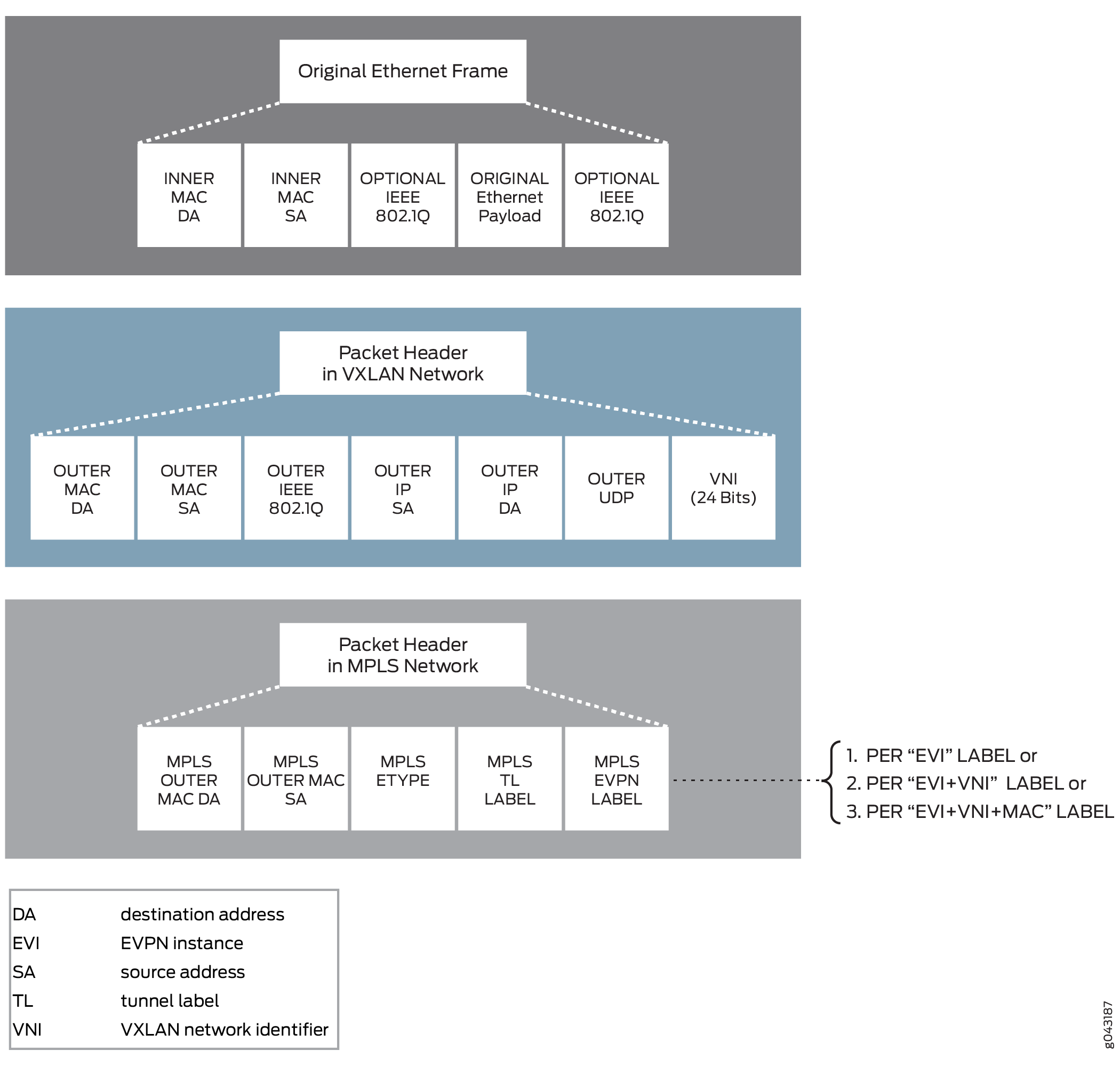

Format de paquet VXLAN-EVPN

Le format des paquets VXLAN et EVPN est le suivant :

de paquet VXLAN-EVPN

de paquet VXLAN-EVPN

Procédure pas à pas sur les paquets VXLAN-EVPN

Les sections suivantes décrivent la procédure pas à pas des paquets pour deux types de trafic entre les réseaux VXLAN et EVPN :

Gestion du trafic BUM

Le trafic VXLAN vers EVPN BUM entre VXLAN segment1 et VXLAN segment2 sur le cloud EVPN est géré comme suit :

0: au démarrage, le serveur A veut envoyer du trafic au serveur B. Étant donné que le serveur A n’a pas de liaison ARP pour le serveur B dans sa table ARP, le serveur A génère une demande de diffusion ARP et l’envoie.

Le contenu des paquets ARP est le suivant :

ID VLAN = VLAN 10

Source MAC= MAC1

MAC de destination = ff.ff.ff.ff.ff.ff

Adresse IP source = adresse IP du serveur A ou adresse IP de la VM

Adresse IP de destination = adresse IP du serveur B

Type de paquet Ether = 0x0806

Une trame de couche 2 est envoyée au commutateur top-of-rack (TOR) TOR A, qui est compatible VXLAN.

1—La trame de requête ARP (diffusion) est reçue par le commutateur TOR A. TOR A est l’initiateur et le terminateur du VTEP VXLAN pour VNI 1000. Le VTEP pour VXLAN 1000 fait partie du domaine de diffusion pour le serveur A VLAN 10.

Après réception de la trame, le TOR A effectue le traitement des entrées, y compris la classification des paquets entrants. En fonction du VLAN entrant dans le paquet, le TOR A classe le paquet dans l’un des IFL sous un port donné. La famille de cet IFL est une famille de ponts. L’ID de domaine de pont est identifié en fonction de la famille de ponts IFL.

Une fois le domaine de pont identifié, TOR A apprend l’adresse MAC source de trame entrante afin que l’adresse MAC A devienne accessible via cet IFL. Étant donné que la trame est une trame de diffusion, le TOR A doit envoyer la trame à tous les membres du domaine de diffusion (autres que le membre sur lequel la trame a été reçue). L’un des membres du domaine de diffusion est le VTEP pour VNI 1000. Pour envoyer la trame sur le segment VXLAN, TOR A termine le traitement du saut suivant VXLAN BUM sur la trame. Le saut suivant pousse l’en-tête VXLAN.

Le contenu de l’en-tête VXLAN est le suivant :

Adresse MAC source = Adresse MAC ou interface d’adresse IP source

Adresse MAC de destination = Adresse MAC multicast

Adresse IP source = 10.10.10.1

Adresse IP de destination = Adresse de groupe multicast (226.0.39.16)

Port UDP source = Calculé en fonction du hachage de l’en-tête de trame entrante

Port UDP de destination = 4789 (port bien connu pour les tunnels VXLAN)

Une fois que la trame encapsulée VXLAN est générée, TOR A l’envoie au routeur PE2.

2: le routeur PE2 reçoit la trame VXLAN et l’identifie comme une trame VXLAN en examinant le port UDP de destination connu. L’ID VNI de cette trame VXLAN est utilisé pour l’identification du domaine de pont. Une fois que le routeur PE2 a identifié le domaine de pont, PE2 termine l’apprentissage MAC de l’adresse MAC source interne vers l’adresse IP source externe (mappage MACA vers 10.10.10.1). Une fois le mappage effectué, le traitement du saut suivant de la décapsulation VXLAN supprime l’en-tête VXLAN pour mettre fin au tunnel VXLAN.

3A: une fois l’apprentissage MAC terminé, l’adresse MAC source apprise (MAC1 vers l’adresse IP source externe) est envoyée à L2ALD. Cette route MAC est envoyée par L2ALD à RPD pour l’apprentissage du plan de contrôle de cette MAC par le biais de l’annonce de route MAC BGP aux homologues BGP. Une fois que les routeurs homologues pair BGP ont reçu l’annonce de route MAC, ils installent cette accessibilité MAC (MACA, ÉTIQUETTE MPLS L1) dans la table de domaine de pont.

3—Le domaine de pont donné pointe vers la route de saut suivant multicast pour le transfert du paquet sur le cloud EVPN. Ce saut suivant envoie l’étiquette de service (étiquette MPLS multicast associée au VNI par ID d’homologue, domaine de pont, étiquette est l’ID d’homologue et ID VNI). Le paquet MPLS est formé et envoyé sur le cloud MPLS.

4: le routeur PE4 reçoit la trame sous la forme d’un paquet MPLS. Ici, PE4 identifie le domaine du pont en recherchant l’étiquette MPLS L1 dans la table mpls.0. La recherche MPLS pointe vers le saut suivant de table pour le tronçon suivant du domaine de pont. Une fois que le domaine de pont est identifié et que le paquet est identifié comme un paquet de diffusion, le saut suivant du BUM Composite flood est exécuté. Le saut suivant composite BUM pointe également vers le saut suivant VXLAN (qui est utilisé pour construire le paquet multicast VXLAN).

5: le saut suivant VXLAN contient des informations pour construire l’en-tête VXLAN.

Les informations d’en-tête VXLAN sont les suivantes :

Adresse MAC source = Adresse MAC ou interface d’adresse IP source

Adresse MAC de destination = Adresse MAC multicast

Adresse IP source = 11.10.10.1

Adresse IP de destination = Adresse de groupe multicast (226.0.39.16)

Port UDP source = Calculé en fonction du hachage de l’en-tête de trame entrante

Port UDP de destination = 4789 (port bien connu pour le tunnel VXLAN)

6: la gestion des trames pour cette étape est identique à celle de l’étape 1. Une fois l’en-tête VXLAN supprimé, la trame est transférée vers la route CE flood associée au domaine de diffusion, et le paquet est transféré en tant que trame de couche 2.

7: le serveur B reçoit un paquet de requête ARP et envoie une réponse ARP au serveur A.

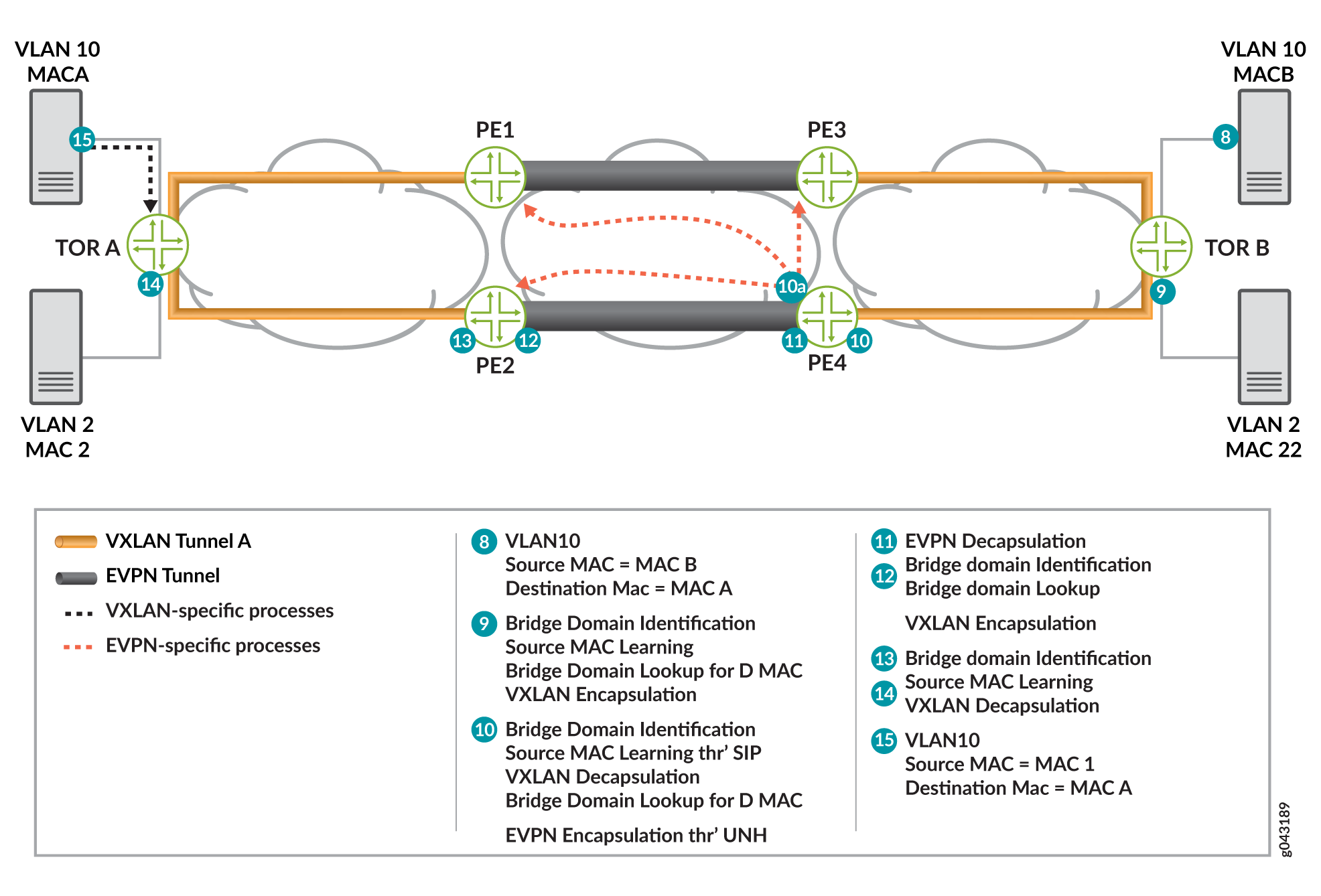

Gestion du trafic unicast

En supposant que l’apprentissage MAC des données et du plan de contrôle a déjà eu lieu, le trafic unicast VXLAN vers EVPN (réponse ARP) du serveur B est géré comme suit :

8: le serveur B génère une réponse ARP.

Le contenu des paquets ARP est le suivant :

ID VLAN = VLAN 10

Source MAC = MACB (MAC de l’interface du serveur B)

Destination MAC = MACA

Adresse IP source = adresse IP du serveur B ou adresse IP de la VM

Adresse IP de destination = adresse IP du serveur A

Le paquet ARP est transféré au commutateur TOR B.

9: après réception de la trame, le TOR B du commutateur classe la trame entrante. La trame est classée dans un IFL sur l’interface reçue. Sur la base de la famille IFL, le domaine de pont associé à IFL est identifié. Sur le domaine de pont donné, TOR B apprend l’adresse MAC source. Une fois que le TOR B a terminé la recherche MACA (Bridge Domain Destination MAC), cette recherche fournit le saut suivant unicast VXLAN. Le saut suivant contient toutes les informations nécessaires à la formation de l’en-tête VXLAN.

Le contenu du saut suivant requis pour former le paquet est le suivant :

Adresse MAC source = Adresse MAC de l’interface d’adresse IP source

Adresse MAC de destination = adresse MAC du saut suivant

Adresse IP source = 11.10.10.2

Adresse IP de destination = 11.10.10.1 (à la suite du processus d’apprentissage MAC)

Port UDP source = Calculé en fonction du hachage de l’en-tête de trame entrante

Port UDP de destination = 4789 (port bien connu pour le tunnel VXLAN)

Note:Une version antérieure du projet VXLAN utilisait le port UDP 8472.

10— Le PE du routeur reçoit la trame encapsulée VXLAN4. PE4 identifie la trame en effectuant la recherche à l’aide de l’adresse IP de destination et du port UDP de destination. Cette recherche entraîne la décapsulation VXLAN. Le saut suivant de décapsulation stocke également l’adresse IP source externe.

La recherche suivante est effectuée sur la base de l’ID VNI 1000. Cette recherche donne naissance à la table du domaine de la mariée.

10A—Le PE du routeur effectue l’apprentissage de l’adresse MAC source vers l’adresse IP source et L2ALD reçoit la notification d’apprentissage MAC. Ce MAC est envoyé à RPD pour être distribué à d’autres routeurs PE via la route d’annonce BGP-EVPN MAC. Le plan de contrôle BGP distribue ces informations d’accessibilité MAC à tous les autres routeurs PE.

La recherche MAC de destination (MAC1) est effectuée dans la table des adresses MAC du domaine de pont. Cette recherche aboutit à un saut suivant unicast (EVPN NH).

11: le saut suivant unicast EVPN est exécuté. Ce tronçon suivant contient une étiquette de service MPLS unicast. Cette étiquette est distribuée via le plan de contrôle MP-BGP. L’homologue en aval attribue cette étiquette de service MPLS. L’attribution de cette étiquette peut se faire par PE (PE, VLAN) ou par adresse MAC. Sur la base des informations du saut suivant, le paquet MPLS est formé et transféré sur le réseau MPLS.

12: le routeur PE2 reçoit la trame. La trame est identifiée comme un paquet MPLS. Une recherche d’étiquettes MPLS est effectuée dans la table MPLS.0. Cette recherche génère le saut suivant de la table et la table de domaine de pont.

La recherche MAC de destination (MAC1) est effectuée dans la table MAC du domaine de pont. Cette recherche génère un saut suivant unicast VXLAN.

13: le saut suivant unicast VXLAN contient toutes les informations nécessaires à la création de l’en-tête encapsulé VXLAN. L’en-tête VXLAN est imposé au paquet.

Les contenus de l’en-tête du saut suivant de l’encapsulation VXLAN sont les suivants :

Adresse MAC source = Adresse MAC de l’interface d’adresse IP source

Adresse MAC de destination = adresse MAC du saut suivant

Adresse IP source = 10.10.10.2

Adresse IP de destination = 10.10.10.1 (à la suite du processus d’apprentissage MAC)

Port UDP source = Calculé en fonction du hachage de l’en-tête de trame entrante

Port UDP de destination = 4789 (port bien connu pour le tunnel VXLAN)

14—La trame encapsulée VXLAN est reçue par le commutateur TOR A. TOR A identifie la trame en effectuant la recherche à l’aide de l’adresse IP de destination et du port UDP de destination. Cette recherche entraîne la décapsulation VXLAN. Le saut suivant désencapsulé stocke également l’adresse IP source externe.

La recherche suivante est effectuée sur la base de l’ID VNI 1000. Cette recherche donne naissance à la table du domaine de la mariée. Le TOR A termine l’apprentissage de l’adresse MAC source (MAC2) vers l’adresse IP source (10.10.10.2). Le TOR A recherche l’adresse MAC de destination (MAC1) dans la table des adresses MAC du domaine de pont. Cette recherche aboutit à un saut suivant unicast contenant les informations sur l’interface de sortie.

15: le serveur A reçoit la réponse ARP, et le serveur A et le serveur B sont prêts à communiquer.

Présentation de la mise en œuvre de l’intégration VXLAN-EVPN pour DCI

Les sections suivantes présentent des scénarios d’utilisation de l’intégration VXLAN-EVPN pour DCI.

- Cas d’usage du service de base VNI

- Cas d’usage du service VNI Aware

- Cas d’usage de l’interopérabilité VXLAN-VLAN

- cas d’usage du routage inter-VXLAN

- cas d’usage de la redondance

Cas d’usage du service de base VNI

Dans le cas du service VNI de base, il existe un mappage un-à-un entre un VNI et un EVI. Dans ce cas, il n’est pas nécessaire de transporter le VNI dans la route d’annonce MAC, car l’ID de domaine de pont peut être dérivé de la cible de route (RT) associée à cette route. L’attribution des étiquettes MPLS se fait par EVI.

La figure 7 donne un aperçu des scénarios d’utilisation de base VNI. Le service VNI de base est le plus souvent utilisé pour réaliser la traduction VNI et l’interopérabilité VNI vers VLAN.

VNI de base

VNI de base

Cas d’usage du service VNI Aware

Dans le cas du mode bundle prenant en charge les VNI, plusieurs VNI peuvent être mappés à la même EVI. L’ID de balise Ethernet doit être défini sur l’ID VNI dans les annonces de routes BGP. Dans ce cas d’utilisation, l’attribution des étiquettes MPLS doit se faire par EVI et VNI, de sorte que le VXLAN puisse être arrêté au niveau du routeur PE entrant et recréé au niveau du routeur PE de sortie.

La figure 8 fournit des détails sur le cas d’utilisation du service VNI Aware Service.

conscient VNI

conscient VNI

Cas d’usage de l’interopérabilité VXLAN-VLAN

Ce scénario de cas d’utilisation est requis pour les sites de centres de données hétérogènes. Dans ce scénario, le nouveau site de datacenter est un site de datacenter basé sur VXLAN, et les anciens sites de datacenter sont basés sur VLAN. Dans ce scénario, il est nécessaire d’avoir une interopérabilité VXLAN avec VLAN sur EVPN.

La Figure 9 présente la procédure pas à pas détaillée des paquets pour le scénario d’utilisation d’interopérabilité VXLAN-VLAN. Il est nécessaire d’assurer l’interopérabilité VLAN à VXLAN et vice-versa du point de vue des mises à jour de route BGP du plan de contrôle. L’attribution de l’étiquette doit se faire sur la base de chaque EVI.

VXLAN-VLAN

VXLAN-VLAN

cas d’usage du routage inter-VXLAN

Dans ce cas d’usage, une machine virtuelle ou un hôte d’un sous-réseau (VNI-A) souhaite envoyer du trafic vers une machine virtuelle ou un hôte d’un autre sous-réseau (VNI-B). Pour assurer cette communication, le routage entre VXLAN doit être pris en charge.

La Figure 10 présente les scénarios d’utilisation du routage inter-VXLAN.

inter-VXLAN

inter-VXLAN

cas d’usage de la redondance

Les deux types de scénarios d’utilisation de redondance sont Actif-Veille et Actif-Actif.

Cas d’usage de la redondance en veille active

Dans ce scénario d’utilisation, le commutateur TOR (VXLAN à l’origine de GW) ou le réseau VXLAN à l’origine du tunnel VXLAN est connecté en double connexion à deux équipements PE pour une redondance active-veille. En cas de défaillance du lien ou du nœud actif, un chemin d’accès de secours prend le relais.

La Figure 11 fournit des détails sur le scénario d’utilisation de redondance active-veille.

veille-active

veille-active

Cas d’usage de la redondance active-active

Lorsque vous interconnectez EVPN-VXLAN dans un datacenter à EVPN-VXLAN dans un WAN à l’aide d’un modèle de passerelle sur les plates-formes QFX Series, vous pouvez configurer le mode de redondance actif-actif sur les équipements de périphérie client multirésidents afin d’équilibrer la charge du trafic unicast de couche 2 sur toutes les liaisons multirésidentes sur et vers le périphérique CE.

La définition de la interconnect-multihoming-peer-gateway commande CLI est requise pour les configurations MAC-VRF et VTEP-Scaling. Notez que dans certains cas, EVPN-VXLAN n’est pris en charge qu’en mode de mise à l’échelle VTEP, où un seul VTEP est créé pour un équipement homologue donné qui peut avoir plusieurs instances de routage. Dans ce cas, il n’est possible de représenter un appareil homologue que sous la forme d’un pair WAN (VTEP WAN) ou d’un VTEP DC (VTEP normal).

Pour la redondance actif-actif, des configurations supplémentaires sont requises dans la strophe « interconnexion » pour permettre l’interconnexion DCI. Pour une default switch (switch-options) configuration, veillez à définir le DCI sous global protocols evpn.

Exemple EVPN de protocoles :

evpn-vxlan-dc1

vtep-source-interface lo0.0;

instance-type mac-vrf;

route-distinguisher 101:1; //DC-RD

vrf-target target:1:1; //DC-RT

protocols {

evpn {

encapsulation vxlan;

extended-vni-list all;

interconnect {

vrf-target target:2:2; // WAN RT

vrf-import <>

route-distinguisher 101:2;// WAN RD

interconnected-vni-list all;

esi {

00:00:01:02:03:04:05:06:07:08;

all-active;

}

}

}

}

vlans {

bd1 {

vlan-id 51;

l3-interface irb.0;

vxlan {

vni 51;

translation-vni <>

}

}

}

}

global

protocols {

evpn {

interconnect-multihoming-peer-gateways <GW>

}

}

Remarque : interconnect-multihoming-peer-gateways doit être configuré pour contenir une liste de tous les homologues DCI sur le même DC.

La liste peut contenir jusqu’à 64 entrées de passerelle homologue. Assurez-vous de configurer sous la strophe et non sous un global protocol evpn paramètre mac-vrf.

Exemple : Le multihébergement actif-actif fournit des détails sur la redondance active-active.

Fonctionnalités prises en charge et non prises en charge pour VXLAN DCI à l’aide d’EVPN

Junos OS prend en charge les fonctionnalités suivantes pour VXLAN DCI à l’aide d’EVPN :

Mappage un à un d’un tunnel VXLAN et d’une instance EVPN. En d’autres termes, un mappage un-à-un entre un VNI et un EVI.

Mappage plusieurs-à-un des tunnels VXLAN sur une instance EVPN, où plusieurs VNI peuvent être mappés à la même EVI.

Traduction VNI.

Note:La traduction VNI est prise en charge par la normalisation d’une balise VXLAN dans un VLAN.

Interopérabilité VXLAN à VLAN.

Routage inter-VXLAN.

Une seule redondance active.

Redondance active-active en mode BIDIR PIM.

Protection du trafic des tunnels VXLAN via IPSec.

Basculement gracieux du moteur de routage.

l’ISSI.

Junos OS ne prend pas en charge les fonctionnalités suivantes pour VXLAN DCI à l’aide d’EVPN :

VXLAN utilise le port UDP 4789 attribué par l’IANA. Les paquets destinés au port UDP 4789 sont traités uniquement lorsque la configuration VXLAN est activée. Les paquets VXLAN sont désencapsulés par le plan de transfert et un paquet interne de couche 2 est traité. Les paquets MAC appris sont générés pour le traitement du plan de contrôle pour les entrées MAC nouvellement apprises. Ces entrées sont limitées à l’aide de l’infrastructure existante pour l’apprentissage MAC. VXLAN génère des messages d’apprentissage supplémentaires pour les points de terminaison distants. Ces messages sont également limités à l’aide de l’infrastructure existante pour la détection des dénis de service.

Les paquets reçus sur le tunnel VXLAN ne sont traités que si l’identifiant VXLAN du paquet est une entité connue de l’équipement. Les entités inconnues sont ignorées par le plan de transfert.

À l’aide de pare-feu configurables, les filtres peuvent être éliminés avant qu’ils n’atteignent le module de traitement VXLAN dans le plan de transfert des routeurs MX Series.

Systèmes logiques.

Tableau de l’historique des modifications

La prise en charge des fonctionnalités est déterminée par la plateforme et la version que vous utilisez. Utilisez l’explorateur de fonctionnalités pour déterminer si une fonctionnalité est prise en charge sur votre plateforme.