이 페이지의 내용

Ubuntu의 설치 전제 조건

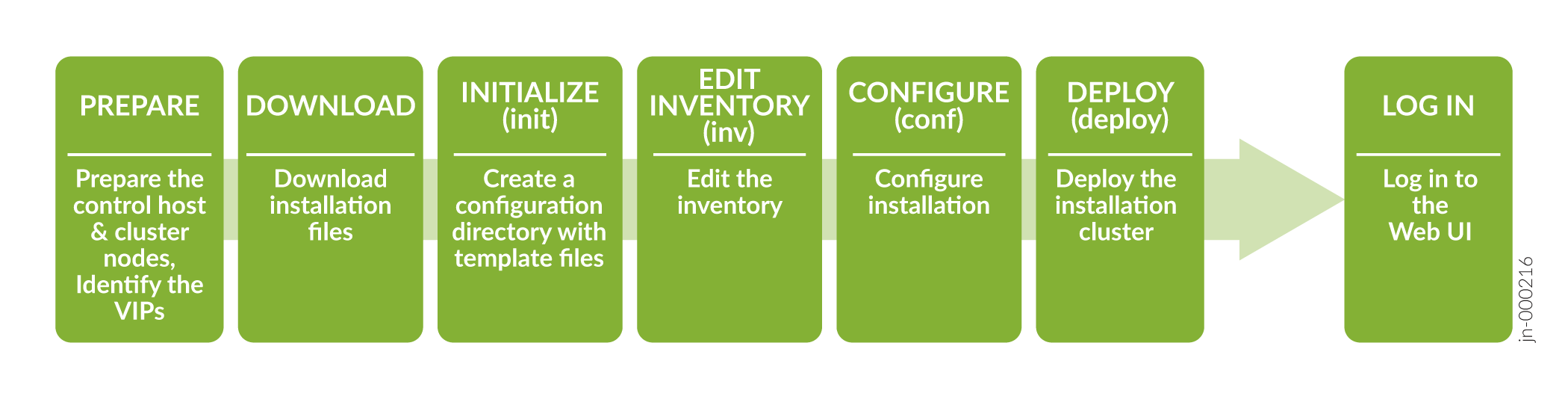

Paragon Automation 클러스터를 성공적으로 설치하고 배포하려면 여러 클러스터 노드에 배포 소프트웨어를 설치하는 제어 호스트가 있어야 합니다. 제어 호스트에서 배포 소프트웨어를 다운로드한 다음 설치 파일을 생성 및 구성하여 제어 호스트에서 설치를 실행할 수 있습니다. 제어 호스트에서 패키지를 다운로드하려면 인터넷에 액세스할 수 있어야 합니다. 또한 Docker 및 OS 패치와 같은 추가 소프트웨어를 다운로드하려면 클러스터 노드에서 인터넷에 액세스할 수 있어야 합니다. 설치 작업의 순서는 그림 1에 개략적으로 나와 있습니다.

설치를 위한 개략적인 프로세스 흐름

설치를 위한 개략적인 프로세스 흐름

배포 소프트웨어를 다운로드하고 설치하기 전에 이 항목에 설명된 대로 제어 호스트 및 클러스터 노드를 구성해야 합니다.

제어 호스트 준비

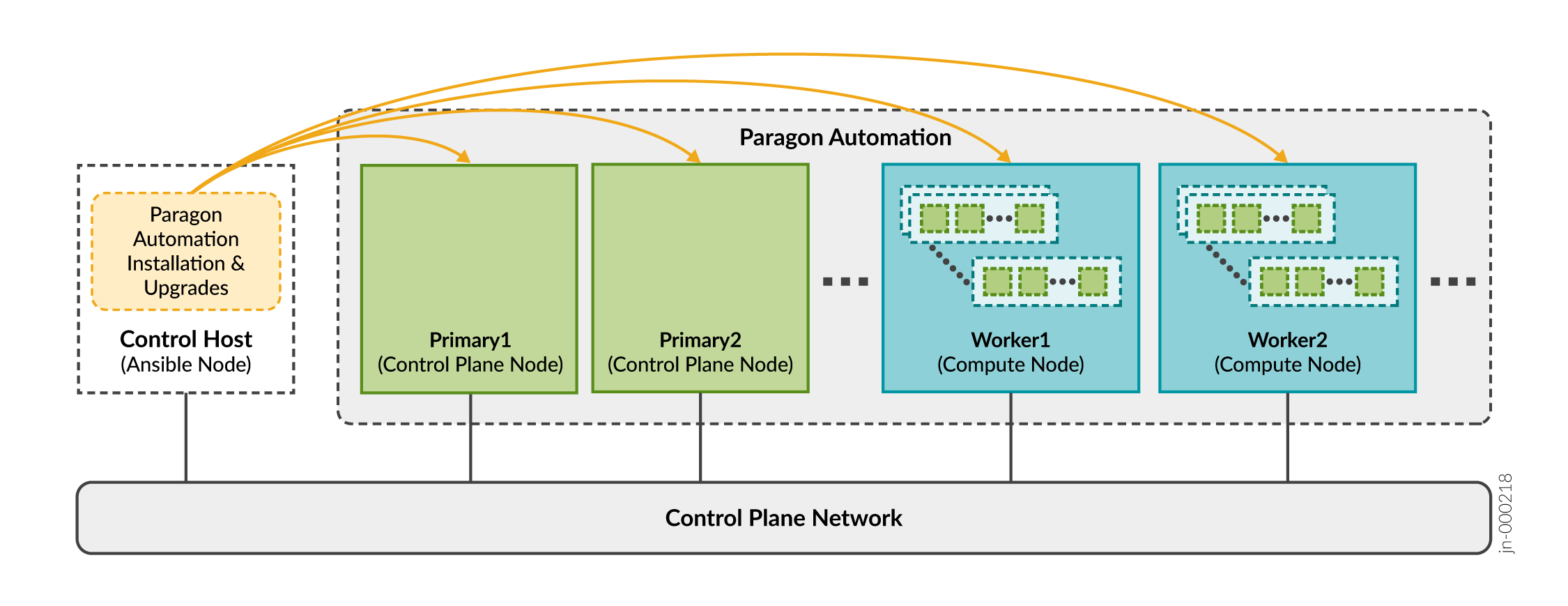

제어 호스트는 Paragon Automation 클러스터의 설치 및 업그레이드를 조정하는 전용 시스템입니다. 호스트 기능 제어에 설명된 대로 소프트웨어 설치 프로그램을 실행하고 클러스터 노드에 소프트웨어를 설치하는 Ansible 작업을 수행합니다.

Ansible 제어 호스트에서 설치 프로그램 패키지를 다운로드해야 합니다. Paragon Automation 설치 프로세스의 일부로 제어 호스트는 클러스터 노드에 필요한 추가 패키지를 설치합니다. 패키지에는 선택적 OS 패키지, Docker 및 Elasticsearch가 포함됩니다. 타사 마이크로서비스를 포함한 모든 마이크로서비스가 클러스터 노드에 다운로드됩니다. 마이크로서비스는 설치 중에 공용 레지스트리에 액세스하지 않습니다.

제어 호스트는 클러스터 노드와 다른 브로드캐스트 도메인에 있을 수 있지만 제어 호스트가 SSH를 사용하여 모든 노드에 연결할 수 있는지 확인해야 합니다.

제어

제어

설치가 완료되면 제어 호스트는 클러스터 작동에서 아무런 역할을 하지 않습니다. 그러나 소프트웨어 또는 구성 요소를 업데이트하거나, 클러스터를 변경하거나, 노드가 실패할 경우 클러스터를 다시 설치하려면 제어 호스트가 필요합니다. 또한 제어 호스트를 사용하여 구성 파일을 보관할 수 있습니다. 설치 후에는 제어 호스트를 계속 사용할 수 있으며 다른 용도로 사용하지 않는 것이 좋습니다.

다음과 같이 설치 프로세스를 위한 제어 호스트를 준비합니다.

클러스터 노드 준비

- Paragon Automation 및 매니지드 디바이스

- Paragon Automation과 네트워크 관리자

모든 노드를 동일한 브로드캐스트 도메인에 배치하는 것이 좋습니다. 서로 다른 브로드캐스트 도메인의 클러스터 노드의 경우 추가 로드 밸런싱 구성을 위해 로드 밸런싱 구성을 참조하십시오.

Paragon Automation 시스템 요구 사항에 설명된 대로 멀티노드 구축을 사용하여 Paragon Automation을 설치할 수 있습니다.

다음과 같이 Paragon Automation 설치 프로세스를 위한 클러스터 노드를 준비해야 합니다.

가상 IP 주소 고려 사항

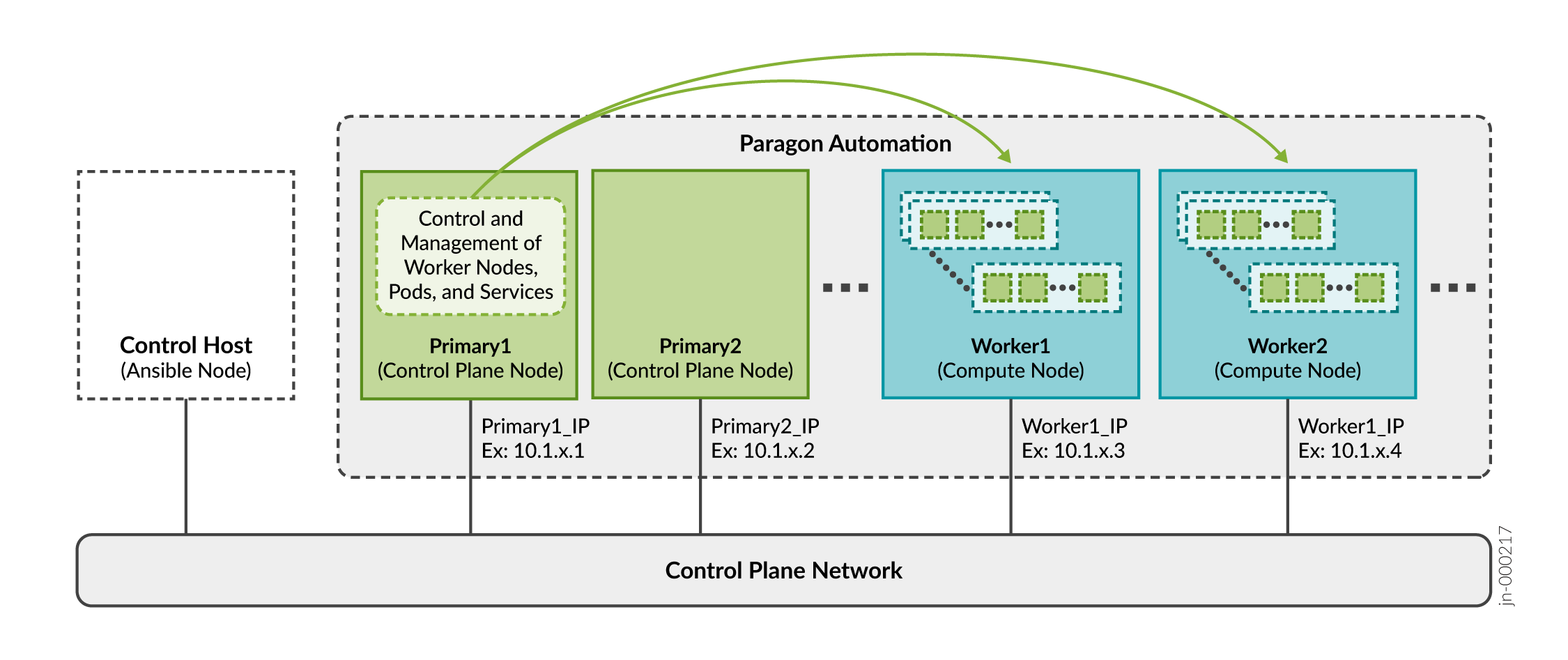

포드는 Kubernetes에서 생성되고 관리되는 배포 가능한 가장 작은 컴퓨팅 단위입니다. Pod에는 공유 스토리지 및 네트워크 리소스와 애플리케이션 실행 방법에 대한 구체적인 지침이 포함된 하나 이상의 컨테이너가 포함되어 있습니다. 컨테이너는 가장 낮은 수준의 처리이며 컨테이너에서 애플리케이션 또는 마이크로서비스를 실행합니다.

클러스터의 기본 노드는 특정 Pod 및 컨테이너를 호스팅할 작업자 노드를 결정합니다.

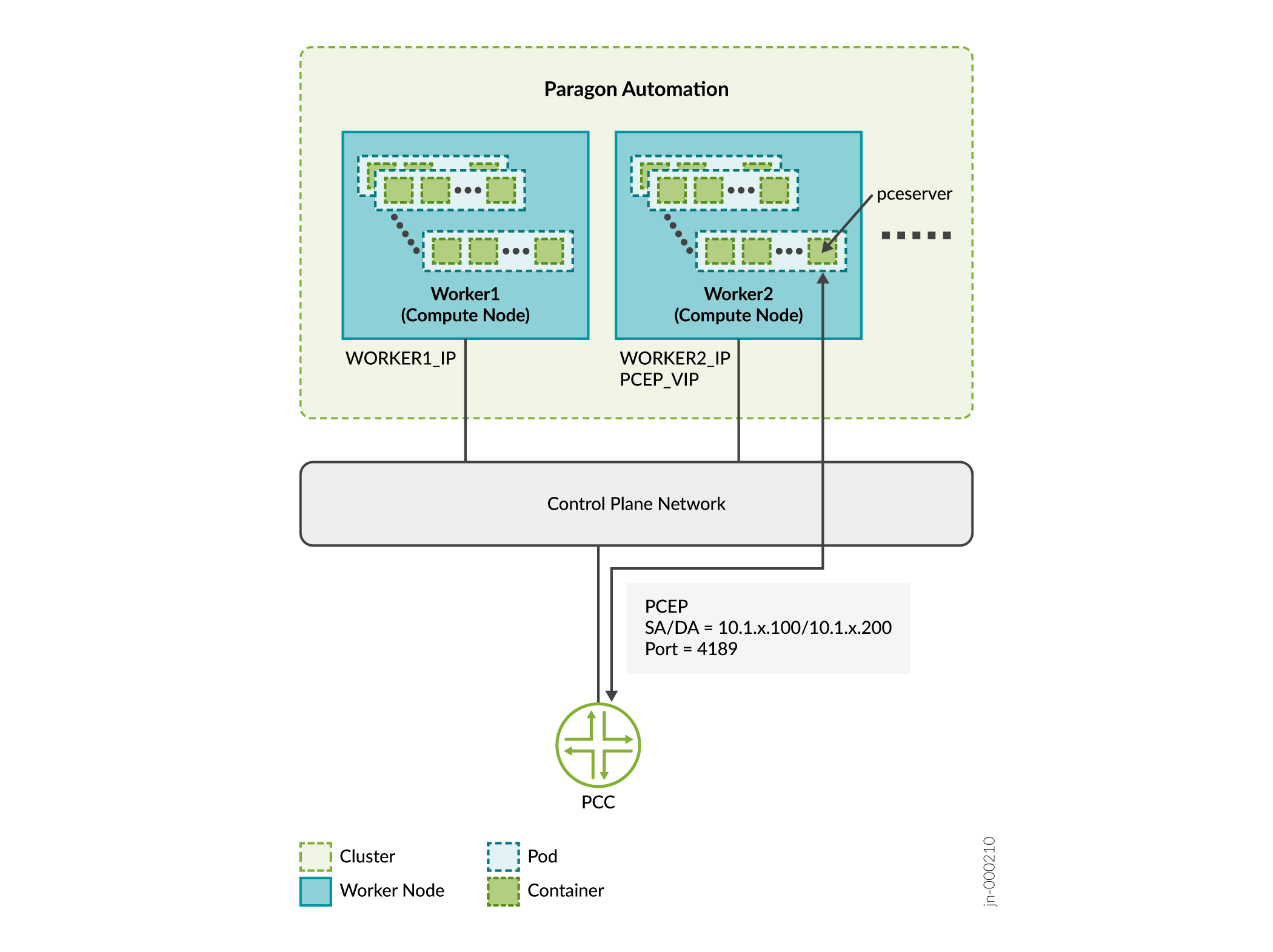

마이크로서비스 조합을 사용하여 Paragon Automation의 모든 기능을 구현합니다. 이러한 마이크로서비스 중 일부는 최종 사용자(관리되는 디바이스) 및 관리자에게 서비스를 제공할 때 클러스터 외부에서 액세스할 수 있도록 해야 합니다. 예를 들어, 프로바이더 에지(PE) 라우터와 Paragon Automation 간에 PCEP(Path Computation Element Protocol) 세션을 설정하려면 pceserver 서비스에 액세스할 수 있도록 해야 합니다.

외부 디바이스에서 연결할 수 있는 특정 주소를 사용하여 Kubernetes 클러스터 외부에 이러한 서비스를 노출해야 합니다. 서비스는 주어진 시간에 모든 작업자 노드에서 실행될 수 있으므로 가상 IP 주소(VIP)를 외부 주소로 사용해야 합니다. 지정된 작업자 노드의 주소를 외부 주소로 사용해서는 안 됩니다.

이 예제에서는 다음과 같습니다.

-

작업자 1이 10.1.x.3이고 작업자 2가 10.1.x.4라고 가정해 보겠습니다.

-

서비스 IP = PCEP VIP는 10.1.x.200입니다.

-

PCC_IP는 10.1.x.100입니다.

Paragon Automation 서비스는 서비스를 클러스터 외부에 노출하는 두 가지 방법 중 하나를 사용합니다.

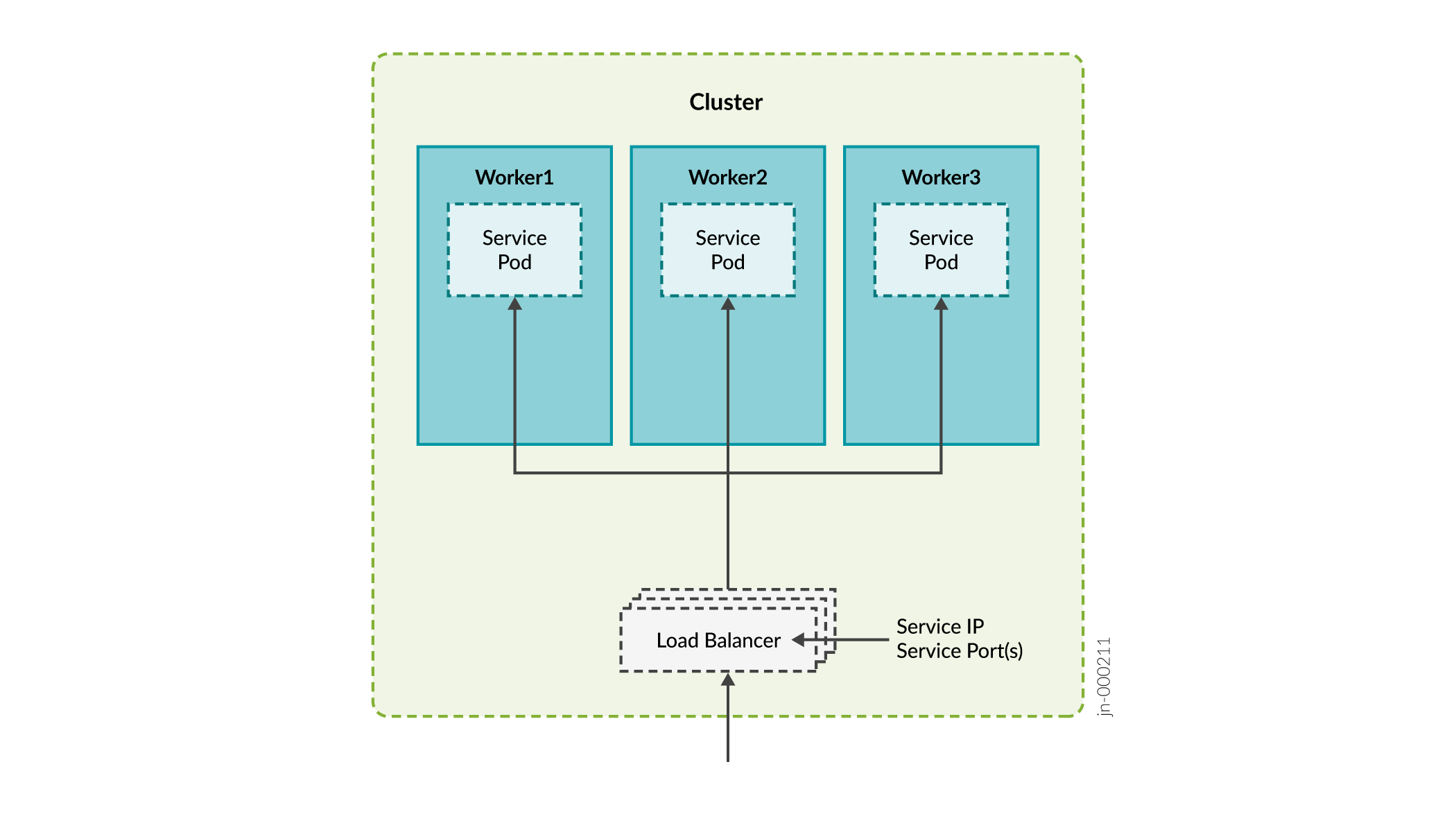

-

로드 밸런서 - 각 로드 밸런서는 특정 IP 주소와 연결되며 외부 트래픽을 클러스터의 특정 서비스로 라우팅합니다. 이는 클라우드에 설치된 많은 Kubernetes의 기본 방법입니다. 로드 밸런서 방식은 서비스당 여러 프로토콜과 여러 포트를 지원합니다. 각 서비스에는 고유한 부하 분산 장치와 IP 주소가 있습니다.

-

Paragon Automation은 MetalLB 로드 밸런서를 사용합니다. MetalLB는 레이어 2 모드에서 가상 IP 주소를 관리하거나 레이어 3 모드에서 외부 라우터와 상호 작용하여 외부 로드 밸런서를 시뮬레이션합니다. MetalLB는 Kubernetes 클러스터에 로드 밸런싱 인프라를 제공합니다.

"LoadBalancer" 유형의 서비스는 Kubernetes 로드 밸런싱 인프라와 상호 작용하여 외부에서 연결할 수 있는 IP 주소를 할당합니다. 일부 서비스는 외부 IP 주소를 공유할 수 있습니다.

-

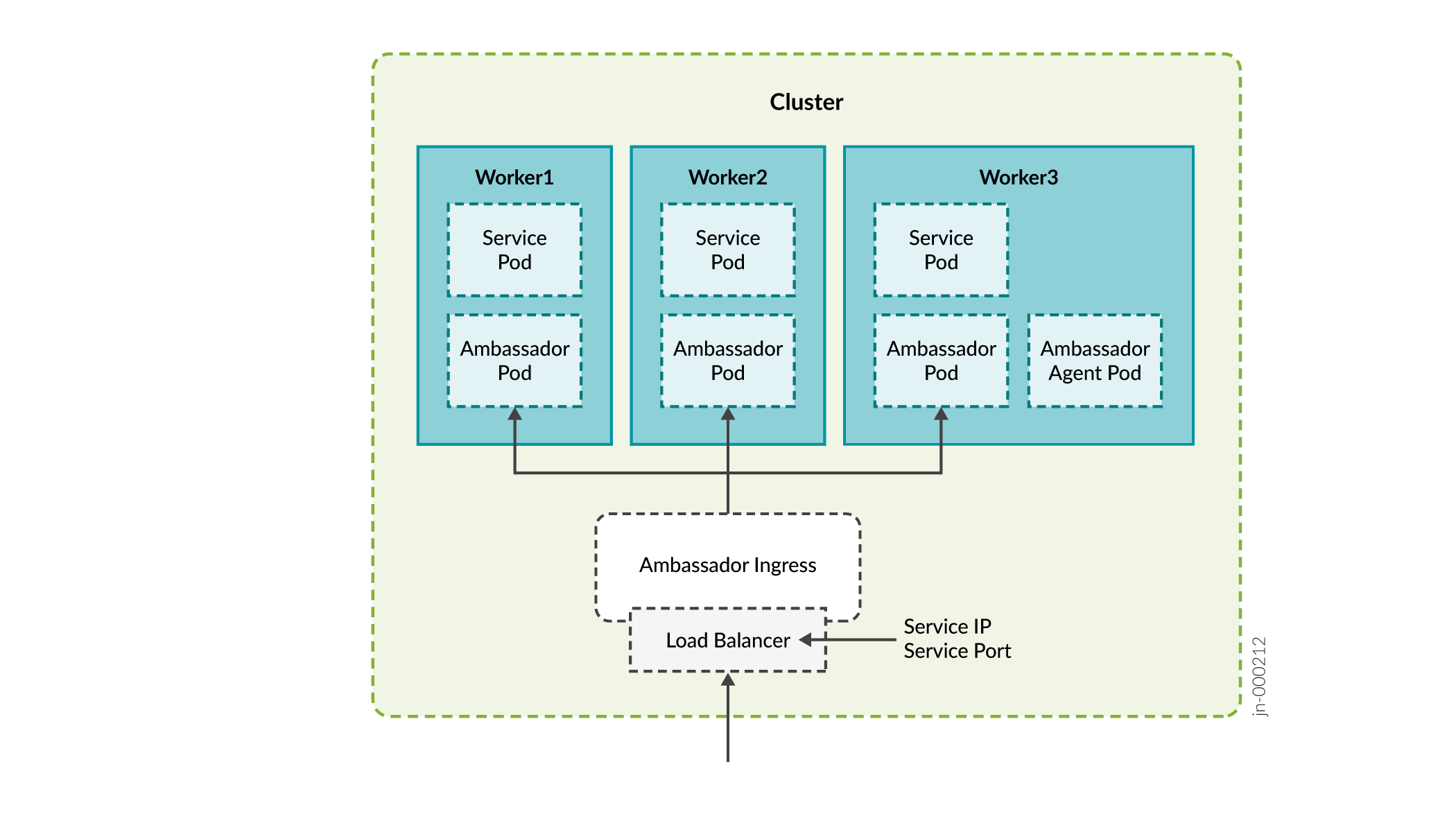

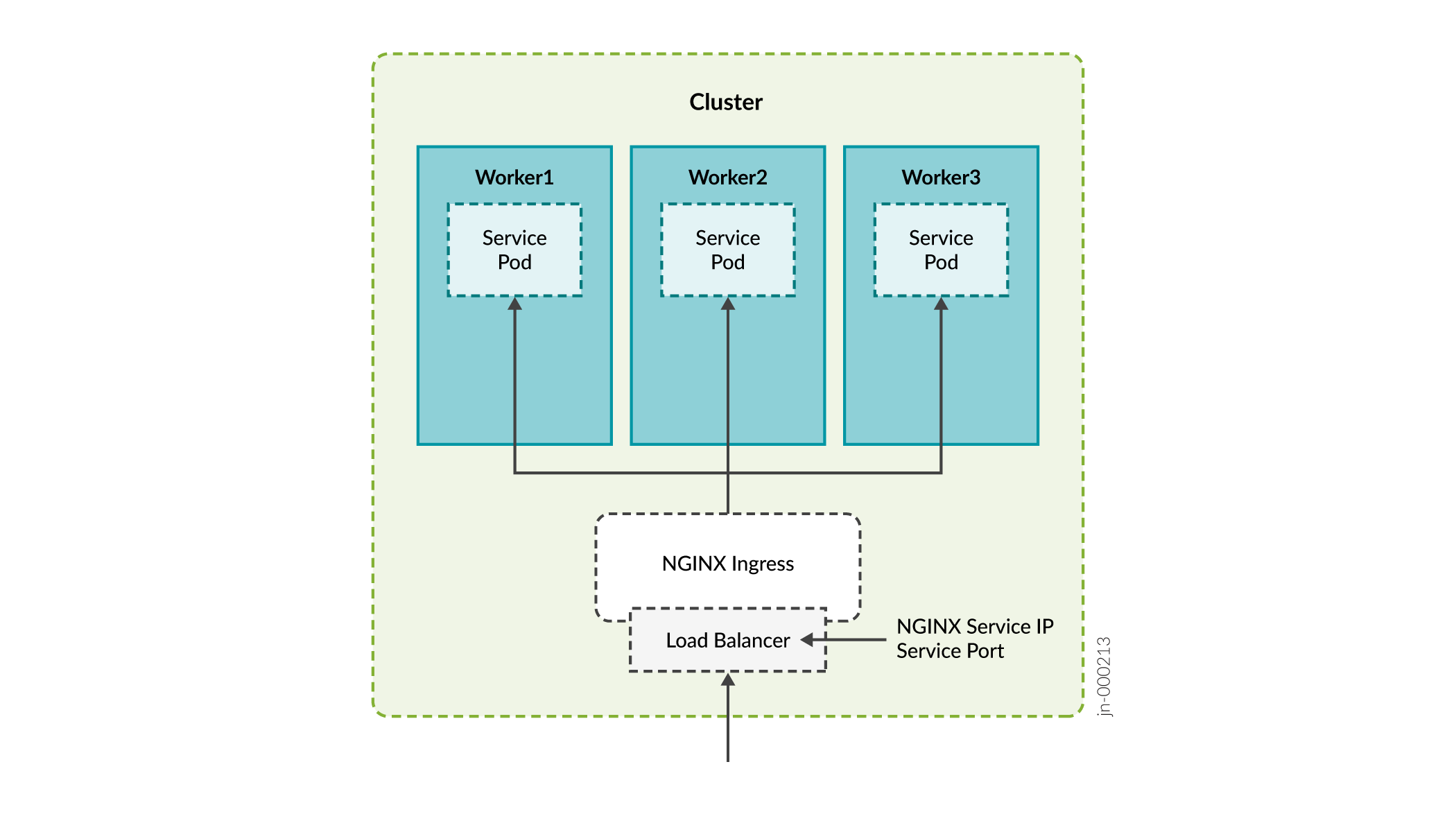

수신 - 수신 방법은 트래픽을 클러스터로 가져오는 프록시 역할을 한 다음 내부 서비스 라우팅을 사용하여 트래픽을 대상으로 라우팅합니다. 내부적으로 이 방법은 부하 분산 장치 서비스를 사용하여 프록시 역할을 할 수 있도록 자신을 세상에 노출합니다.

Paragon Automation은 다음과 같은 수신 프록시를 사용합니다.

- 대사

- 응긴스

클러스터 외부의 디바이스는 다음 서비스에 액세스해야 하므로 이러한 서비스에는 VIP 주소가 필요합니다.

| 필수 VIP 주소 | 설명 | 로드 밸런서/프록시 |

|---|---|---|

| 수신 컨트롤러 |

웹을 통해 Paragon Automation GUI에 액세스하는 데 사용됩니다. Paragon Automation은 구성 요소 및 애플리케이션에 대한 액세스를 제공하는 공통 웹 서버를 제공합니다. 서버에 대한 액세스는 Kubernetes 수신 컨트롤러를 통해 관리됩니다. |

대사 메탈LB |

| Paragon Insights 서비스 |

syslog, DHCP 릴레이 및 JTI와 같은 인사이트 서비스에 사용됩니다. | 메탈LB |

| Paragon Pathfinder PCE 서버 |

네트워크의 디바이스와 PCEP 세션을 설정하는 데 사용됩니다. |

메탈LB |

| SNMP 트랩 수신기 프록시(옵션) |

이 기능이 필요한 경우에만 SNMP 트랩 수신기 프록시에 대한 사용자. |

메탈LB |

| 인프라 Nginx 수신 컨트롤러 |

Paragon Pathfinder netflowd 서버 및 선택적으로 Paragon Pathfinder PCE 서버의 프록시로 사용됩니다. Nginx 수신 컨트롤러는 MetalLB 로드 밸런서 풀 내에 VIP가 필요합니다. 즉, 설치 프로세스 중에 구성 파일을 생성하는 동안 포함해야 하는 LoadBalancer IP 주소 범위의 일부로 이 주소를 포함해야 합니다. |

응긴스 메탈LB |

| 패스파인더 넷플로우드 |

Paragon Pathfinder netflowd 서버에 사용됩니다. Netflowd는 Nginx를 프록시로 사용할 수 있으며, 이 경우 자체 VIP 주소가 필요하지 않습니다. |

메탈LB |

| 레지스트리(선택 사항) | 기본 노드의 여러 컨테이너 레지스트리에 연결하는 데 사용됩니다. |

- |

| PCEP 서버(옵션) |

MD5 인증용 PCE 서버에 사용됩니다. |

- |

| cRPD(선택 사항) |

MD5 인증을 위해 BMP(BGP Monitoring Protocol) Pod에 연결하는 데 사용됩니다. |

- |

대사가 사용하는 포트:

-

HTTPS 80(TCP) 리디렉션

-

HTTPS 443(TCP)

-

Paragon Planner 7000(TCP)

-

DCS/NETCONF 시작 7804(TCP)

Insights Services, PCE(Path Computation Element) 서버 및 SNMP에서 사용하는 포트:

-

인사이트 서비스

JTI 4000(UDP)

DHCP(ZTP) 67(UDP)

SYSLOG 514(UDP)

SNMP 프록시 162(UDP)

-

PCE 서버

PCEP 4189(TCP)

-

SNMP

SNMP 트랩 수신기 162(UDP)

에서 사용하는 포트

에서 사용하는 포트

Nginx 컨트롤러에서 사용하는 포트:

-

NetFlow 9000(UDP)

-

PCEP 4189(TCP)

PCEP에 Nginx 사용

설치 과정에서 PCEP에 대한 수신 프록시를 활성화할지 묻는 메시지가 표시됩니다. PCE(Path Computation Element) 서버의 프록시에서 또는 Nginx-Ingress 프록시로 선택할 None 수 있습니다.

프록시로 선택하는 Nginx-Ingress 경우, 표 1에 설명된 PCE 서버에 대해 VIP를 구성할 필요가 없습니다. 이 경우 인프라 Nginx 수신 컨트롤러의 VIP 주소는 PCE 서버에도 사용됩니다. netflowd 프록시를 사용하지 않기로 선택한 경우 인프라 Nginx 수신 컨트롤러에 대한 VIP도 netflowd에 사용됩니다.

Nginx를 사용하면 여러 서비스에 단일 IP 주소를 사용할 수 있다는 이점이 있습니다.

다중 기본 노드 구축에서 레지스트리에 대한 VIP 주소

여러 기본 노드가 있는 설정을 배포하고 여러 컨테이너 레지스트리(각 기본 노드에 하나씩)를 배포하는 경우 클러스터 노드와 동일한 브로드캐스트 도메인에 추가 VIP 주소가 필요합니다. 이 주소는 각 기본 노드에 배포된 컨테이너 레지스트리에 연결하는 데 사용됩니다.

설치 마법사는 이 IP 주소를 레지스트리의 가상 IP 주소라고 합니다. MetalLB 로드 밸런서의 VIP 주소 풀에는 이 VIP 주소가 포함 되어서는 안 됩니다.

MD5 인증을 위한 VIP 주소

MD5 인증을 구성하여 라우터와 Paragon Pathfinder 간의 PCEP 세션을 보호하고 BMP 서비스가 올바른 BGP-LS 라우터와 피어링되고 있는지 확인할 수 있습니다. Paragon Automation은 Multus를 사용하여 라우터에 직접 액세스할 수 있도록 PCE 서버 및 BMP 포드에 보조 인터페이스를 제공합니다. 클러스터 노드와 동일한 서브넷에 다음 VIP 주소가 필요합니다.

-

CIDR 형식의 PCE 서버에 대한 VIP 주소

-

CIDR 형식의 cRPD에 대한 VIP 주소

MetalLB 로드 밸런서의 VIP 주소 풀에는 이러한 VIP 주소가 포함 되어서는 안 됩니다.

MD5 인증 구성을 원하시면 라우터에서 인증 키 및 가상 IP 주소를 추가로 구성해야 합니다. 또한 Paragon Automation UI에서 인증 키를 구성해야 합니다.

-

PCEP 세션의 MD5.- 라우터에서 MD5 인증 키를 구성하고 라우터에서 Paragon Automation UI 및 VIP 주소를 구성합니다.

-

Junos CLI에서 다음을 구성합니다.

user@pcc# set protocols pcep pce pce-id authentication-key pce-md5-keyuser@pcc# set protocols pcep pce pce-id destination-ipv4-address vip-for-pce -

구성 > 디바이스 > 편집 Device Name 페이지의 프로토콜:PCEP 섹션에 있는 MD5 문자열 필드에 인증 키를 입력합니다pce-md5-key.

MD5 인증 키는 79 자 이하여야 합니다.

-

-

cRPD의 MD5 - cRPD MD5 인증 키를 결정하고 라우터에서 cRPD의 키와 VIP 주소를 구성합니다.

-

다음 방법으로 MD5 인증 키를 결정하거나 설정합니다.

-

명령 스크립트를

conf실행하고 cRPD에서 MD5 인증을 활성화합니다. config.yml 파일에서 매개 변수를crpd_auth_key검색합니다. 키가 있는 경우 cRPD가 MD5용으로 구성되었음을 나타냅니다. 예를 들면 다음과 같습니다.crpd_auth_key : northstarconfig.yml 파일에 있는 키를 사용하거나 키를 편집하여 라우터에 입력할 수 있습니다. -

config.yml 파일에 MD5 인증 키가 없는 경우 cRPD에 로그인하고 다음 명령 중 하나를 사용하여 인증 키를 설정해야 합니다.

set groups extra protocols bgp group name authentication-key crpd-md5-key또는

set protocols bgp group name authentication-key crpd-md5-keyMD5 인증 키는 79 자 이하여야 합니다.

-

-

cRPD에 대해 MD5를 활성화하도록 라우터를 구성합니다.

user@pcc# set protocols bgp group name neighbor vip-for-crpd authentication-key md5-key

-

Paragon Automation 설치 프로세스를 시작하기 전에 필요한 모든 VIP 주소를 식별해야 합니다. 설치 프로세스의 일부로 이러한 주소를 입력하라는 메시지가 표시됩니다.

로드 밸런싱 구성

VIP는 기본적으로 레이어 2에서 관리됩니다. 모든 클러스터 노드가 동일한 브로드캐스트 도메인에 있는 경우 각 VIP 주소는 한 번에 하나의 클러스터 노드에 할당됩니다. 레이어 2 모드는 VIP의 페일오버를 제공하며 실제 로드 밸런싱은 제공하지 않습니다. 클러스터 노드 간의 진정한 로드 밸런싱을 위해 또는 노드가 서로 다른 브로드캐스트 도메인에 있는 경우 레이어 3에서 로드 밸런싱을 구성해야 합니다.

네트워크에 VIP 주소를 알리도록 BGP 라우터를 구성해야 합니다. BGP 라우터가 ECMP를 사용하여 서로 다른 호스트 간에 TCP/IP 세션의 균형을 맞추는지 확인합니다. BGP 라우터를 클러스터 노드에 직접 연결합니다.

클러스터 노드에서 로드 밸런싱 구성하려면 config.yml 파일을 편집합니다. 예를 들어:

metallb_config:

peers:

- peer-address: 192.x.x.1 ## address of BGP router

peer-asn: 64501 ## autonomous system number of BGP router

my-asn: 64500 ## ASN of cluster

address-pools:

- name: default

protocol: bgp

addresses:

- 10.x.x.0/24

이 예에서 192.x.x.1의 BGP 라우터는 10.x.x.0/24 접두사가 있는 VIP 주소의 도달 가능성을 네트워크의 나머지 부분에 보급합니다. 클러스터는 이 범위의 VIP 주소를 할당하고 주소를 처리할 수 있는 클러스터 노드의 주소를 보급합니다.

DNS 서버 구성(선택 사항)

수신 컨트롤러의 VIP 주소 또는 수신 컨트롤러의 VIP 주소로 확인되는 DNS(Domain Name System) 서버에 구성된 호스트 이름을 통해 기본 웹 게이트웨이에 액세스할 수 있습니다. 호스트 이름을 사용하여 웹 게이트웨이에 액세스하려는 경우에만 DNS 서버를 구성해야 합니다.

호스트 이름을 DNS에 A, AAAA 또는 CNAME 레코드로 추가합니다. 랩 및 개념 증명(POC) 설정의 경우 클러스터 노드의 /etc/hosts 파일에 호스트 이름을 추가할 수 있습니다.