LLMコネクタの概要

Routing Directorに組み込まれているLLMコネクターツールは、大規模言語モデル(LLM)(Bring your own LLMとも呼ばれます)を活用してネットワーク監視運用を合理化するための高度なAIドリブンツールです。

LLMコネクターは、従来のCLIコマンドを必要とせずに、自然言語を使用してネットワークステータスを照会し、トラブルシューティング情報を取得することを容易にします。自然言語インターフェイスは、単純なステータスチェックからより複雑なトラブルシューティングコマンドまで、さまざまなタイプのクエリをサポートします。

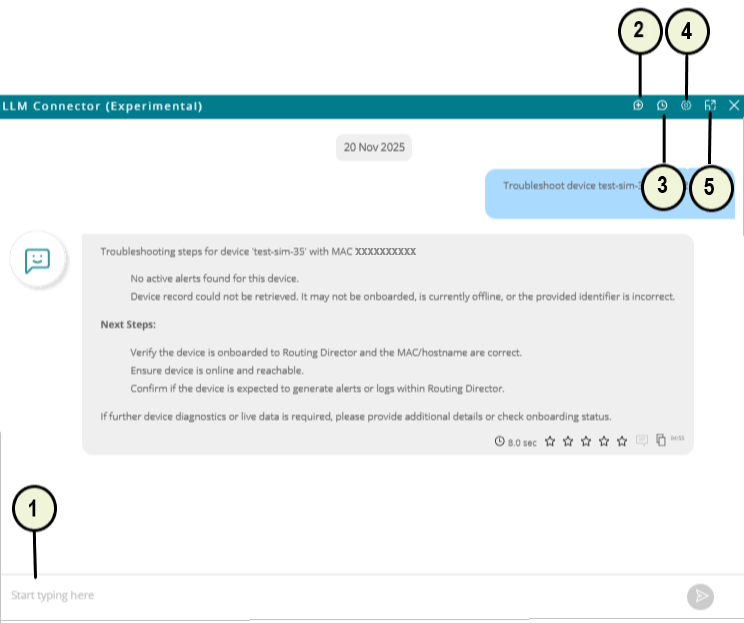

LLMコネクタには、クエリを入力できるチャットウィンドウがあります。 図1 は、最小化(デフォルト)のLLMコネクタチャットウィンドウを示しています。

|

1

—

クエリ入力フィールド |

4

—

設定アイコン |

|

2

—

新しい会話アイコン |

5

—

最大化アイコン |

|

3

—

チャット履歴アイコン |

LLMコネクタはクエリをセッションに保持するため、必要に応じて休憩後もクエリを続行できます。

セッションは1時間アクティブです。セッションが 1 時間以上アイドル状態の場合、LLM コネクタは次のクエリ セット用に新しいセッションを作成します。古いクエリに戻す場合は、チャット履歴(時計)アイコン( LLM コネクタウィンドウの右隅にあります)をクリックします。チャット履歴には、過去のすべての会話が一覧表示されます。会話を続行するには、任意の会話をクリックします。

クエリを開始すると、LLMコネクタは(ユーザーが設定した)LLMに接続して、コンテキストに応じた支援を提供します。LLMは一般的な質問に答えることができ、運用上の「読み取り専用」ネットワークコマンドを実行することもできます。

LLMは、特定の日付までのデータに基づいてトレーニングされます。そのため、LLMには、最新のRouting Directorリリースと機能に関する情報が含まれていない場合があります。

各回答の下部には、LLMコネクターが表示されます。

-

応答時間: 回答を生成するのにかかった時間を表示します。

-

フィードバックオプション: 応答の品質を評価できます。

-

コピーオプション: チャットウィンドウに表示される応答と、追加のメタデータを含む完全なAPI応答をコピーする機能を提供します。

LLMコネクタツールを使用するには、LLMを設定し、APIキーやモデルの詳細などのパラメーターを指定する必要があります。LLMの設定については、「 LLMコネクタの設定」を参照してください。

クエリの例

LLMコネクタを使用すると、次のことが可能になります。

-

デバイス情報を取得する。次に例を示します。

-

ネットワーク内のすべてのルーターをホスト名、モデル、OSバージョンとともに一覧表示します。

-

過去24時間にデバイスAで発生した主要なアラームとアラートをリストアップします。

-

-

Junos OS運用コマンドの実行。次に例を示します。

-

デバイスA上で動作上ダウンしているすべてのインターフェイスを一覧表示します。管理者の状態と説明を含める。

-

過去24時間のデバイスAに重要なアラームとメジャーアラームを表示します。

-

-

デバイスから収集したテレメトリに基づいてインサイトを取得します。次に例を示します。

-

デバイスAのインターフェイスet-0/0/0の過去6時間のテレメトリを分析します。

-

過去12時間のデバイスAの健全性(CPU、メモリ使用率、温度、ファンRPM)に関するインサイトを提供します。

-

-

ネットワーク内のすべてのVPNのリストとその詳細、メトリック、健全性情報を取得する。次に例を示します。

-

ネットワーク全体のすべてのVPNのリストを取得します。各VPNについて、SLAコンプライアンス、アクティブなアラームとインシデント、最近のフラップ、最終変更時刻を表形式で記載します。

-

デバイスAに設定されているすべてのVPNトンネルを一覧表示します。

-

-

顧客に関する情報と、顧客に関連付けられたサービスインスタンスを取得します。次に例を示します。

-

ネットワーク内のすべての顧客のリストと、各顧客に関連付けられているVPNの詳細を取得します。

-

現在劣化またはダウンしているサービスインスタンスを顧客別にグループ化してリストします。

-

-

状態グラフとメトリックグラフに関連する動的グラフをプロットします。次に例を示します。

-

デバイスXからge-0/1/2のインターフェイストラフィック使用率と運用ステータスをプロットします。

-

デバイスYのFPCメモリ使用率とルーティングエンジンCPU使用率をプロットします。

-

-

集約クエリへの回答。次に例を示します。

-

インベントリ内の電力消費の上位5台と下位5台のデバイスをリストアップします。

-

デバイスXの平均インターフェイス使用率をリストアップします。

-

LLMコネクタのセットアップ

LLMコネクタツールを使用するには、LLMを設定し、APIキーやモデルの詳細などのパラメーターを指定する必要があります。LLMの設定については、「 LLMコネクタの設定」を参照してください。

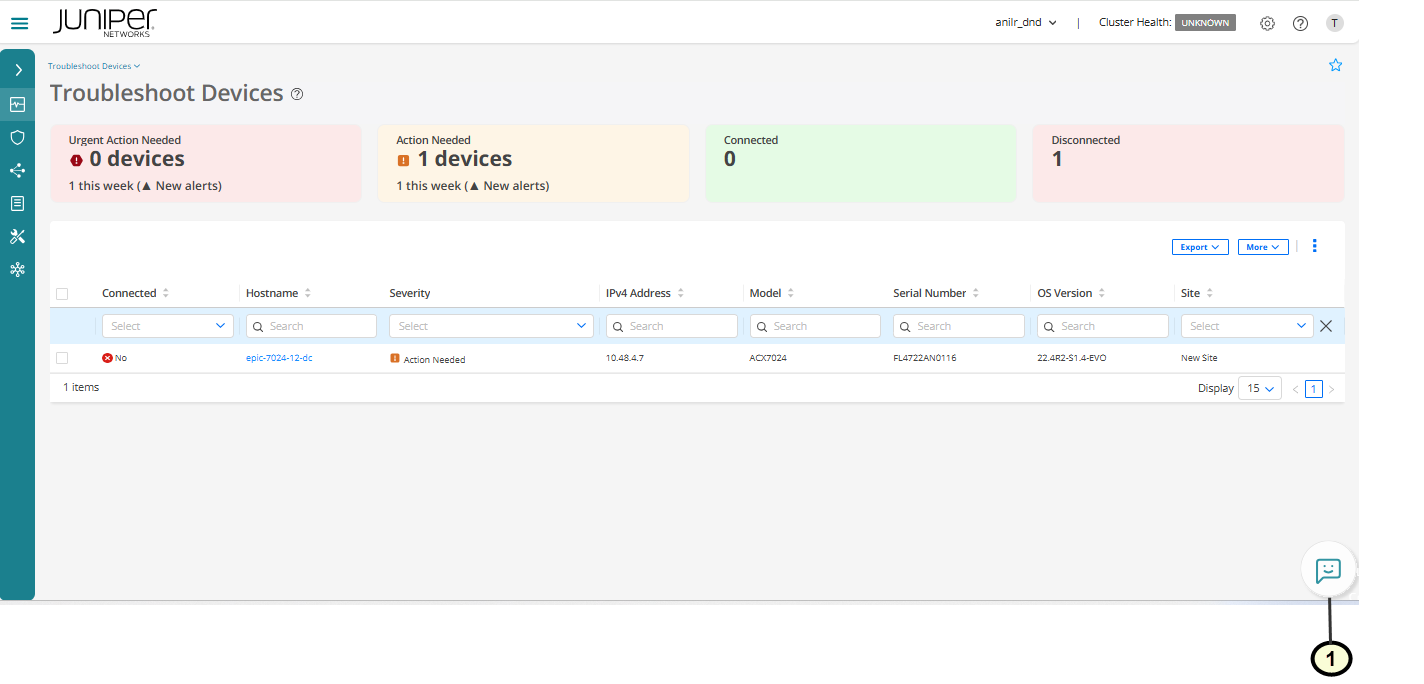

LLMコネクターへのアクセス

LLMコネクタにアクセスするには、 図に示すように、GUIの右下隅に表示されているLLMコネクタアイコンをクリックします。アイコンを移動して、GUIの四隅のいずれかに固定できます。

を示すRouting Director GUI

を示すRouting Director GUI

|

1

—

LLMコネクターアイコン |

LLMコネクターのアクション

LLMコネクタのチャットウィンドウには、以下のアクションメニュー項目があります。

-

チャット履歴—LLMコネクタウィンドウの上部にある チャット履歴 (時計)アイコンをクリックして、チャット履歴を表示します。チャット履歴アイコンをもう一度クリックして、チャット履歴を閉じます。

チャット履歴がリストされ、チャットの時間別に今日、昨日、先週などにグループ化されます。ウィンドウが最大化されると、LLMコネクタウィンドウの左側にチャット履歴が表示されます。

新しい会話を開くには、[ 新しい会話] アイコン (+) をクリックします。

-

検索— 検索 フィールドに検索テキストを入力して、会話やチャットを検索します。LLMコネクタは、入力した検索テキストとチャット履歴のクエリテキストを照合し、対応する会話を取得します。

[検索] フィールドは [チャット履歴] リストの上に表示され、[LLM コネクター] ウィンドウを最大化すると表示されます。

-

設定—LLMコネクターに対して以下の設定を構成します。

-

モデル—LLMコネクタで使用するモデルを選択します。

使用可能なオプション: Azure OpenAI、OpenAI

-

温度—LLMの温度を設定します。LLM温度は、LLM出力のランダム性または創造性を制御します。低温では、LLM は一貫した決定論的な出力を提供しますが、高い値では、出力はより創造的で多様になります。

範囲:0.1(デフォルト)から1

-

上位P—LLMコネクタの上位Pを設定します。Top-Pは、LLMがテキストを生成する際に考慮する単語の選択の数を制御します。Lower Top-Pはより焦点を絞っていて予測可能ですが、High Valueはより創造的で多様性があります。Top-Pを温度と組み合わせて使用します。

-

範囲:0.1(デフォルト)から1

LLMコネクタメニュー項目の参照については、 図1 を参照してください。

-

LLMコネクターのメリット

-

NOCチームのワークロードを軽減: LLMコネクターは、トラブルシューティングタスクに関する明確なガイダンスを提供することで、ネットワークオペレーションセンター(NOC)チームの業務負担を大幅に軽減し、より複雑な問題に集中できるようにします。

-

問題解決を迅速化: LLMコネクターは、必要なコマンドを実行し、結果を解析することで、コンテキストに応じた迅速なソリューションを提供し、問題を迅速に解決できるようにします。

-

トレーニング要件の簡素化: LLMコネクターは、新しいオペレーターが自然言語クエリを使用してRouting Directorと対話できるようにすることで、Routing Directorを使用するための学習曲線を最小限に抑え、習熟するまでにかかる時間と労力を削減します。

-

データのプライバシーとセキュリティを強化: LLM Connector は、クラウド、プライベート クラウド、オンプレミスの導入をサポートすることで、さまざまなデータ プライバシーとセキュリティのニーズに対応する柔軟なオプションを提供し、安全な運用を保証します。

-

システムの使いやすさを向上: ファンクション呼び出し機能とさまざまなLLMモデルを統合することで、外部システムとの正確かつ効率的な対話が可能になり、トラブルシューティングツールとしてのRouting Directorの全体的な使いやすさが向上します。