ON THIS PAGE

相互運用性

Connectivityの章から知っているように、ニューヨーク州のすべてのトラフィックに対して SR を使用するようになりました。領域の余分なトラフィックは、依然として LDP に依存しています。これは、すべてのニューヨークルーターで継続して実行されます。この章では、LDP への依存を軽減していますが、以前と同様に、サービスの継続性は最も重要なものとなっています。

SR の実装において自信が得られると、LDP を完全に排除することができます。この章では、最終的には、LDP がユニキャスト IPv4 または IPv6 FECs を提供しなくなった状態について説明します。

SR と LDP の相互動作

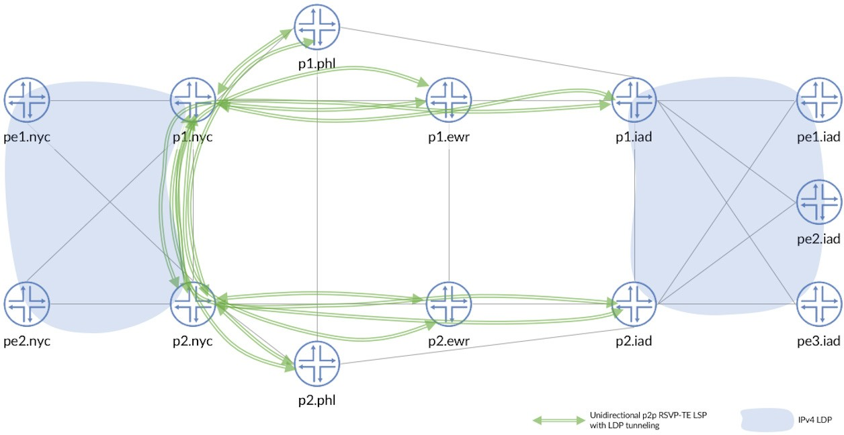

新しいニューヨークで SR 接頭辞 Sid が推奨されていても、LDP はすべてのルーターのラベルを継続的に配布しています。SR を通じて、より高い優先度を提供するのは、LDP –経由で学習したルートが競合している場合にのみ有効です。ニューヨークのルーターが ldp によって提供されたラベルを持っている場合、その宛先へのトラフィックは非セグメントルーティングのままです。LDP を無効にすることを計画している場合は、LDP のように、すべての時点で連続したFigure 1ラベル付きパスを維持する必要があります ()。この問題は、SR から LDP まで、さらには LDP から SR までの方向性においても重要です。

SR-to-LDP

SR には、SID からすべてのルーターにアクセスできることが求められています。ネットワークのほとんどは、正面にはありません。リモートルーターは、まだ SR を実行していないため、プレフィックス Sid はありません。ニューヨークで LDP を排除し、地域外には連続した LSP が存在しないということです。明らかに、プレフィックス Sid を非 SR 対応ルーターに間接的に関連付けるメカニズムを必要としています。

SR マッピングサーバー (srms) は、単なる制御プレーン機能です。非 SR に対応するために、接頭辞の Sid をアドバタイズします。これまでに期待していたように、これにより、SR スピーカーが消費し、それ以外の場合は無視する、さらに IS-IS を追加することになります。SR ルーターは、ネイティブプレフィックス Sid を inet. 3 にインストールするのと同様に、マッピングサーバーから学習したプレフィックス Sid をインストールします。

すべてのプロキシと同様に、SRMS は高可用性でなければなりません– 。また、disseminated の情報は、srms として複数のルーターを構成することによって実現されています。マッピングの一貫性は、テンプレート設定の生成、バージョン管理された構成リポジトリ、意図しない変更を迅速にロールバックする機能など、最新の運用上のベストプラクティスに従って、aspirational の成果となります。

マッピングの不整合が発生した場合には、複雑なタイルールが存在します。各 SRMS マッピングでは、基本設定が実行されます。SRMS から最高の優先度のマッピングが選択されています。複数の SRMS が同じように設定されていて、矛盾する情報をアドバタイズしている場合、SR ラベル衝突ルールが有効になります。

SRMS は、SID マッピングへのプレフィックスをアドバタイズするためにのみ存在します。そのプレフィックス自体は SRMS でアクセスできないことがあります。実際には、プレフィックスは完全には到達できない場合があります。もちろん、架空のプレフィックスのアドバタイズ SID マッピングは構成ミスと見なされるため、標準の変更レビュープロセス制御を有効にして、不正’なマッピングが有効でないことを確認する必要があります。

サーバーのアナログはクライアントです。マッピングサーバーが sway を保持するには、マッピングクライアント (SRMC) が存在している必要があります。ほとんどのプロトコルとは異なります。 SR マッピングクライアント’とサーバーは、互いに独立した制御プレーンの関係を形成しません。その代わりに、クライアントは、アドバタイズされたマッピングを使用するだけです。SRMS は、サーバーだけでなく、クライアントとも同時に使用できます。

Bordering 両方のドメインのルーターは、LDP でルーティングされたセグメントをつなぎ合わせる責任があります。境界ルーターは SR と LDP の両方を読み上げています。マッピングを受信すると、mpls の同じ FEC について LDP から学習したエントリに切り替えるための、受信ノード SID のラベルスワップエントリーが作成されます。0テーブル。

このガイド’ネットワークでは、nyc と nyc の両方がボーダールーターとして機能します。まず、SRMS を設定する方が直感的ですが、接続が中断する可能性があります。ニューヨークのルーターは SR を優先しているため、ワシントン FECs の SR マッピングエントリを学習することで、supplant の既存の LDP が’学習したラベルを PE の inet. 3 テーブルに即座に反映させることができます。SR から LDP への対応が明示的に行われていない場合、pe1 と pe2. nyc が長距離トラフィックに対して SR を使用しようとすると、p1 でトラフィックが破棄されます。 nyc と p2 によって、mpls. 0 テーブルの nyc とイン SR ラベルに対応するアクションがありません。

Enabling SR to LDP Stitching

Nyc’と nyc の両方を、SR/LDP 翻訳者として機能する、ボーダールーターとして設定しましょう。

それでも、動作を転送するように変更する必要はありません。

Connectivity verification: cross-country traffic still uses LDP labels

user@ce1.nyc> traceroute wait 1 198.51.100.54 routing-instance svc-inet traceroute to 198.51.100.54 (198.51.100.54), 30 hops max, 40 byte packets 1 pe2.nyc-ge-0-0-10.1 (198.51.100.3) 4.390 ms 2.219 ms 2.002 ms 2 p1.nyc-ge-0-0-3.0 (192.0.2.9) 43.247 ms 115.612 ms 94.366 ms MPLS Label=28 CoS=0 TTL=1 S=1 3 p2.ewr-ge-0-0-2.0 (192.0.2.17) 11.741 ms p1.phl-ge-0-0-2.0 (192.0.2.21) 44.496 ms 75.404 ms MPLS Label=18 CoS=0 TTL=1 S=0 MPLS Label=17 CoS=0 TTL=1 S=1 4 p2.iad-ge-0-0-6.0 (192.0.2.28) 7.315 ms p1.iad-ge-0-0-5.0 (192.0.2.30) 6.626 ms 6.255 ms MPLS Label=17 CoS=0 TTL=1 S=1 5 pe1.iad-ge-0-0-1.0 (192.0.2.36) 129.904 ms 190.350 ms 100.185 ms 6 ce1.iad-ge-0-0-4.0 (198.51.100.54) 9.483 ms 10.870 ms 8.107 ms

ここでは、nyc と nyc の両方が、SRMS からのマッピングエントリを待機しています。開始するために、nyc は最初の SRMS として設定されます。これにより、ワシントン州の PEs へのマッピングが通知されます。SR に対応したルーターはすべて SRMS –として動作することができます。トポロジーの配置は重要ではありません。厳密に真実ではない比較を BGP ルートリフレクタで行うことができます (大規模なトポロジでは、賢くルートリフレクタの配置、または最適なルートリフレクションの使用が必要になります)。

ポリシーは、プロトコルに依存しない構成セクションに作成されます。このポリシーは、プロトコル固有の階層の下で参照されるため、nyc を使用 IS-IS した SRMS として機能することができます。

SR は、IGPs –の選択には依存せず、ネットワークが OSPF ベースになっていることにも注意してください。

Tease’では、この構成を分離してみましょう。ポリシー名は、ローカルの問題です。そこで、128.49.106.10 (pe1 の iad’s ルーター id) から始まる4つの IPv4 プレフィックスの範囲を含むマッピングエントリを広告しています。

これは、nyc’s IS-IS LSP として、1つのラベルバインドとして効率的にエンコードされます。次回の検証では、 Rangesize キーワードに対応しています。IPv4 プレフィックスは、先頭のプレフィックスとなります。次のように構成されています start-indexとして表され Value。

Control plane: verify p1.nyc is acting as an SRMS

user@pe1.nyc> show isis database p1.nyc extensive level 1 ... Label binding: 128.49.106.10/32, Flags: 0x00(F:0,M:0,S:0,D:0,A:0), Range 4 Node SID, Flags: 0x40(R:0,N:1,P:0,E:0,V:0,L:0), Algo: SPF(0), Value: 10 ...

Inet で得られたエントリ。 SRMC の3つのテーブルTable 1は、その中のものでなければなりません。

Table 1: p1. nyc SRMS Mapping エントリー

プレフィクス | ラベル (SRGB + インデックス) | まれ? |

|---|---|---|

128.49.106.10 | 1010 (1000 + 10) | あり |

128.49.106.11 | 1011 (1000 + 11) | あり |

128.49.106.12 | 1012 (1000 + 12) | なし |

128.49.106.13 | 1013 (1000 + 13) | あり |

128.49.106.10 | 1010 (1000 + 10) | あり |

128.49.106.11 | 1011 (1000 + 11) | あり |

Forwarding plane: verify pe1.nyc prefers SR to LDP

user@pe2.nyc> show route table inet.3 match-prefix “128.49.106.1?/32” inet.3: 8 destinations, 14 routes (8 active, 0 holddown, 0 hidden) + = Active Route, - = Last Active, * = Both 128.49.106.10/32 *[L-ISIS/8] 00:11:32, metric 40 > to 192.0.2.9 via ge-0/0/1.0, Push 1010 to 192.0.2.11 via ge-0/0/2.0, Push 1010 [LDP/9] 00:12:08, metric 40, tag 1111 > to 192.0.2.9 via ge-0/0/1.0, Push 27 to 192.0.2.11 via ge-0/0/2.0, Push 27 128.49.106.11/32 *[L-ISIS/8] 00:11:32, metric 40 > to 192.0.2.9 via ge-0/0/1.0, Push 1011 to 192.0.2.11 via ge-0/0/2.0, Push 1011 [LDP/9] 00:12:08, metric 40, tag 1111 > to 192.0.2.9 via ge-0/0/1.0, Push 28 to 192.0.2.11 via ge-0/0/2.0, Push 28 128.49.106.13/32 *[L-ISIS/8] 00:11:32, metric 40 > to 192.0.2.9 via ge-0/0/1.0, Push 1013 to 192.0.2.11 via ge-0/0/2.0, Push 1013 [LDP/9] 00:12:08, metric 40, tag 1111 > to 192.0.2.9 via ge-0/0/1.0, Push 29 to 192.0.2.11 via ge-0/0/2.0, Push 29

ご覧のように、nyc から新たに学習した SR プレフィックス Sid を使用することで、LDP ルートは無視されました。 SRMS として機能しています。Nyc は、nyc または p2 から得られた LDP ラベルを以前にプッシュしています。 pe2 は、1000から始まる、よく知られた SR ラベルを使用しています。

Crux では、このような着信ラベルを受信した場合、nyc と p2 が実行されます。これらは境界ルーターであるため、マップサーバー派生ラベルを LDP から学習したラベルに交換する必要があります。具体的には、境界ルーターは同じ FEC に関連付けられた出力ラベルスタックのイン SR ラベルを交換する必要があります。この重要なステップがなければ、連続していないラベルスイッチパスを使用することになります。

まず’p1 をメモしておきましょう。’nyc の送信ラベルは p1 に向かっています。’iad とそれが LDP によってどのように学習されているかについて説明します。

Forwarding plane: verify p1.nyc’s outgoing label stack for p1.iad’s FEC

user@p1.nyc> show route 128.49.106.11/32 table inet.3 detail inet.3: 8 destinations, 13 routes (8 active, 0 holddown, 0 hidden) 128.49.106.11 /32 (1 entry, 1 announced) State: <FlashAll> *LDP Preference: 9 Next hop type: Router, Next hop index: 0 Address: 0xcc3ad10 Next-hop reference count: 4 Next hop: 192.0.2.21 via ge-0/0/5.0 weight 0x1, selected Label-switched-path p1.iad:0 Label operation: Push 17, Push 18(top) Label TTL action: prop-ttl, prop-ttl(top) Load balance label: Label 17: None; Label 18: None; Label element ptr: 0xccdbaa0 Label parent element ptr: 0xccdb2c0 Label element references: 2 Label element child references: 1 Label element lsp id: 0 Session Id: 0x0 Next hop: 192.0.2.15 via ge-0/0/4.0 weight 0x8001 Label-switched-path p1.iad:0 Label operation: Push 17, Push 20(top) Label TTL action: prop-ttl, prop-ttl(top) Load balance label: Label 17: None; Label 20: None; ...

MPLS の Lsp は再帰的に行うことができるため、これは明らかにトンネリングの場合です。ラベル17は p1 から学習され’ています。 NYC の LDP 近隣から、この FEC に向かっている次のホップを選択しています。その近傍は p1 だということです。つまり、LDP セッションをトンネリングした RSVP LSP を介して到達できます。

Control plane: verify how p1.nyc created the label stack to reach p1.iads

user@p1.nyc> show rsvp session name p1.iad:0 ingress Ingress RSVP: 4 sessions To From State Rt Style Labelin Labelout LSPname 128.49.106.9 128.49.106.3 Up 0 1 SE - 18 p1.iad:0 Total 1 displayed, Up 1, Down 0 user@p1.nyc> show ldp database session 128.49.106.9 Input label database, 128.49.106.3:0--128.49.106.9:0 Labels received: 9 Label Prefix 20 128.49.106.0/32 21 128.49.106.1/32 22 128.49.106.2/32 23 128.49.106.3/32 16 128.49.106.8/32 3 128.49.106.9/32 19 128.49.106.10/32 17 128.49.106.11/32 18 128.49.106.13/32 ...

この出力を基にして、nyc は、18 on on (RSVP LSP としてエクスポートされています) という、着信ラベル1011を 17 (SR から LDP ステッチ) に交換することを前提としています。

Forwarding plane: confirm p1.nyc swaps the SR label for the LDP/RSVP combination

user@p1.nyc> show route label 1011 detail mpls.0: 41 destinations, 41 routes (41 active, 0 holddown, 0 hidden) 1011 (1 entry, 1 announced) *L-ISIS Preference: 14 Level: 2 Next hop type: Router, Next hop index: 0 Address: 0xcc3b290 Next-hop reference count: 1 Next hop: 192.0.2.21 via ge-0/0/5.0 weight 0x1, selected Label-switched-path p1.iad:0 Label operation: Swap 17, Push 18(top) Label TTL action: prop-ttl, prop-ttl(top) Load balance label: Label 17: None; Label 18: None; Label element ptr: 0xccdd6c0 Label parent element ptr: 0x0 Label element references: 2 Label element child references: 0 Label element lsp id: 0 Session Id: 0x0 Next hop: 192.0.2.15 via ge-0/0/4.0 weight 0x8001 Label-switched-path p1.iad:0 Label operation: Swap 17, Push 20(top) Label TTL action: prop-ttl, prop-ttl(top) Load balance label: Label 17: None; Label 20: None; ...

Voilá! Inet の FEC のラベルと mpls 内の対応するラベルの両方を示しています。0は同じです。Pe1 は、pe1 に宛てられたトラフィックに対してラベル 1011 (および nyc) をプッシュしたときに、LDP ラベル (RSVP ラベルが次にプッシュされたことになります) としています。

重要なのは、従来のラベル配信プロトコル、namesake LDP、強力な RSVP といった、共存の SR の優れた機能です。

もう’1 つの長距離 traceroute を実行してみましょう。Pe1 と nyc が pe1 の SRMS アドバタイズマッピングを使用していることを確認する必要があります。もちろん、他のニューヨーク以外のルーターと同様に、pe1 は SR-oblivious を維持しています。

Connectivity verification: pe2.nyc now pushes SR label 1011, instead of the earlier LDP-learned label

user@ce1.nyc> traceroute wait 1 198.51.100.54 routing-instance svc-inet traceroute to 198.51.100.54 (198.51.100.54), 30 hops max, 40 byte packets 1 pe2.nyc-ge-0-0-10.1 (198.51.100.3) 3.418 ms 2.418 ms 3.593 ms 2 p1.nyc-ge-0-0-3.0 (192.0.2.9) 12.553 ms 6.212 ms p2.nyc-ge-0-0-3.0 (192.0.2.11) 6.776 ms MPLS Label=1011 CoS=0 TTL=1 S=1 3 p1.phl-ge-0-0-2.0 (192.0.2.21) 9.093 ms 7.572 ms p2.ewr-ge-0-0-2.0 (192.0.2.17) 8.630 ms MPLS Label=16 CoS=0 TTL=1 S=0 MPLS Label=16 CoS=0 TTL=1 S=1 4 p2.iad-ge-0-0-6.0 (192.0.2.28) 13.157 ms 7.112 ms 12.586 ms MPLS Label=16 CoS=0 TTL=1 S=1 5 pe1.iad-ge-0-0-1.0 (192.0.2.36) 11.872 ms pe1.iad-ge-0-0-2.0 (192.0.2.38) 8.175 ms 5.957 ms 6 ce1.iad-ge-0-0-4.0 (198.51.100.54) 8.596 ms 16.851 ms 7.024 ms

Remiss は、ニューヨーク間のトラフィック’に対して予期される変更がないことを検証していない場合に有効です。

Connectivity verification: traffic within New York continues to use SR

user@ce1.nyc> traceroute wait 1 198.51.100.0 routing-instance svc-inet traceroute to 198.51.100.0 (198.51.100.0), 30 hops max, 40 byte packets 1 pe2.nyc-ge-0-0-10.1 (198.51.100.3) 9.106 ms 1.801 ms 1.862 ms 2 p1.nyc-ge-0-0-3.0 (192.0.2.9) 6.196 ms p2.nyc-ge-0-0-3.0 (192.0.2.11) 94.158 ms 91.205 ms MPLS Label=1001 CoS=0 TTL=1 S=1 3 pe1.nyc-ge-0-0-2.0 (192.0.2.6) 42.152 ms pe1.nyc-ge-0-0-1.0 (192.0.2.4) 70.788 ms 67.294 ms 4 ce1.nyc-ge-0-0-1.1 (198.51.100.0) 129.316 ms 135.363 ms 146.201 ms

たいへん良い。以前の traceroutes の変更はありません。

先へ進む前’に、nyc を2つ目のマッピングサーバーとして構成することにより、srms の冗長性の欠如に対処してみましょう。これは p1 と同じように設定することができます。 nyc:

Control plane: p2.nyc also originates a label-binding SID with the same mapping as p1.nyc

user@p2.nyc> show isis database p2.nyc extensive level 1 ... Label binding: 128.49.106.10/32, Flags: 0x00(F:0,M:0,S:0,D:0,A:0), Range 4 Node SID, Flags: 0x40(R:0,N:1,P:0,E:0,V:0,L:0), Algo: SPF(0), Value: 10

転送動作は変更されていません。Nyc が使用できなくなると、p2 からのマッピングが引き続き代理ノード Sid として表示されます。

SRMS エントリの設定方法を理解するために、この設定を’p2 から削除してみましょう。代わりに、個々のプレフィックスエントリを追加してから、IS-IS LSP でエンコード方法が異なることを調査しています。同じ転送動作につながります。

範囲ではなく、個々のプレフィックスに対するマッピングが作成されました。現在のネットワークの一部ではないプレフィックス’(128.49.106.12) を扱っている範囲とは異なり、このフォームは非連続のマッピングを可能にします。ご想像のとおり、p2 では個別に TLVs 使用する’必要があります。 nyc s IS-IS PDU です。

Control plane: p2.nyc now has multiple label binding TLVs

user@pe1.nyc> show isis database p2.nyc extensive ... TLVs: Area address: 49.0001 (3) LSP Buffer Size: 1492 Speaks: IP Speaks: IPV6 IP router id: 128.49.106.2 IP address: 128.49.106.2 Label binding: 128.49.106.10/32, Flags: 0x00(F:0,M:0,S:0,D:0,A:0), Range 1 Node SID, Flags: 0x40(R:0,N:1,P:0,E:0,V:0,L:0), Algo: SPF(0), Value: 10 Label binding: 128.49.106.11/32, Flags: 0x00(F:0,M:0,S:0,D:0,A:0), Range 1 Node SID, Flags: 0x40(R:0,N:1,P:0,E:0,V:0,L:0), Algo: SPF(0), Value: 11 Label binding: 128.49.106.13/32, Flags: 0x00(F:0,M:0,S:0,D:0,A:0), Range 1 Node SID, Flags: 0x40(R:0,N:1,P:0,E:0,V:0,L:0), Algo: SPF(0), Value: 13

単一の TLV が登場するまで、すべてのワシントン’の pe ルーター (および無関係のエントリ) にマッピングが提供されるようになったときには、各 pe で 3 tlvs 1 を見つけられるようになりました。プレフィックスが連続していない場合は、このフォームが必要になります。どちらのアプローチにも、独自の検討事項があることに注意してください。

この情報を最もコンパクトに配信する方法は、プレフィックス範囲です。その範囲は、SRMS サービスを必要としているかどうかについて、広範囲に対応している場合があります。

複数のラベルバインド TLVs、より正確なのですが、大量の IGP Pdu をリードしています。

当然、どちらのアプローチも、便宜的–にアドレス指定ができたときに、範囲を同時に使用することが可能です。

Conflict Resolution

この’ハイブリッドアプローチを、NYC から SR 対応ノード–に対するアイデアとして、さらに詳しく見てみましょう。Nyc SRMS は、ワシントンルーターの各エントリを継続的に通知し、ニューヨークルーターを対象とする範囲を追加します。その目的は、これによって混乱や害が生じているかどうかを把握することです。

Pe2 の nyc’s ルーター id (128.49.106.0) で始まる既存のエントリは、範囲によってさらに拡張されていることがわかります。Pe2 はすでにノードインデックスをアドバタイズしており、そのインデックスは SRMS purports のものと一致しているため、転送動作に変化はありません。

Control plane: p2.nyc is advertising ranges for both SR-capable and incapable routers

user@pe2.nyc> show isis database p2.nyc extensive ... Label binding: 128.49.106.10/32, Flags: 0x00(F:0,M:0,S:0,D:0,A:0), Range 1 Node SID, Flags: 0x40(R:0,N:1,P:0,E:0,V:0,L:0), Algo: SPF(0), Value: 10 Label binding: 128.49.106.11/32, Flags: 0x00(F:0,M:0,S:0,D:0,A:0), Range 1 Node SID, Flags: 0x40(R:0,N:1,P:0,E:0,V:0,L:0), Algo: SPF(0), Value: 11 Label binding: 128.49.106.13/32, Flags: 0x00(F:0,M:0,S:0,D:0,A:0), Range 1 Node SID, Flags: 0x40(R:0,N:1,P:0,E:0,V:0,L:0), Algo: SPF(0), Value: 13 Label binding: 128.49.106.0/32, Flags: 0x00(F:0,M:0,S:0,D:0,A:0), Range 4 Node SID, Flags: 0x40(R:0,N:1,P:0,E:0,V:0,L:0), Algo: SPF(0), Value: 0 ...

この練習では、個々の範囲とプレフィックスの両方を組み合わせて使用できるようにしています。損害を与えることなく、この設定は運用上のベストプラクティスではありません。Landmine の無償広告による目標を実現することは、最善で混乱があり、最悪の場合、将来のソフトウェアの行動や標準仕様の変更に対応することができません。

不要なプレフィックスセグメント範囲を削除します。

LDP-to-SR

すべてのニューヨークのルーターで LDP を必要としているのを排除しましたか? SR ノード Sid を使用して相互に到達できるようになります。ワシントンの PE ルーターのために、合成ノードの Sid をさらに学習しています。LDP は依然として必要ですか? 最後のステップの後、PEs を使用して実行します。

ワシントンのルーターは、LDP を通じてニューヨークの FECs について学習していることに注意してください。Nyc および nyc で発行された RSVP Lsp にトンネリングし、p1 で終了します。 iad と p2. iad. このよう’なルーターで LDP は、連続する LSP を壊さずにオフにすることができます。

Pe1 の nyc と pe2 で LDP を無効にすることができます。まず’、LDP 経由でワシントンルーターにラベルを伝え続ける方法を考えてみましょう。P および PE ルーター間の LDP セッションは削除されるため、P ルーターは、PEs によって LDP ラベルが発行されるように設定する必要があります。

これは SRMS と同じアイデアであり、proverbial のように感じています。SR を使用できないため、接頭辞の Sid を広告するのではなく、LDP-averse のプロキシ FEC マッピングを提供する必要があります。

変更を行う前に’、pe2 が nyc によって提供される LDP ラベルがあることを確認してみましょう。 nyc をお届けします。

Control plane: p2.nyc is advertising label 56 to its LDP neighbors

user@p2.nyc> show ldp database | match “put|128.49.106.0” Input label database, 128.49.106.2:0--128.49.106.0:0 3 128.49.106.0/32 Output label database, 128.49.106.2:0--128.49.106.0:0 56 128.49.106.0/32 Input label database, 128.49.106.2:0--128.49.106.1:0 32 128.49.106.0/32 Output label database, 128.49.106.2:0--128.49.106.1:0 56 128.49.106.0/32 Input label database, 128.49.106.2:0--128.49.106.3:0 34 128.49.106.0/32 Output label database, 128.49.106.2:0--128.49.106.3:0 56 128.49.106.0/32 Input label database, 128.49.106.2:0--128.49.106.8:0 51 128.49.106.0/32 Output label database, 128.49.106.2:0--128.49.106.8:0 56 128.49.106.0/32 Input label database, 128.49.106.2:0--128.49.106.9:0 47 128.49.106.0/32 Output label database, 128.49.106.2:0--128.49.106.9:0 56 128.49.106.0/32

Forwarding plane: p2.nyc pops label 56 as its performing PHP to pe2.nyc

user@p2.nyc> show route label 56 mpls.0: 40 destinations, 40 routes (40 active, 0 holddown, 0 hidden) + = Active Route, - = Last Active, * = Both 56 *[LDP/9] 00:04:53, metric 1, tag 1111 > to 192.0.2.10 via ge-0/0/3.0, Pop 56(S=0) *[LDP/9] 00:04:53, metric 1, tag 1111 > to 192.0.2.10 via ge-0/0/3.0, Pop

Connectivity verification: traffic from Washington to pe2.nyc uses label 56

user@ce1.iad> traceroute wait 1 198.51.100.2 routing-instance svc-inet traceroute to 198.51.100.2 (198.51.100.2), 30 hops max, 40 byte packets 1 pe1.iad-ge-0-0-11.0 (198.51.100.55) 38.571 ms 2.340 ms 1.981 ms 2 p1.iad-ge-0-0-2.0 (192.0.2.37) 7.628 ms p2.iad-ge-0-0-2.0 (192.0.2.39) 9.786 ms p1.iad-ge-0-0-2.0 (192.0.2.37) 6.620 ms MPLS Label=47 CoS=0 TTL=1 S=1 3 p1.ewr-ge-0-0-3.0 (192.0.2.27) 99.309 ms 93.491 ms 94.582 ms MPLS Label=31 CoS=0 TTL=1 S=0 MPLS Label=34 CoS=0 TTL=1 S=1 4 p2.nyc-ge-0-0-4.0 (192.0.2.16) 6.603 ms 7.013 ms 7.230 ms MPLS Label=56 CoS=0 TTL=1 S=1 5 pe2.nyc-ge-0-0-2.0 (192.0.2.10) 10.157 ms pe2.nyc-ge-0-0-1.0 (192.0.2.8) 10.194 ms 9.562 ms 6 ce1.nyc-ge-0-0-2.1 (198.51.100.2) 14.194 ms 42.463 ms 7.111 ms

Enabling LDP to SR Stitching

では’、LDP で SR を nyc にして、宣伝用のラベルを変更してみましょう。

Control plane: p2.nyc allocates new LDP label 59, withdrawing label 56

user@p2.nyc> show ldp database | match “put|128.49.106.0” Input label database, 128.49.106.2:0--128.49.106.0:0 3 128.49.106.0/32 Output label database, 128.49.106.2:0--128.49.106.0:0 59 128.49.106.0/32 Input label database, 128.49.106.2:0--128.49.106.1:0 32 128.49.106.0/32 Output label database, 128.49.106.2:0--128.49.106.1:0 59 128.49.106.0/32 Input label database, 128.49.106.2:0--128.49.106.3:0 34 128.49.106.0/32 Output label database, 128.49.106.2:0--128.49.106.3:0 59 128.49.106.0/32 Input label database, 128.49.106.2:0--128.49.106.8:0 54 128.49.106.0/32 Output label database, 128.49.106.2:0--128.49.106.8:0 59 128.49.106.0/32 Input label database, 128.49.106.2:0--128.49.106.9:0 47 128.49.106.0/32 Output label database, 128.49.106.2:0--128.49.106.9:0 59 128.49.106.0/32

Control plane: LDP-to-SR stitching functionality is enabled

user@p2.nyc> show ldp overview Instance: master Reference count: 6 Router ID: 128.49.106.2 LDP inet: enabled ... LDP SR Mapping Client: enabled ...

Forwarding plane: label 59 is swapped with 0 as pe2.nyc requests SR UHP treatment

user@p2.nyc> show route label 59 mpls.0: 40 destinations, 40 routes (40 active, 0 holddown, 0 hidden) + = Active Route, - = Last Active, * = Both 59 *[LDP/9] 00:01:20, metric 1, tag 1111 > to 192.0.2.10 via ge-0/0/3.0, Swap 0 59(S=0) *[LDP/9] 00:01:20, metric 1, tag 1111 > to 192.0.2.10 via ge-0/0/3.0, Pop

Connectivity verification: label 59 is now in use by p2.nyc’s LDP neighbors to reach pe2.nyc

user@ce1.iad> traceroute wait 1 198.51.100.2 routing-instance svc-inet traceroute to 198.51.100.2 (198.51.100.2), 30 hops max, 40 byte packets 1 pe1.iad-ge-0-0-11.0 (198.51.100.55) 55.677 ms 96.798 ms 83.824 ms 2 p1.iad-ge-0-0-2.0 (192.0.2.37) 91.130 ms 81.951 ms p2.iad-ge-0-0-2.0 (192.0.2.39) 42.568 ms MPLS Label=54 CoS=0 TTL=1 S=1 3 p1.ewr-ge-0-0-3.0 (192.0.2.27) 132.320 ms p2.ewr-ge-0-0-3.0 (192.0.2.29) 7.874 ms 6.459 ms MPLS Label=16 CoS=0 TTL=1 S=0 MPLS Label=59 CoS=0 TTL=1 S=1 4 p2.nyc-ge-0-0-4.0 (192.0.2.16) 7.673 ms p1.nyc-ge-0-0-4.0 (192.0.2.14) 123.033 ms p2.nyc-ge-0-0-4.0 (192.0.2.16) 7.327 ms MPLS Label=59 CoS=0 TTL=1 S=1 5 pe2.nyc-ge-0-0-1.0 (192.0.2.8) 521.158 ms pe2.nyc-ge-0-0-2.0 (192.0.2.10) 64.296 ms pe2.nyc-ge-0-0-1.0 (192.0.2.8) 183.317 ms 6 ce1.nyc-ge-0-0-2.1 (198.51.100.2) 9.445 ms 10.869 ms 11.214 ms

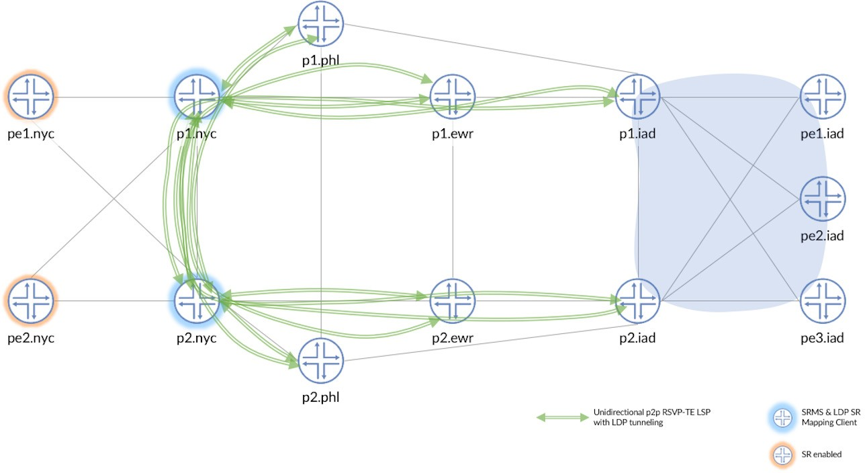

Ldp sr の–マッピングクライアント’を有効にするには、ldp からSR へのつなぎ –方と p1 にも準拠しています。 nyc は、ニューヨークに複数のパスがあることを確認しています。そして、pe1 の nyc と pe2 の両方で、LDP を無効にすることができます。今後、LDP ラベルを自分で宣伝することはなくなりますが、nyc と nyc は、にFigure 2示すようにそのまま続行します。

この状態で、必要に応じて持続することができます。これは、ニューヨークを越えたルーターが近い将来には SR に対応していない場合の、正当な運用モードである可能性があります。ネットワークの一部で不適切なハードウェアまたはソフトウェア機能が必要になるのは、SR の導入を妨げることではありません。適切に計画され、変更が必要になった場合は、すべてのプラットフォームがセグメントルーティングに同時に変換することを必要とするビッグバンイベントである必要はありません。

SR と RSVP-TE

ここでは、ニューヨークとワシントン州の P ルーター間に LDP トンネリング用 RSVP-TE Lsp のフルメッシュが存在することについて簡単に触れました。前のセクションの最後に、pe1 の nyc と pe2 から LDP が排除されました。しかし、nyc、p2. nyc、およびそのワシントン州で LDP は使用されたままになっています。

Interworking: SR over RSVP-TE

私’たちはニューヨークで wrought が行った変更をミラーリングすることで、次のようなことを進めることができます。

すべてのワシントンルーターでの SR を有効にします。

ワシントン PEs で SR から LDP を希望しています。

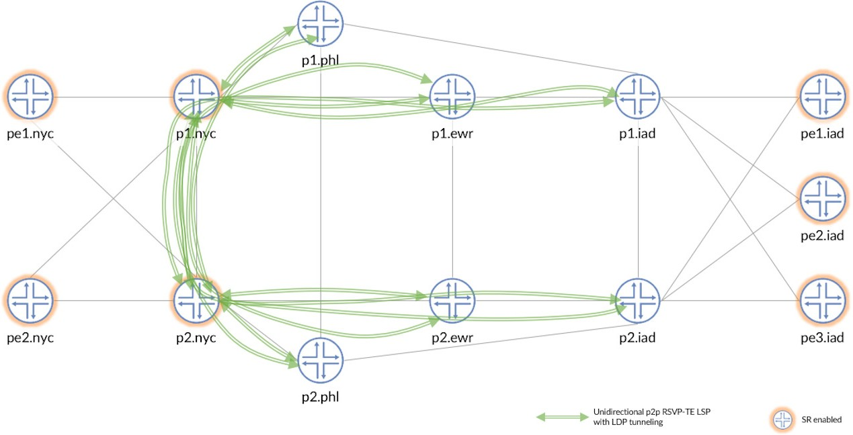

受信したルーターすべてが SR に切り替わったら、最後に LDP を根絶できます。この例では、にFigure 3示すように、nyc と p2 に設定されている SRMS および LDP SR マッピングクライアントが含まれています。

プレフィックス SID 計画の重要性を overstated することはできません。ニューヨークルーターは、SRMS のペアを通じてこれらを学習します。ネイティブノード SID の設定では、同一の値を維持する必要があります。実際、SRGB サイジング、オフセット、SID の計画は、セグメントルーティングの導入を成功させるために不可欠です。使用事例を注意深く検討することなく、ライブ導入に新旧したり、同一、一貫してサイズが設定された SRGB を使用するための、同機種の機器の能力を活用したりする必要があります。

また、ワシントン州での SR 機能を有効にする順序についても注意する必要があります。P ルーターで初めて有効にすると、接続が中断します。これは、nyc と p2. nyc は、ワシントン州の近隣が突然 SR に対応していることを確認します。Pe1 の nyc と pe2 に提供している SRMS ラベルのスワップを停止し、LDP ラベルは RSVP TE LSP で学習されます。SR から LDP への対応機能は不要と見なされます。

その代わりに、すべてのワシントン Pe で SR が最初に有効になります。

中断’が発生していないことを確認してみましょう。

Connectivity verification: traffic forwarding within New York is unchanged

user@ce1.nyc> traceroute wait 1 198.51.100.0 routing-instance svc-inet traceroute to 198.51.100.0 (198.51.100.0), 30 hops max, 40 byte packets 1 pe2.nyc-ge-0-0-10.1 (198.51.100.3) 4.094 ms 2.933 ms 2.475 ms 2 p2.nyc-ge-0-0-3.0 (192.0.2.11) 6.052 ms 5.527 ms p1.nyc-ge-0-0-3.0 (192.0.2.9) 5.449 ms MPLS Label=1001 CoS=0 TTL=1 S=1 3 pe1.nyc-ge-0-0-2.0 (192.0.2.6) 9.073 ms 5.860 ms 4.729 ms 4 ce1.nyc-ge-0-0-1.1 (198.51.100.0) 6.433 ms 7.107 ms 5.952 ms

Connectivity verification: traffic forwarding cross-country is unchanged

user@ce1.nyc> traceroute wait 1 198.51.100.54 routing-instance svc-inet traceroute to 198.51.100.54 (198.51.100.54), 30 hops max, 40 byte packets 1 pe2.nyc-ge-0-0-10.1 (198.51.100.3) 181.515 ms 211.310 ms 123.021 ms 2 p2.nyc-ge-0-0-3.0 (192.0.2.11) 7.206 ms p1.nyc-ge-0-0-3.0 (192.0.2.9) 6.855 ms p2.nyc-ge-0-0-3.0 (192.0.2.11) 6.535 ms MPLS Label=1011 CoS=0 TTL=1 S=1 3 p2.phl-ge-0-0-2.0 (192.0.2.23) 6.944 ms p1.ewr-ge-0-0-2.0 (192.0.2.15) 7.656 ms 10.006 ms MPLS Label=45 CoS=0 TTL=1 S=0 MPLS Label=17 CoS=0 TTL=1 S=1 4 p2.iad-ge-0-0-5.0 (192.0.2.32) 7.512 ms p1.iad-ge-0-0-6.0 (192.0.2.26) 12.778 ms p2.iad-ge-0-0-5.0 (192.0.2.32) 6.871 ms MPLS Label=22 CoS=0 TTL=1 S=1 5 pe1.iad-ge-0-0-1.0 (192.0.2.36) 6.567 ms pe1.iad-ge-0-0-2.0 (192.0.2.38) 6.934 ms pe1.iad-ge-0-0-1.0 (192.0.2.36) 6.115 ms 6 ce1.iad-ge-0-0-4.0 (198.51.100.54) 8.500 ms 7.762 ms 7.320 ms

変更は適切ではありません (この場合)。ワシントン州は独立したレベル1の領域で、L1/L2 P ルーターはまだ SR が有効になっていません。Unabated は、SR から LDP へと進み続けています。この瞬間は p1 で有効になっています。 iad と p2 は、moot に必要なものになります。

これはご紹介のように思えますが、つなぎ方を決定するにはどうすればよいかを考える価値があります。近隣’が sr 機能を提供していない場合、nyc と NYC は LDP の sr ラベルとスワップ merrily ます。当社のネットワークでは、今後も RSVP TE LSP ラベルを追加しています。

その後 p1. iad (または p2. iad) がノード SID で構成されている場合は、nyc と nyc の両方が最新の IS-IS レベル 2 LSP を確認します。そのため、SR から LDP への対応については、p1 を使用していることが明らかになります。 iad (または p2 ad) は SR ネイティブラベルを転送できるようになります。

このことは、そのままではありません。’最初に SR に対応していないワシントン P ルーターが料金を削減します。これにより、すべての地域間トラフィックがセグメントルーティングされます。そのため、SR over RSVP TE を示すように、RSVP TE Lsp を引き継ぐことができます。

さらに、’P2 で SR を有効にします。 iad とオーバーロード p1. iad:

これにより、ワシントンバウンドのすべてのトラフィックが p2 から強制的に実行されます。

Connectivity verification: traffic forwarding to Washington is no longer multi-pathed

user@ce1.nyc> traceroute wait 1 198.51.100.54 routing-instance svc-inet traceroute to 198.51.100.54 (198.51.100.54), 30 hops max, 40 byte packets 1 pe2.nyc-ge-0-0-10.1 (198.51.100.3) 24.153 ms 42.585 ms 85.331 ms 2 p2.nyc-ge-0-0-3.0 (192.0.2.11) 7.771 ms 7.338 ms 7.904 ms MPLS Label=1011 CoS=0 TTL=1 S=1 3 p2.phl-ge-0-0-2.0 (192.0.2.23) 6.619 ms 8.563 ms 6.279 ms MPLS Label=41 CoS=0 TTL=1 S=0 MPLS Label=22 CoS=0 TTL=1 S=1 4 p2.iad-ge-0-0-5.0 (192.0.2.32) 45.022 ms 66.523 ms 67.692 ms MPLS Label=22 CoS=0 TTL=1 S=1 5 pe1.iad-ge-0-0-2.0 (192.0.2.38) 9.016 ms 7.956 ms 5.477 ms 6 ce1.iad-ge-0-0-4.0 (198.51.100.54) 63.975 ms 67.474 ms 65.506 ms

Connectivity verification: traffic forwarding within New York remains unaffected

user@ce1.nyc> traceroute wait 1 198.51.100.0 routing-instance svc-inet traceroute to 198.51.100.0 (198.51.100.0), 30 hops max, 40 byte packets 1 pe2.nyc-ge-0-0-10.1 (198.51.100.3) 2.712 ms 2.005 ms 2.196 ms 2 p2.nyc-ge-0-0-3.0 (192.0.2.11) 5.053 ms p1.nyc-ge-0-0-3.0 (192.0.2.9) 5.036 ms p2.nyc-ge-0-0-3.0 (192.0.2.11) 6.494 ms MPLS Label=1001 CoS=0 TTL=1 S=1 3 pe1.nyc-ge-0-0-1.0 (192.0.2.4) 4.992 ms pe1.nyc-ge-0-0-2.0 (192.0.2.6) 5.301 ms pe1.nyc-ge-0-0-1.0 (192.0.2.4) 5.028 ms 4 ce1.nyc-ge-0-0-1.1 (198.51.100.0) 6.404 ms 10.624 ms 5.638 ms

Forwarding plane: both New York P routers swap the inbound SR label for LDP-o-RSVP

user@p1.nyc> show route label 1011 extensive

mpls.0: 44 destinations, 44 routes (44 active, 0 holddown, 0 hidden)

...

1011 /52 -> {list:Swap 22, Push 48(top), Swap 22, Push 43, Push 91(top)}

user@p2.nyc> show route label 1011 extensive

mpls.0: 48 destinations, 48 routes (48 active, 0 holddown, 0 hidden)

...

1011 /52 -> {list:Swap 22, Push 41(top), Swap 22, Push 39(top)}

この出力は、両方のルーターが22に1011をスワップしていることを示しています。 iad ad は、、p2 によって提供される LDP ラベルですRSVP-TE LSP ラベルがプッシュされます。2つの等しくないコストパスがあり、後者は RSVP TE バイパスを表しています。

SR is then enabled on p2.iad:

NY P ルーターは、p1 を回避し続けています。 iad. そして LDP ラベルを1011スワップするのではなく、次の SR 命令と交換するだけです。これは、 continueアクションであるように動作し、1011は1011にスワップされます。

Forwarding plane: both New York P routers now swap the inbound SR label for another SR label

user@p1.nyc> show route label 1011 extensive

mpls.0: 43 destinations, 43 routes (43 active, 0 holddown, 0 hidden)

...

1011 /52 -> {list:Swap 1011, Push 48(top), Swap 1011, Push 43, Push 91(top)}

user@p2.nyc> show route label 1011 extensive

mpls.0: 46 destinations, 46 routes (46 active, 0 holddown, 0 hidden)

...

1011 /52 -> {list:Swap 1011, Push 41(top), Swap 1011, Push 39(top)}

RSVP TE LSP プッシュラベル’が変更されないことに注意してください。SR と LDP 間でつなぎ付けなくなった一番下のラベルです。接続’が維持されるようになり、SR が RSVP TE コア間で適切に行われていることを確認しましょう。

Connectivity verification: no change within New York as expected

user@ce1.nyc> traceroute wait 1 198.51.100.0 routing-instance svc-inet traceroute to 198.51.100.0 (198.51.100.0), 30 hops max, 40 byte packets 1 pe2.nyc-ge-0-0-10.1 (198.51.100.3) 3.562 ms 2.242 ms 2.280 ms 2 p1.nyc-ge-0-0-3.0 (192.0.2.9) 5.827 ms p2.nyc-ge-0-0-3.0 (192.0.2.11) 5.176 ms p1.nyc-ge-0-0-3.0 (192.0.2.9) 4.909 ms MPLS Label=1001 CoS=0 TTL=1 S=1 3 pe1.nyc-ge-0-0-1.0 (192.0.2.4) 5.346 ms 4.597 ms 6.729 ms 4 ce1.nyc-ge-0-0-1.1 (198.51.100.0) 6.242 ms 7.008 ms 6.032 ms

Connectivity verification: outside New York, SR labels are carried all the way until pe1.iad, not just the L1/L2

user@ce1.nyc> traceroute wait 1 198.51.100.54 routing-instance svc-inet traceroute to 198.51.100.54 (198.51.100.54), 30 hops max, 40 byte packets 1 pe2.nyc-ge-0-0-10.1 (198.51.100.3) 2.707 ms 2.235 ms 1.859 ms 2 p2.nyc-ge-0-0-3.0 (192.0.2.11) 7.356 ms 6.876 ms 6.823 ms MPLS Label=1011 CoS=0 TTL=1 S=1 3 p2.phl-ge-0-0-2.0 (192.0.2.23) 79.374 ms 99.533 ms 100.238 ms MPLS Label=41 CoS=0 TTL=1 S=0 MPLS Label=1011 CoS=0 TTL=1 S=1 4 p2.iad-ge-0-0-5.0 (192.0.2.32) 8.332 ms 5.620 ms 6.191 ms MPLS Label=1011 CoS=0 TTL=1 S=1 5 pe1.iad-ge-0-0-2.0 (192.0.2.38) 6.701 ms 6.149 ms 5.633 ms 6 ce1.iad-ge-0-0-4.0 (198.51.100.54) 50.015 ms 80.652 ms 16.288 ms

これは、今までにないほど SR を使用していたよりも遠くに離れています。今までは、つなぎと LDP トンネリングの複雑な相互作用により、追加の明示的な設定なしで、RSVP TE Lsp 全体で SR トラフィックを転送することが許可されていました。

すでに学んだように、インテントを明示的にすることは、noble の目標と運用上のベストプラクティスのどちらにもなります。プラットフォームのデフォルトは、それ自体よりも悪い時代になっています。運用担当者が少なくとも、orthodox –の行動によって– 、より信頼性の高いネットワークの時代遅れを実現しています。Explicating は、自己文書化のほか、プラットフォーム、ソフトウェアリリース、およびそれらの責任者間の一貫性を適用する方法の両方を備えています。

RSVP’TE lsp を明示的に実行するように SR を設定することで、これを修正してみましょう。これは即座に変更されることはありませんが、LDP が削除されると、確実に接続を維持できます。ニューヨークとワシントンの両方の P ルーターで SR を’有効にしましょう shortcuts:

Connectivity verification: no change in either traffic flow

user@ce1.nyc> traceroute wait 1 198.51.100.54 routing-instance svc-inet traceroute to 198.51.100.54 (198.51.100.54), 30 hops max, 40 byte packets 1 pe2.nyc-ge-0-0-10.1 (198.51.100.3) 200.634 ms 131.682 ms 348.936 ms 2 p2.nyc-ge-0-0-3.0 (192.0.2.11) 44.074 ms 61.865 ms 89.987 ms MPLS Label=1011 CoS=0 TTL=1 S=1 3 p2.ewr-ge-0-0-2.0 (192.0.2.17) 69.335 ms 84.690 ms 85.139 ms MPLS Label=74 CoS=0 TTL=1 S=0 MPLS Label=1011 CoS=0 TTL=1 S=1 4 p2.iad-ge-0-0-6.0 (192.0.2.28) 7.209 ms 8.750 ms 7.218 ms MPLS Label=1011 CoS=0 TTL=1 S=1 5 pe1.iad-ge-0-0-2.0 (192.0.2.38) 6.394 ms 6.114 ms 5.724 ms 6 ce1.iad-ge-0-0-4.0 (198.51.100.54) 7.612 ms 7.749 ms 7.764 ms user@ce1.nyc> traceroute wait 1 198.51.100.0 routing-instance svc-inet traceroute to 198.51.100.0 (198.51.100.0), 30 hops max, 40 byte packets 1 pe2.nyc-ge-0-0-10.1 (198.51.100.3) 2.493 ms 1.882 ms 2.250 ms 2 p2.nyc-ge-0-0-3.0 (192.0.2.11) 4.085 ms p1.nyc-ge-0-0-3.0 (192.0.2.9) 7.766 ms 5.468 ms MPLS Label=1001 CoS=0 TTL=1 S=1 3 pe1.nyc-ge-0-0-2.0 (192.0.2.6) 6.799 ms 4.908 ms pe1.nyc-ge-0-0-1.0 (192.0.2.4) 4.566 ms 4 ce1.nyc-ge-0-0-1.1 (198.51.100.0) 6.375 ms 5.636 ms 6.442 ms

今も残っているのは、LDP (SRMS and ステッチを含む) をニューヨークの P ルーター、ならびに、RSVP TE Lsp に対して LDP トンネリングも含めて、p1 の SR を有効にし、それを運用に導入することです。

これらの手順については、すでに dissected し、詳細に説明しています。’Belabored する必要はありません。これが完了すると、LDP を SR に置き換えることになっています。セグメントルーティングアーキテクチャが、MPLS ラベル分散プロトコルにどのように適合しているかをご覧いただいてきました。

Connectivity verification: complete reachability intra- and inter-region using SR

user@ce1.nyc> traceroute wait 1 198.51.100.0 routing-instance svc-inet traceroute to 198.51.100.0 (198.51.100.0), 30 hops max, 40 byte packets 1 pe2.nyc-ge-0-0-10.1 (198.51.100.3) 2.517 ms 2.329 ms 2.028 ms 2 p1.nyc-ge-0-0-3.0 (192.0.2.9) 5.231 ms p2.nyc-ge-0-0-3.0 (192.0.2.11) 39.534 ms 62.640 ms MPLS Label=1001 CoS=0 TTL=1 S=1 3 pe1.nyc-ge-0-0-2.0 (192.0.2.6) 7.699 ms pe1.nyc-ge-0-0-1.0 (192.0.2.4) 6.293 ms pe1.nyc-ge-0-0-2.0 (192.0.2.6) 4.781 ms 4 ce1.nyc-ge-0-0-1.1 (198.51.100.0) 7.089 ms 6.082 ms 6.172 ms user@ce1.nyc> traceroute wait 1 198.51.100.54 routing-instance svc-inet traceroute to 198.51.100.54 (198.51.100.54), 30 hops max, 40 byte packets 1 pe2.nyc-ge-0-0-10.1 (198.51.100.3) 102.157 ms 209.904 ms 134.732 ms 2 p2.nyc-ge-0-0-3.0 (192.0.2.11) 8.376 ms 7.249 ms 7.538 ms MPLS Label=1011 CoS=0 TTL=1 S=1 3 p2.ewr-ge-0-0-2.0 (192.0.2.17) 9.670 ms 7.303 ms 7.385 ms MPLS Label=74 CoS=0 TTL=1 S=0 MPLS Label=1011 CoS=0 TTL=1 S=1 4 p2.iad-ge-0-0-6.0 (192.0.2.28) 7.269 ms p1.iad-ge-0-0-6.0 (192.0.2.26) 8.827 ms p2.iad-ge-0-0-6.0 (192.0.2.28) 11.046 ms MPLS Label=1011 CoS=0 TTL=1 S=1 5 pe1.iad-ge-0-0-1.0 (192.0.2.36) 7.451 ms 6.142 ms pe1.iad-ge-0-0-2.0 (192.0.2.38) 6.463 ms 6 ce1.iad-ge-0-0-4.0 (198.51.100.54) 65.857 ms 68.233 ms 63.493 ms user@ce1.iad> traceroute routing-instance svc-inet wait 1 198.51.100.0 traceroute to 198.51.100.0 (198.51.100.0), 30 hops max, 40 byte packets 1 pe1.iad-ge-0-0-11.0 (198.51.100.55) 55.924 ms 64.637 ms 70.194 ms 2 p1.iad-ge-0-0-2.0 (192.0.2.37) 110.243 ms 61.692 ms 57.564 ms MPLS Label=1001 CoS=0 TTL=1 S=1 3 p1.phl-ge-0-0-3.0 (192.0.2.31) 60.380 ms p2.ewr-ge-0-0-3.0 (192.0.2.29) 35.849 ms 7.796 ms MPLS Label=75 CoS=0 TTL=1 S=0 MPLS Label=1001 CoS=0 TTL=1 S=1 4 p1.nyc-ge-0-0-5.0 (192.0.2.20) 9.929 ms 6.796 ms 7.237 ms MPLS Label=1001 CoS=0 TTL=1 S=1 5 pe1.nyc-ge-0-0-2.0 (192.0.2.6) 6.479 ms pe1.nyc-ge-0-0-1.0 (192.0.2.4) 6.491 ms 12.843 ms 6 ce1.nyc-ge-0-0-1.1 (198.51.100.0) 8.924 ms 7.647 ms 9.697 ms user@ce1.iad> traceroute routing-instance svc-inet wait 1 198.51.100.2 traceroute to 198.51.100.2 (198.51.100.2), 30 hops max, 40 byte packets 1 pe1.iad-ge-0-0-11.0 (198.51.100.55) 2.657 ms 2.126 ms 2.304 ms 2 p1.iad-ge-0-0-2.0 (192.0.2.37) 6.891 ms 6.503 ms p2.iad-ge-0-0-2.0 (192.0.2.39) 7.041 ms MPLS Label=1000 CoS=0 TTL=1 S=1 3 p2.ewr-ge-0-0-3.0 (192.0.2.29) 49.937 ms 60.684 ms p1.phl-ge-0-0-3.0 (192.0.2.31) 82.859 ms MPLS Label=73 CoS=0 TTL=1 S=0 MPLS Label=1000 CoS=0 TTL=1 S=1 4 p2.nyc-ge-0-0-4.0 (192.0.2.16) 7.331 ms p1.nyc-ge-0-0-5.0 (192.0.2.20) 85.649 ms p2.nyc-ge-0-0-4.0 (192.0.2.16) 7.287 ms MPLS Label=1000 CoS=0 TTL=1 S=1 5 pe2.nyc-ge-0-0-1.0 (192.0.2.8) 84.588 ms 43.379 ms 7.002 ms 6 ce1.nyc-ge-0-0-2.1 (198.51.100.2) 8.398 ms 7.586 ms 8.608 ms

SR がトラフィックのエンジニアリングコアから正常に転送さ’れた場合は、その事実を書き留め、それでも永久的な運用モードになっていることを確認してみましょう。マルチパスの可能性は、SR が導入されている地域内に大きくなっています。マルチパスが領域––間などで劣化している場合、RSVP-TE が実行されます。この2つは、perennially を共存させることができます。

私たちの目的においては、L2 サブドメイン全体で SR を有効にすることについては何もありません。この設定は前の例と同様であり、繰り返し行う必要はありません。内部作業を示す目標を達成したため、ニューヨーク’とワシントンの p1 と p2 の間で RSVP TE lsp を撤去して、すべてのトラフィックが SR を使用して完全に転送されるようにしてみましょう。

Coexistence: SR-aware Bandwidth Reservation with RSVP-TE

RSVP-TE は、驚異的な機能セットを備えており、数十の実世界の運用経験を蓄積しています。特に有名で広く使用されている機能の1つは auto-bandwidth: 提供されているトラフィック負荷に合わせて、Lsp を変更したり、再ルーティングしたりすることがあります。Cleaved の自動帯域幅は、手動で入力しなくても、初期構成パラメーターを保存し、最適なパスを使用することで、ほぼわずか魔法のように表示されます。

Grossly の自動帯域幅は、次の2つの値に依存しています。LSP 予約サイズ、およびネットワーク内の特定のインターフェイスで利用可能な帯域幅。1つ目は、LSP 受信ルーターによって算出され、定期的なレート測定を使用して、間隔を滑らかにしたものです。Disseminated は、すべてのルーターが帯域幅を消費したり解放したりすることで、IGP 領域で使用されています。この2つは、分散自動帯域幅計算を推進するフィードバックループを形成しています。

このスイスでの暗黙的なクロックワーク数十年は、RSVP-TE がトラフィックを転送するためだけに使用されることを前提としています。利用可能なインターフェイス帯域幅は TED (トラフィックエンジニアリングデータベース) に格納されています。この場合、使用率スナップショットは RSVP TE によってのみ設定されます。このインターフェイスにも非 RSVP TE のトラフィックが割り当てられている場合、1つの待ち構え間に合わせは RSVP TE reservable 帯域幅を’インターフェイスの容量の割合に上限として機能します。これにより、RSVP TE Lsp は、非 MPLS トラフィックなど、帯域幅の他のユーザーとの競合を回避して、使用率のあるリンクを犠牲にすることができます。

RFC8426 (https://datatracker.ietf.org/doc/rfc8426/) は、このようなダークバンドの問題に関する文と、その他の取り組みについて説明しています。パーティショニングの帯域幅は万能ではありません。非 RSVP TE ユーザーが自然に apportioned 容量を制限しているという保証はありません。

当社のネットワークでは、SR TE とともに、帯域幅の消費者を MPLS しています。この2つを共存させるためには、完全な移行が行われるまでは、SR トラフィックの使用率’を TED s の最大 reservable インターフェイス帯域幅に反映する必要があります。そのため、RSVP TE Lsp は間接的に、帯域幅を静的に分割しなくても、容量に専用にアクセスできない可能性があることを認識しています。

ここまでは RSVP TE Lsp を購入していましたが、現在のところ、非 SR 対応デバイスとニューヨークの間にトラフィックを伝送する RSVP TE Lsp は保有しています。’わかりやすくするために、’これらのルーターや lsp –’では焦点を深くしすぎないようにしてください。その代わりに’、すべてのルーターの teds を portray して、ネットワーク’の利用可能な帯域幅を正確に表示することができます。

その他の地域では、新しいニューヨークとワシントン間で、RSVP TE Lsp を発信および終了することはありません。RSVP TE Lsp が使用するインターフェイスの中には、SR トラフィックをネイティブに切り替えるものもあります。そこで’、ニューヨークと p2 で、次に SR トラフィックを測定して、残りのインターフェイス帯域幅 (RSVP TE) からそれを差し引くようにしてみましょう。

こちらの collection-interval統計がカリングされる頻度を表します。こちらの adjustinterval は、カウンターサンプルが収集されるウィンドウの期間を示します。これらのサンプル–の平均は、リンクごとの現在の SR –トラフィック負荷を表す3つのサンプルです。この負荷が、以前に計算された平均との間のデルタである調整しきい値を超えた場合、IGP は最大 reservable 帯域幅を消費し、TED を更新します。

その結果、RSVP TE Lsp が横取りされ、再ルーティングが行われるだけでなく、TE リンクに対して reservable の最大帯域幅 IGP が氾濫してしまうことがあります。飛行中に SR トラフィックがない場合’は、p1 と nyc 間のリンクで予約に使用可能な帯域幅を確認します。 phl.

Control plane: 3Kbps in use, 97Kbps available to RSVP-TE

user@p1.nyc> show rsvp interface ge-0/0/5.0 Active Subscr- Static Available Reserved Interface State resv iption BW BW BW ge-0/0/5.0 Up 9 100% 100kbps 97kbps 3kbps

ここで’は、セグメント化されたトラフィックを1つ上げて、レポート可能な帯域幅を削減することを確認します。

Control plane: ~67Kbps used by SR

user@p1.nyc> show auto-bandwidth traffic detail ge-0/0/5 Name: ge-0/0/5.0 ` Collection Interval: 10, Adjust Interval: 30, Adjust Threshold: 1% Adjust Subscription: 100% Pkt Recv: 154.098k, Byte Recv: 13.5604M, Query Count: 238, Average: 66.926kbps Last Base Bytes: 83.658k, Last Report Time: Tue Jan 15 17:50:44 Last Query Time: Tue Jan 15 17:50:44 Last Resp Time: Tue Jan 15 17:50:44 Byte Bucket(Chronological order, first entry is latest): 96.536k 109.032k 45.408k Packet Bucket(Chronological order, first entry is latest): 1.097k 1.239k 516

Control plane: 31Kbps available to RSVP-TE, reduced by ~67Kbps

user@p1.nyc> show rsvp interface ge-0/0/5.0 Active Subscr- Static Available Reserved Interface State resv iption BW BW BW ge-0/0/5.0 Up 9 100% 100kbps 31kbps 3kbps

Control plane: LSDB reflects updated bandwidth

user@p1.nyc> show isis database p1.nyc extensive level 2 IS-IS level 2 link-state database: ... IS extended neighbor: p1.phl.00, Metric: default 10 SubTLV len: 81 IP address: 192.0.2.20 Neighbor’s IP address: 192.0.2.21 Local interface index: 337, Remote interface index: 334 Current reservable bandwidth: Priority 0 : 31kbps Priority 1 : 31kbps Priority 2 : 31kbps Priority 3 : 31kbps Priority 4 : 31kbps Priority 5 : 31kbps Priority 6 : 31kbps Priority 7 : 31kbps Maximum reservable bandwidth: 34kbps Maximum bandwidth: 100kbps ...

この反射は逆にも機能します。で’は、SR トラフィックを staunch して、利用可能な帯域幅が増加したことを確認してみましょう。

Control plane: SR utilization drops to ~40Kbps

user@p1.nyc> show auto-bandwidth traffic detail ge-0/0/5 Name: ge-0/0/5.0 Collection Interval: 10, Adjust Interval: 30, Adjust Threshold: 1% Adjust Subscription: 100% Pkt Recv: 235.006k, Byte Recv: 20.6803M, Query Count: 317, Average: 39.846kbps Last Base Bytes: 54.325k, Last Report Time: Tue Jan 15 18:03:44 Last Query Time: Tue Jan 15 18:03:54 Last Resp Time: Tue Jan 15 18:03:54 Byte Bucket(Chronological order, first entry is latest): 0 63.184k 86.24k Packet Bucket(Chronological order, first entry is latest): 0 718 980

Control plane: RSVP-TE now indicates 54Kbps available

user@p1.nyc> show rsvp interface ge-0/0/5.0 Active Subscr- Static Available Reserved Interface State resv iption BW BW BW ge-0/0/5.0 Up 9 100% 100kbps 54kbps 3kbps

Control plane: The LSDB values are flooded to neighbors & match RSVP-TE’s reported values

user@p1.nyc> show isis database p1.nyc extensive level 2 IS-IS level 2 link-state database: ... IS extended neighbor: p1.phl.00, Metric: default 10 SubTLV len: 81 IP address: 192.0.2.20 Neighbor’s IP address: 192.0.2.21 Local interface index: 337, Remote interface index: 334 Current reservable bandwidth: Priority 0 : 54kbps Priority 1 : 54kbps Priority 2 : 54kbps Priority 3 : 54kbps Priority 4 : 54kbps Priority 5 : 54kbps Priority 6 : 54kbps Priority 7 : 54kbps Maximum reservable bandwidth: 57kbps Maximum bandwidth: 100kbps ...

このような SR と RSVP TE の安全な共存により、運用担当者のニーズが予測されます。過剰な導入を行う環境では、RSVP-TE はすぐに置き換えられることはほとんどありません。利用可能な帯域幅が複数のコンシューマーによって正確に予約されていることを確認します。

SR と IPv6

IPv6 についてのご意見’があれば、おそらく正しいことです。強力なドライバーが見つからない場合、おそらく、お客’様のビジネスには存在しているとは言えません。ハッピーな Eyeballsの altar に祈りを捧げると、’強制的で技術的な差別化要因というわけではありません。

ハッピーな Eyeballsは、IETF によって定義された一連のアルゴリズムです。このため、デュアルスタックホストを使用する方が優れたユーザーエクスペリエンスを実現できます。IPv6 は、利用可能な場合に推奨されます。詳細については、 https://tools.ietf.org/html/rfc8305をご覧ください。

既存の MPLS ラベル分散プロトコルの IPv6 サポートは以下のとおりです。LDPv6 は、基本プロトコルを拡張しています。RSVP はこの日’までは、一般的な実装を提供していません。BGP は、アドレスファミリに依存し’ないままですが、当然のことながら IGP ではありません。

重要なのは、セグメントルーティングにより、IPv6 の到達可能性はファーストクラスの市民として扱われるということです。’SR は、新たに IPv6 を導入することを納得して’いましたが、その後、参入の妨げになることはありませんでした。ノード、ナチュラル、およびエニーキャスト Sid (以前は最初’の2つを使用していました) は、IPv4 と IPv6 のどちらのフレーバーも用意されています。

IPv6 のセグメントルーティングサポートは、Sid と IPv6 プレフィックスを関連付けることが最も一般的に理解されています。データプレーンは、MPLS スイッチとして維持されます。それとは対照的に、SRv6 はネイティブ IPv6 転送の根の reimagining です。MPLS を使用しているわけではありません。SRv6 は、個別のガイドのトピックである場合があります。

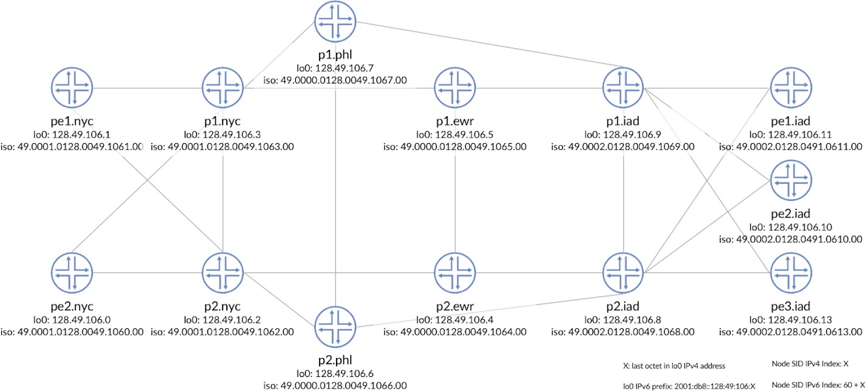

とにかく、設定はほぼ同一であり’、すぐに見てみましょう。そのため、IPv6 MPLS カプセル化されたアンダーレイを作成します。Pe1 の構文については、nyc を参照してください。SID 割り当ては、ほぼ同Table 2一の構成の繰り返しを回避し、 Figure 4設定を示すために詳細に記載されています。

Table 2: IPv6 ノード SID の割り当て

ルーター | IPv6 lo0 アドレス | IPv6 ノード SID (index + SRGB) |

|---|---|---|

pe1.nyc | 2001:db8::128:49:106:1 | 1061 (61 + 1000) |

pe2.nyc | 2001:db8::128:49:106:0 | 1060 (60 + 1000) |

p1.nyc | 2001:db8::128:49:106:3 | 1063 (63 + 1000) |

p2.nyc | 2001:db8::128:49:106:2 | 1062 (62 + 1000) |

pe1.iad | 2001:db8::128:49:106:11 | 1071 (71 + 1000) |

pe2.iad | 2001:db8::128:49:106:10 | 1070 (70 + 1000) |

pe3.iad | 2001:db8::128:49:106:13 | 1073 (73 + 1000) |

p1.iad | 2001:db8::128:49:106:9 | 1069 (69 + 1000) |

p2.iad | 2001:db8::128:49:106:8 | 1068 (68 + 1000) |

この構成が有効になると、各ルーターはさらに、ipv6 ノードインデックス (IPv4 ノードインデックスとともに) と IPv6 隣接 Sid の提供を開始します。

Control plane: Additional IPv6 node index and adjacency SIDs

user@pe1.nyc> show isis database pe1.nyc extensive IS-IS level 1 link-state database: pe1.nyc.00-00 Sequence: 0x2a7, Checksum: 0x6dc8, Lifetime: 803 secs IPV4 Index: 1, IPV6 Index: 61 Node Segment Blocks Advertised: Start Index : 0, Size : 128, Label-Range: [ 1000, 1127 ] IS neighbor: p2.nyc.00 Metric: 10 Two-way fragment: p2.nyc.00-00, Two-way first fragment: p2.nyc.00-00 P2P IPv4 Adj-SID: 17, Weight: 0, Flags: --VL-- P2P IPv6 Adj-SID: 36, Weight: 0, Flags: F-VL-- IS neighbor: p1.nyc.00 Metric: 10 Two-way fragment: p1.nyc.00-00, Two-way first fragment: p1.nyc.00-00 P2P IPv4 Adj-SID: 25, Weight: 0, Flags: --VL-- P2P IPv6 Adj-SID: 35, Weight: 0, Flags: F-VL-- IP prefix: 128.49.106.1/32 Metric: 0 Internal Up V6 prefix: 2001:db8::128:49:106:1/128 Metric: 0 Internal Up

隣接‘関係’の SID の F フラグは、IPv6 に対応した隣接関係を示します。以前に入力し’た inet 6.3 ルーティングテーブルに新しいエントリーが表示されるようになります。

Control plane: FECs in inet6.3 use native addresses, not mapped IPv4 addresses

user@pe1.nyc> show route table inet6.3 inet6.3: 8 destinations, 8 routes (8 active, 0 holddown, 0 hidden) + = Active Route, - = Last Active, * = Both 2001:db8::128:49:106:0/128 *[L-ISIS/8] 00:06:40, metric 20 > to fe80::5668:a3ff:fe1e:4af5 via ge-0/0/1.0, Push 1060 to fe80::5668:a3ff:fe1e:4ab6 via ge-0/0/2.0, Push 1060 2001:db8::128:49:106:2/128 *[L-ISIS/8] 00:06:40, metric 10 > to fe80::5668:a3ff:fe1e:4ab6 via ge-0/0/2.0 2001:db8::128:49:106:3/128 *[L-ISIS/8] 00:06:40, metric 10 > to fe80::5668:a3ff:fe1e:4af5 via ge-0/0/1.0 2001:db8::128:49:106:8/128 *[L-ISIS/8] 00:06:40, metric 30 > to fe80::5668:a3ff:fe1e:4ab6 via ge-0/0/2.0, Push 1068 2001:db8::128:49:106:9/128 *[L-ISIS/8] 00:06:40, metric 30 > to fe80::5668:a3ff:fe1e:4af5 via ge-0/0/1.0, Push 1069 2001:db8::128:49:106:10/128 *[L-ISIS/8] 00:06:40, metric 40 > to fe80::5668:a3ff:fe1e:4af5 via ge-0/0/1.0, Push 1070 to fe80::5668:a3ff:fe1e:4ab6 via ge-0/0/2.0, Push 1070 2001:db8::128:49:106:11/128 *[L-ISIS/8] 00:06:40, metric 40 > to fe80::5668:a3ff:fe1e:4af5 via ge-0/0/1.0, Push 1071 to fe80::5668:a3ff:fe1e:4ab6 via ge-0/0/2.0, Push 1071 2001:db8::128:49:106:13/128 *[L-ISIS/8] 00:06:40, metric 40 > to fe80::5668:a3ff:fe1e:4af5 via ge-0/0/1.0, Push 1073 to fe80::5668:a3ff:fe1e:4ab6 via ge-0/0/2.0, Push 1073

さらに’、これらの新しいサービスルートへの接続を、リージョンと領域の両方について検証します。次に、IPv6 サービスプレフィックスが IPv6 トランスポートによって実行されていることを確認できます。6 PE’s マッピングされた IPv4 アドレスと IPv6 明示的な null の使用は、削り残しておくことができます。

Connectivity verification: Intra-region using the new IPv6 node SIDs

user@ce1.nyc> traceroute 2001:db8::198:51:100:2 traceroute6 to 2001:db8::198:51:100:2 (2001:db8::198:51:100:2) from 2001:db8::198:51:100:0, 64 hops max, 12 byte packets 1 2001:db8::198:51:100:1 (2001:db8::198:51:100:1) 33.108 ms 11.671 ms 3.032 ms 2 p1.nyc-lo0.0 (2001:db8::128:49:106:3) 60.297 ms 73.248 ms p2.nyc-lo0.0 (2001:db8::128:49:106:2) 6.085 ms MPLS Label=1060 CoS=0 TTL=1 S=1 3 pe2.nyc-lo0.0 (2001:db8::128:49:106:0) 8.127 ms 5.868 ms 6.411 ms 4 2001:db8::198:51:100:2 (2001:db8::198:51:100:2) 7.223 ms 7.043 ms 6.865 ms

Connectivity verification: inter-region using the new IPv6 node SIDs

user@ce1.iad> traceroute 2001:db8::198:51:100:0 traceroute6 to 2001:db8::198:51:100:0 (2001:db8::198:51:100:0) from 2001:db8::198:51:100:54, 64 hops max, 12 byte packets 1 2001:db8::198:51:100:55 (2001:db8::198:51:100:55) 3.297 ms 2.640 ms 2.752 ms 2 p2.iad-lo0.0 (2001:db8::128:49:106:8) 8.982 ms p1.iad-lo0.0 (2001:db8::128:49:106:9) 8.719 ms 8.548 ms MPLS Label=1061 CoS=0 TTL=1 S=1 3 p1.ewr-lo0.0 (2001:db8::128:49:106:5) 65.592 ms p2.phl-lo0.0 (2001:db8::128:49:106:6) 8.300 ms 7.831 ms MPLS Label=1061 CoS=0 TTL=1 S=1 4 p1.nyc-lo0.0 (2001:db8::128:49:106:3) 8.081 ms p2.nyc-lo0.0 (2001:db8::128:49:106:2) 8.512 ms 8.452 ms MPLS Label=1061 CoS=0 TTL=1 S=1 5 pe1.nyc-lo0.0 (2001:db8::128:49:106:1) 8.251 ms 8.593 ms 8.803 ms 6 2001:db8::198:51:100:0 (2001:db8::198:51:100:0) 9.266 ms 8.870 ms 8.603 ms

SR とマルチキャスト

一般的な神話では、マルチキャストはセグメントルーティングネットワークで特別な処理が必要になります。ほとんどの誤解と同様に、このことは理解していないことが原因です。

マルチキャスト転送はユニキャストに直交しています。既存の–アプローチ SR が有効になっている–場合でも、IPv4 マルチキャスト、MPLS マルチキャストは使用可能です。MPLS マルチキャストに関して言えば、predate SR ––が、マルチキャスト転送のために LDP と RSVP TE 2 つのプロトコルをそのまま残していることを意味しているかもしれません。

MLDP には、ポイントツーマルチポイント (P2MP) とマルチポイント間 (MP2MP) のレプリケーションツリーが用意されるようになっています。RSVP-TE では、ポイントツーポイント (P2P) 受信レプリケーションと P2MP ネットワーク複製を提供しています。どちらも、非 VPN およびマルチキャスト VPN トラフィックの配信をサポートしています。

受信およびネットワーク複製を提供するための、スプレーやツリー SID aspire などの SR ネイティブなアプローチ。BIER は、セグメントルーティングではありませんが、通過ノードから状態を削除するのと同じような理想をたどります。これらの技術が成熟するまで、事業者は既存のマルチキャストメカニズムに頼ることができます。